청각 중심 쿼리와 순서형 카운팅으로 강화된 영상‑음성 인스턴스 분할

초록

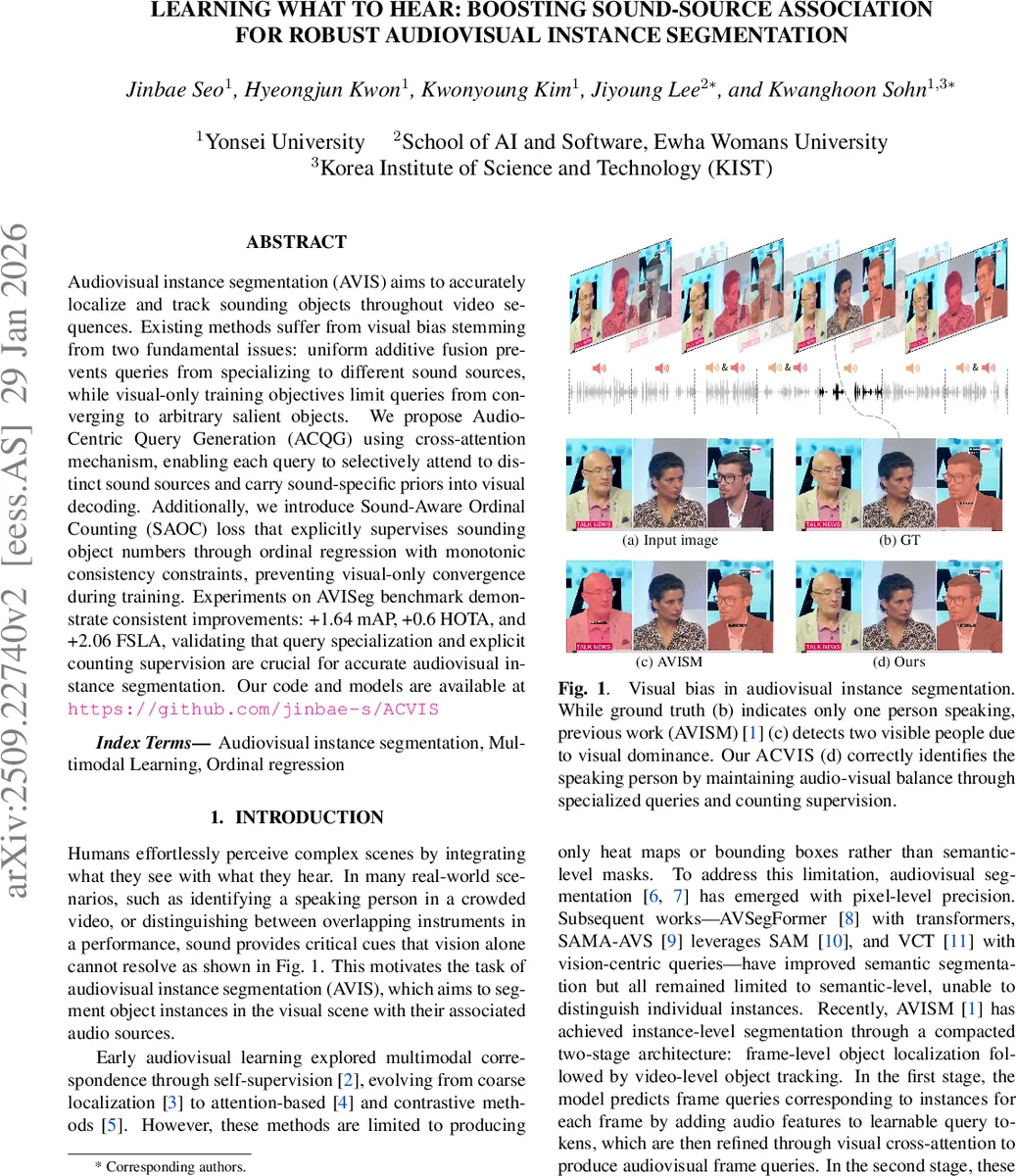

본 논문은 기존 AVIS 모델이 시각 편향에 빠지는 문제를 해결하기 위해, 오디오‑전용 교차‑어텐션으로 쿼리를 음원에 특화시키는 Audio‑Centric Query Generation(ACQG)과, 소리 나는 객체 수를 순서형 회귀 형태로 감독하는 Sound‑Aware Ordinal Counting(SAOC) 손실을 제안한다. AVISeg 벤치마크에서 mAP +1.64, HOTA +0.6, FSLA +2.06의 성능 향상을 입증한다.

상세 분석

이 연구는 영상‑음성 인스턴스 분할(AVIS) 분야에서 “시각 편향”이라는 근본적인 한계를 정확히 짚어낸다. 기존 AVISM은 오디오 특징을 모든 쿼리에 단순히 덧셈(additive) 방식으로 주입해, 각 쿼리가 서로 다른 음원에 집중하지 못하고 시각적으로 눈에 띄는 객체에만 반응한다는 점을 지적한다. 이를 극복하기 위해 저자는 두 가지 핵심 기법을 설계한다. 첫 번째는 Audio‑Centric Query Generation(ACQG)이다. 여기서는 학습 가능한 프레임 쿼리를 오디오 특징과 교차‑어텐션(cross‑attention)으로 결합한다. 쿼리는 키와 밸류 모두가 오디오 텐서인 구조를 갖으며, 각 쿼리가 서로 다른 주파수·시간 패턴에 선택적으로 집중하도록 만든다. 결과적으로 “음향‑특화 쿼리”가 생성돼, 이후 비주얼 디코더에 전달될 때 해당 쿼리가 담당할 인스턴스가 실제 소리를 내는 객체와 더 높은 정합성을 보인다. 두 번째는 Sound‑Aware Ordinal Counting(SAOC) 손실이다. 기존의 마스크·클래스 손실은 시각적 신호에만 의존해, 소리 없는 시각적 객체까지 과잉 탐지하게 만든다. SAOC는 프레임마다 실제 소리 나는 객체 수 N_obj를 순서형 회귀 형태로 예측하도록 강제한다. 구체적으로, 카운트 토큰을 통해 K_max개의 조건부 확률 p_k를 출력하고, 각 k에 대해 N_obj > k 여부를 바이너리 라벨 t_k와 비교해 로그 손실을 계산한다. 이때 조건부 확률 구조는 “P(>k) ≥ P(>k+1)”라는 단조성(monotonicity)을 보장해, 학습 과정에서 안정적인 그래디언트를 제공한다. SAOC는 쿼리가 실제 음향 정보를 반영하도록 압력을 가함으로써, 시각적 편향을 억제하고 소리 나는 객체만을 활성화하도록 유도한다. 실험 결과, ACQG만 적용해도 mAP +1.13, HOTA +0.78, FSLA +1.03의 개선이 있었으며, SAOC와 결합했을 때 최종적으로 mAP +1.64, HOTA +0.60, FSLA +2.06까지 상승한다. Ablation study에서 K_max = 2가 가장 좋은 성능을 보였으며, 이는 데이터셋의 평균 음원 수와 일치한다는 점도 흥미롭다. 또한, 백본을 ImageNet+COCO 사전학습된 ResNet‑50에서 Swin‑L로 교체하면 성능이 더욱 상승할 여지가 있음을 시사한다. 전체적으로 이 논문은 “쿼리 특화”와 “카운팅 감독”이라는 두 축을 통해 멀티모달 인스턴스 분할에서 시각‑청각 균형을 맞추는 새로운 패러다임을 제시한다는 점에서 학술적·실용적 의의가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기