대형 비전 모델은 정신 회전 문제를 해결한다

초록

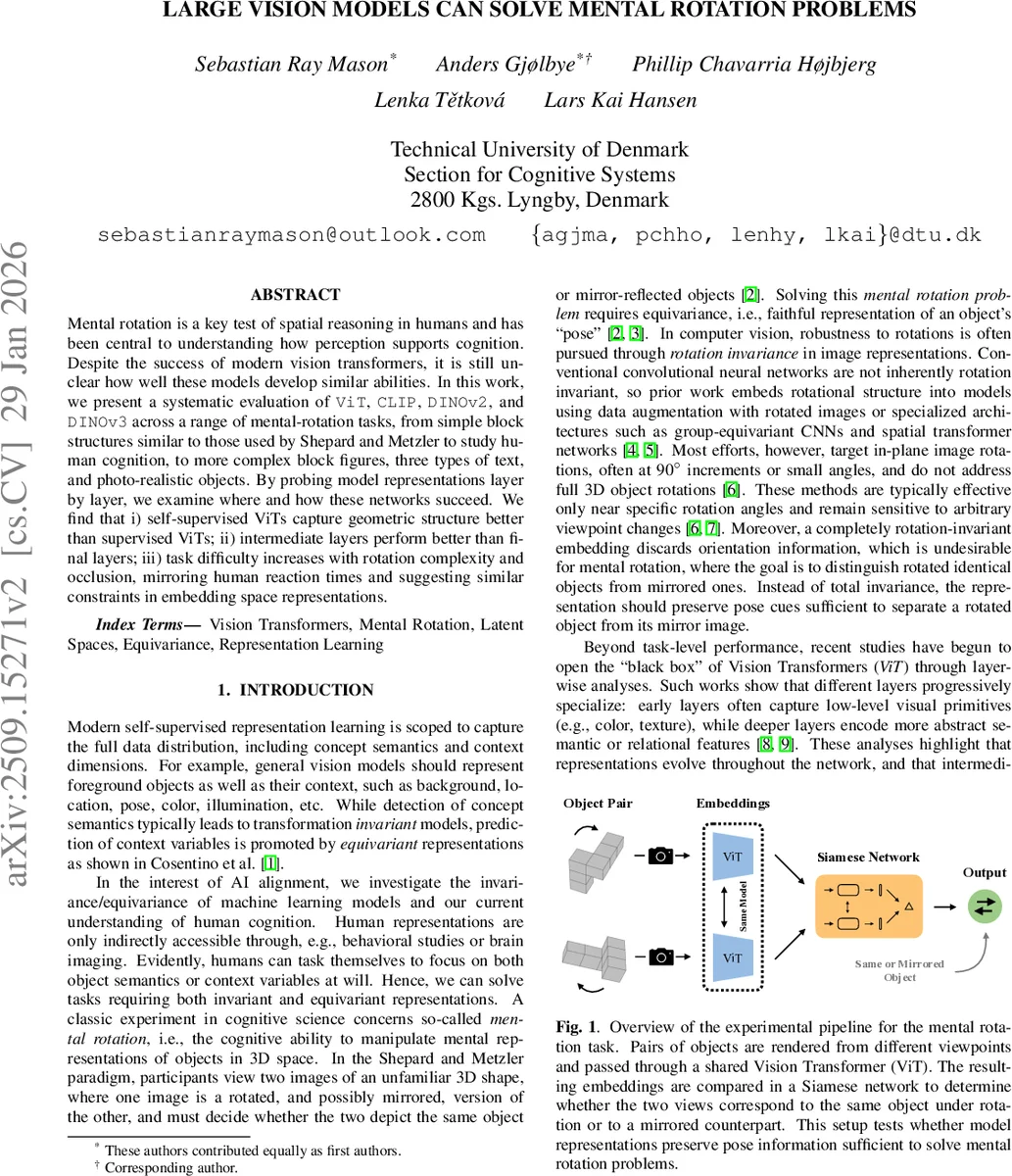

본 논문은 최신 비전 트랜스포머(ViT, CLIP, DINOv2, DINOv3)가 인간의 정신 회전 실험과 유사한 3D 회전·대칭 판단 과제를 얼마나 수행할 수 있는지를 체계적으로 평가한다. 실험 결과, 자기지도 학습된 모델이 지도학습 ViT보다 기하학적 구조를 더 잘 포착하고, 중간 층에서 최종 층보다 높은 정확도를 보이며, 회전 각도·가림 정도가 커질수록 난이도가 상승한다는 점을 밝혀냈다.

상세 분석

이 연구는 정신 회전 과제를 인공신경망의 ‘등변·공변’ 특성 검증 도구로 활용한다는 점에서 의미가 크다. 기존의 회전 불변성 연구는 주로 2D 평면 회전이나 제한된 각도(90° 배수)에 초점을 맞췄지만, 본 논문은 3차원 회전과 좌우 대칭을 동시에 포함하는 Shepard‑Metzler 스타일의 데이터셋을 구축하고, 텍스트와 포토리얼리틱 씬까지 확장하였다. 데이터 생성 단계에서 ‘Free’ 조건(임의 고도·방위)과 ‘±0°’ 조건(고도 고정) 등 난이도별 변형을 도입해 인간의 반응시간과 유사한 난이도 구배를 설계했다.

모델 측면에서는 네 종류의 대형 비전 트랜스포머를 동일한 파이프라인에 적용했다. 지도학습 ViT는 ImageNet‑21K 기반으로 클래스 불변성을 학습하므로, 회전·대칭에 대한 민감도가 낮아지는 경향을 보였다. 반면 CLIP은 이미지‑텍스트 쌍을 이용한 대조 학습으로 시각적 특징과 언어적 의미를 동시에 보존하므로 텍스트 변형(정규·무작위·Pseudo) 과제에서 뛰어난 성능을 나타냈다. DINOv2와 DINOv3는 teacher‑student 구조와 다양한 이미지 증강을 통해 강력한 자기지도 표현을 학습했으며, 특히 DINOv3는 Gram anchoring 손실을 추가해 고해상도 밀집 특징을 안정화함으로써 가장 어려운 ‘Free’ Shepard‑Metzler와 고각도 포토리얼리틱 씬에서도 중간‑후반 층에 제한적이지만 의미 있는 신호를 유지했다.

층별 분석 결과는 특히 흥미롭다. 대부분의 모델은 초기 층에서 색·텍스처와 같은 저수준 특징을, 중간 층에서 형태·구조 정보를, 최종 층에서는 의미적 추상화를 수행한다. 정신 회전 과제는 ‘포즈 정보’를 보존해야 하므로, 중간 층에서 최고 정확도가 관찰되었다. 예를 들어 ViT Large는 46번째 층에서 ±0° 과제 정확도가 85%에 달했지만, 최종 층에서는 60% 이하로 떨어졌다. DINOv3 Huge는 1819번째 층에서만 ‘Free’ 조건을 어느 정도 구분했으며, 이는 고차원 표현이 여전히 회전 정보를 일부 보존하고 있음을 시사한다.

또한 회전 각도가 커질수록(±10°, ±20°, ±30°, Free) 정확도가 점진적으로 감소했으며, 이는 인간이 물체를 회전시킬 때 반응시간이 선형적으로 증가하는 현상과 정량적으로 일치한다. 포토리얼리틱 씬에서도 카메라 고도가 30°에서 90°로 증가할수록 성능이 하락했는데, 이는 가려짐(occlusion)과 시점 변화가 임베딩 공간에서의 구분력을 약화시킨다는 기존 연구와 부합한다.

결론적으로, 현재의 대형 비전 트랜스포머는 완전한 회전 불변성을 목표로 설계되지 않았음에도 불구하고, 자기지도 학습을 통해 어느 정도의 ‘공변’ 특성을 내재하고 있다. 그러나 인간 수준의 전방위 3D 회전·대칭 판단을 위해서는 중간 층의 정보를 활용하거나, 회전·포즈 정보를 명시적으로 보존하도록 설계된 아키텍처(예: 그룹-합동 CNN, 스페이셜 트랜스포머)의 도입이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기