소스‑프리 VLM을 위한 훈련‑무료 오픈셋 적응: SVD 기반 필터링과 Box‑Cox 임계값 추정

초록

본 논문은 사전 학습된 비전‑언어 모델(VLM)을 재학습 없이 오픈셋 도메인 적응에 적용하는 방법을 제안한다. Semantic Affinity Anchoring(SAA) 현상으로 알려진, 의미적으로 연관된 미지 클래스가 기존 클래스 클러스터에 고정되는 문제를 해결하기 위해 두 가지 플러그‑인 모듈을 설계한다. SUFF는 고신뢰도 미지 샘플의 특징을 SVD로 저차원 “미지 서브스페이스”로 추출하고, 각 샘플을 해당 서브스페이스에 투영해 불필요한 미지 성분을 부드럽게 억제한다. BGAT는 엔트로피 점수에 Box‑Cox 변환을 적용해 왜곡을 교정하고, 이변량 가우시안 혼합 모델을 피팅해 데이터에 적응적인 임계값을 자동으로 결정한다. 9개 벤치마크와 3가지 VLM(클립, 시그립, ALIGN)에서 실험한 결과, 제안 방법은 기존 재학습 기반 최첨단 기법과 동등하거나 우수한 성능을 보이며, 경량 추론 캘리브레이션 패러다임을 제시한다.

상세 분석

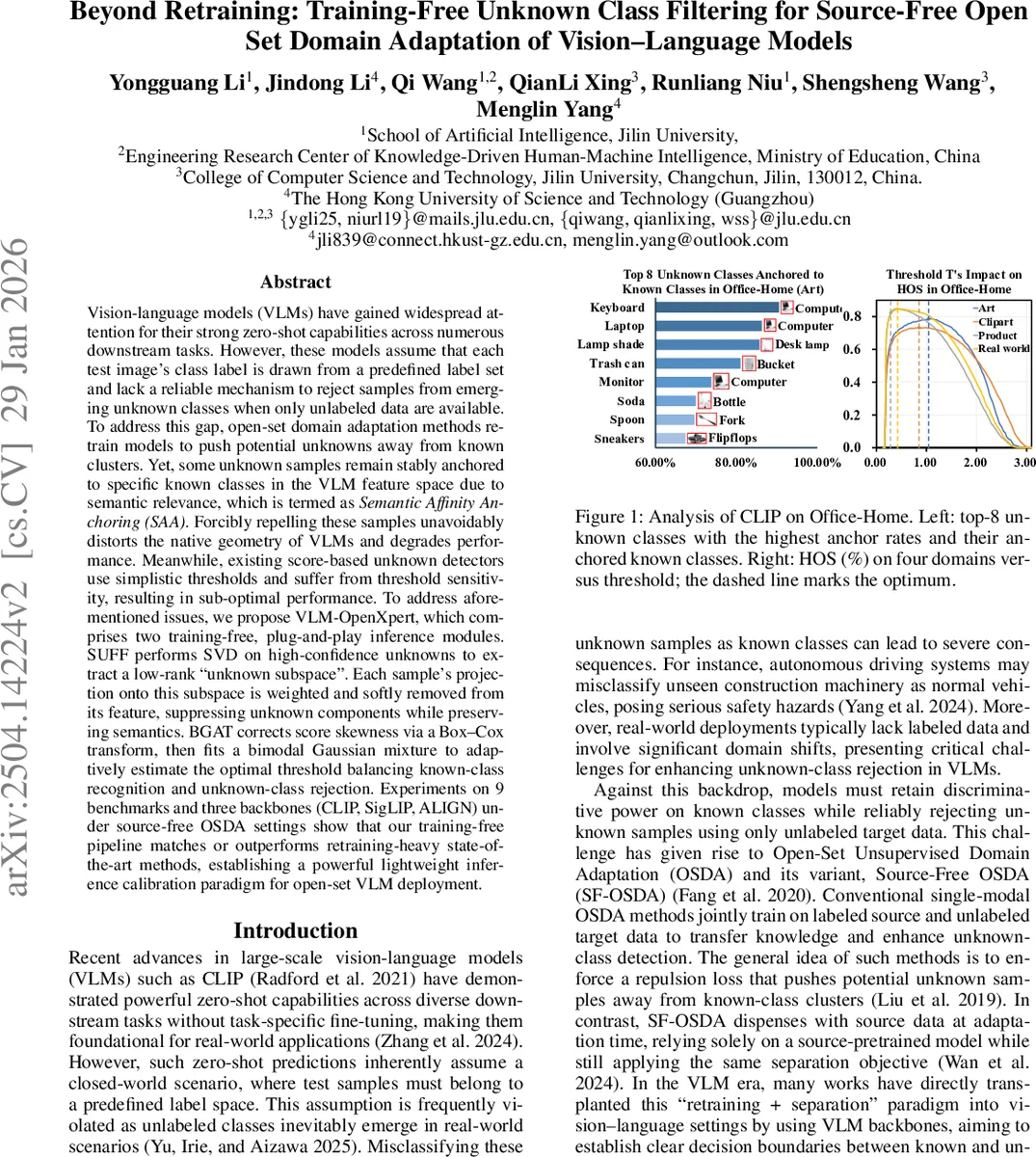

본 연구는 VLM 기반 오픈셋 도메인 적응에서 두 가지 근본적인 한계를 짚는다. 첫째, 기존 재학습 방식은 “모든 미지 샘플은 알려진 클래스와 의미적으로 멀리 떨어져 있어야 한다”는 전제 하에 repulsion loss를 적용한다. 그러나 대규모 이미지‑텍스트 사전 학습이 반영한 의미적 구조 때문에, 일부 미지 클래스는 자연스럽게 특정 알려진 클래스와 높은 의미적 유사성을 보이며 클러스터에 고정된다(SAA). 이러한 샘플을 강제로 밀어내면 VLM의 고차원 임베딩 공간이 왜곡돼 제로샷 성능이 급격히 저하된다. 둘째, 기존 스코어 기반 미지 탐지기는 고정 임계값이나 단순 평균·k‑means와 같은 휴리스틱에 의존해 스코어 분포의 비대칭성에 취약하다.

제안된 VLM‑OpenXpert은 이러한 문제를 훈련‑무료 방식으로 해결한다. SUFF는 먼저 엔트로피 기반 불확실도 측정으로 고신뢰도 미지 샘플을 선별한다. 이때 선택된 샘플들의 특징 행렬을 중앙화하고 SVD를 수행해 주요 특이값들만 보존하는 저차원 서브스페이스를 만든다. 미지 샘플은 이 서브스페이스에 높은 투영 에너지를 갖는 반면, 알려진 샘플은 상대적으로 낮은 에너지를 가진다. 각 샘플 특징에 대해 투영값에 가중치를 곱해 부드럽게 차감함으로써, 미지 성분을 억제하면서도 원래 의미적 구조는 보존한다. 이는 기존의 전역 repulsion과 달리 방향성(directional) 필터링을 제공한다.

BGAT는 스코어 왜곡을 정량적으로 교정한다. 엔트로피 점수에 작은 ε를 더해 양수화한 뒤 Box‑Cox 변환을 적용해 스케일과 왜곡을 최소화한다. 변환 파라미터 λ는 최대우도 추정으로 자동 결정된다. 변환된 스코어에 2‑컴포넌트 가우시안 혼합 모델(GMM)을 EM 알고리즘으로 피팅하고, 두 평균의 중간값을 임계값으로 채택한다. 평균은 분산보다 추정 안정성이 높아, GMM 추정 오류에 강인하다. 최종 임계값은 역 Box‑Cox 변환을 통해 원래 스코어 공간으로 되돌린다.

실험에서는 Office‑Home, DomainNet, VisDA‑2017 등 9개 데이터셋과 CLIP, SigLIP, ALIGN 세 백본을 사용해 SF‑OSDA 설정에서 평가하였다. 주요 메트릭인 HOS(전체 정확도)와 AUROC에서 기존 재학습 기반 방법(예: OSBP, DANCE 등)을 능가하거나 동등한 결과를 기록했다. 특히 SAA 비율이 높은 도메인(Office‑Home Art)에서 SUFF가 미지 샘플을 효과적으로 억제해 성능 격차를 크게 줄였다. 연산량 측면에서도 SVD와 Box‑Cox 변환은 추론 단계에서 몇 밀리초 수준의 오버헤드만 추가해, 실시간 서비스에 적합함을 입증했다.

이 논문은 VLM을 실제 배포 환경에 적용할 때, 라벨이 없고 소스 데이터에 접근할 수 없는 상황에서도 강력한 오픈셋 인식 능력을 제공한다는 점에서 의미가 크다. 훈련‑무료라는 특성은 모델 보안·프라이버시 요구사항을 만족시키며, 기존 재학습 파이프라인을 대체하거나 보완하는 플러그‑인 형태로 손쉽게 통합될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기