원샷 연합학습을 위한 분류기‑프리 확산 모델 OSCAR

초록

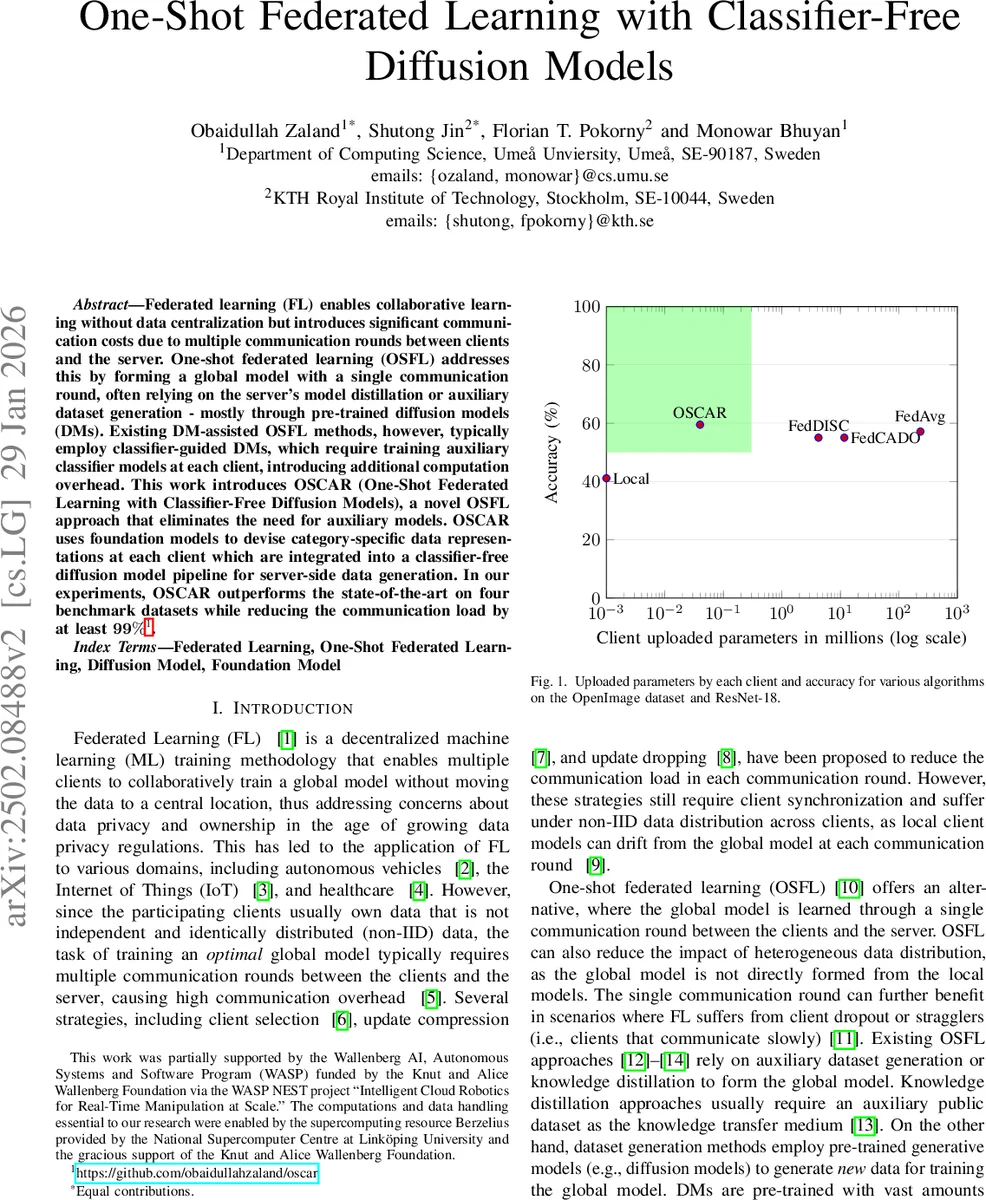

OSCAR는 클라이언트마다 별도 분류기를 학습할 필요 없이, 비전‑언어 모델(VLM)과 CLIP 텍스트 인코더를 이용해 카테고리별 텍스트 임베딩을 생성하고 이를 클래스‑프리 확산 모델에 조건으로 제공한다. 서버는 이 임베딩을 받아 합성 데이터를 대량 생성하고, 이를 기반으로 전역 ResNet‑18 분류기를 학습한다. 결과적으로 기존 DM‑기반 원샷 연합학습 대비 통신량을 99 % 이상 절감하면서 네 개 벤치마크 데이터셋에서 최고 정확도를 달성한다.

상세 분석

본 논문은 연합학습(Federated Learning, FL)에서 가장 큰 병목 중 하나인 다중 라운드 통신 비용을 근본적으로 해소하고자 ‘원샷 연합학습(One‑Shot FL, OSFL)’에 초점을 맞춘다. 기존 OSFL 방식은 서버 측에서 사전 학습된 확산 모델(Diffusion Model, DM)을 활용해 가짜 데이터를 생성하고, 이를 기반으로 전역 모델을 학습한다. 그러나 대부분의 연구가 ‘분류기‑가이드(Classifier‑Guided)’ 방식에 의존해, 각 클라이언트가 별도 분류기를 학습·전송해야 하는 추가적인 연산·통신 부하를 야기한다.

OSCAR는 이러한 한계를 ‘분류기‑프리(Classifier‑Free)’ 확산 모델과 최신 파운데이션 모델(Foundation Model, FM)을 결합함으로써 극복한다. 구체적으로 각 클라이언트는 (1) BLIP과 같은 비전‑언어 모델을 이용해 로컬 이미지에 대한 자연어 설명을 생성하고, (2) CLIP 텍스트 인코더로 해당 설명을 고차원 텍스트 임베딩(y_cn)으로 변환한다. 이후 동일 카테고리 내 모든 임베딩을 평균(ȳ_c)하여 하나의 대표 벡터로 압축한다. 이 과정은 파라미터 전송량을 이미지 수 대비 수백 배 감소시키며, 텍스트 임베딩 자체가 클래스 정보를 충분히 함축하므로 별도 라벨링 모델이 불필요하다.

서버는 평균된 ȳ_c를 클래스‑프리 확산 모델(Stable Diffusion)에 조건으로 입력한다. 클래스‑프리 방식은 조건부 확산 모델과 무조건부 모델의 스코어 차이를 이용해 ˆε_t = (1+s)·ε_θ(x_t,t,ȳ_c) – s·ε_θ(x_t,t,∅) 로 샘플링한다. 여기서 s=7.5, T=50 등 고정 하이퍼파라미터를 사용해 각 카테고리당 10장의 합성 이미지를 생성, 전체 합성 데이터셋 D_syn = 10·|R|·C 를 만든다.

생성된 D_syn을 이용해 서버는 ResNet‑18 분류기를 학습하고, 최종 모델을 클라이언트에 배포한다. 이때 클라이언트는 추가 학습 없이 바로 추론에 활용 가능하다. 실험에서는 NICO++(Common/Unique), DomainNet(90카테고리), OpenImage(120카테고리) 등 네 개 데이터셋에서 기존 SOTA인 FedCADO와 FedDISC을 능가했으며, 특히 통신량은 클라이언트당 파라미터 업로드가 수십만 개에서 수백 개 수준으로 99 % 이상 감소했다.

핵심 기여는 다음과 같다. (1) 파운데이션 모델을 활용해 라벨‑프리 텍스트 임베딩을 생성, 분류기 학습 비용을 완전 제거. (2) 클래스‑프리 확산 모델과의 자연스러운 결합으로 고품질 합성 데이터를 확보, 전통적인 DM‑가이드 방식 대비 생성 효율성 및 품질 향상. (3) 단일 라운드 통신으로 비동기·낙오 클라이언트 상황에서도 견고한 전역 모델 구축 가능. (4) 다양한 백본(ResNet‑18 외)에서도 합성 데이터의 활용 가능성을 입증, 파운데이션 모델 기반 OSFL의 확장성을 시사한다.

한계점으로는 (i) 텍스트 설명 생성 품질이 이미지 도메인에 따라 편차가 있을 수 있어, 복잡한 도메인(스케치·클립아트)에서는 성능 저하가 관찰된다. (ii) 현재는 고정된 VLM·CLIP·Stable Diffusion을 ‘freeze’ 상태로 사용했으나, 파인‑튜닝을 통해 도메인 적합성을 높일 여지가 있다. (iii) 합성 데이터 양을 10배로 제한했는데, 더 큰 규모나 다중 샘플링 전략이 전역 모델 성능에 미치는 영향을 추가 연구가 필요하다.

전반적으로 OSCAR는 파운데이션 모델과 클래스‑프리 확산 모델을 결합한 새로운 OSFL 패러다임을 제시하며, 통신 효율성과 모델 성능을 동시에 달성한다는 점에서 연합학습 연구에 중요한 전환점을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기