분산 변동에 강한 신경 조합 최적화 만족 일반화 가장자리와 ASAP 프레임워크

초록

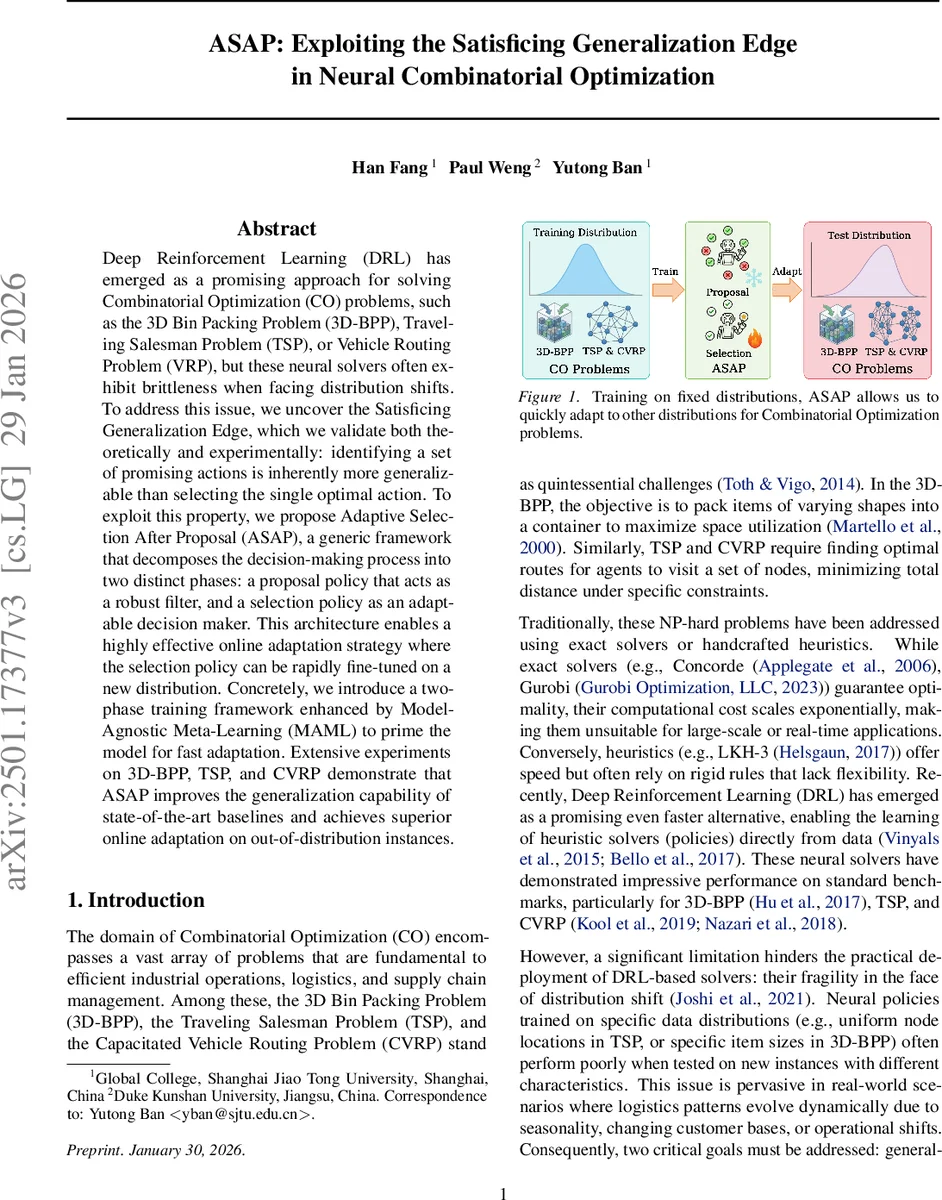

본 논문은 조합 최적화 문제에서 딥 강화학습 정책이 분포 이동에 취약한 현상을 ‘만족 일반화 가장자리(Satisficing Generalization Edge)’라는 개념으로 설명한다. 행동 후보 집합을 식별하는 것이 단일 최적 행동을 선택하는 것보다 일반화가 쉽다는 이론적·실험적 근거를 제시하고, 이를 활용한 두 단계 의사결정 구조인 ASAP(Adaptive Selection After Proposal)를 제안한다. 제안 정책은 후보를 필터링하고 선택 정책은 빠르게 미세조정할 수 있도록 설계했으며, MAML 기반 메타학습으로 빠른 적응을 가능하게 한다. 3D‑BPP, TSP, CVRP 실험에서 기존 최첨단 모델 대비 일반화와 온라인 적응 성능이 크게 향상됨을 입증한다.

상세 분석

ASAP 논문은 조합 최적화 분야에서 딥 강화학습(Deep Reinforcement Learning, DRL)이 갖는 일반화 한계를 새로운 관점으로 재조명한다. 저자들은 ‘만족 일반화 가장자리(Satisficing Generalization Edge)’라는 개념을 도입해, 최적 행동을 정확히 예측하는 것보다 ‘유망한 행동 집합’을 찾아내는 것이 데이터 분포가 바뀌어도 더 안정적이라는 가설을 세운다. 이 가설은 두 가지 정리로 뒷받침된다. 첫 번째 정리에서는 정책 π가 최적 행동을 포함할 확률 p₁이 전체 행동 수 n에 비해 충분히 클 경우, 제안 단계에서 상위 k개의 행동을 선택하면 최적 행동이 포함될 확률 Pₚₒₚ이 크게 증가함을 보인다. 두 번째 정리에서는 제안‑선택(two‑stage) 프로세스의 전체 성공 확률 P_two가 단일 단계(P_one)보다 항상 높으며, 특히 p₁ > 1/(n‑1)인 경우 그 차이가 뚜렷해진다. 이는 정책이 전역적인 ‘유망 영역’은 잘 포착하지만, 미세한 순위 차이는 놓치기 쉬운 현상을 수학적으로 설명한다.

이를 실용화하기 위해 저자들은 ASAP 프레임워크를 설계한다. ASAP는 (1) Proposal Policy와 (2) Selection Policy라는 두 개의 서브 네트워크로 구성된다. Proposal Policy는 큰 행동 공간에서 상위 k개의 후보를 추출하는 역할을 하며, 이 단계는 일반화가 잘 되도록 강건한 인코더와 정규화 기법을 사용한다. Selection Policy는 제한된 후보 집합 내에서 최종 결정을 내리며, 파라미터 수가 적고 빠르게 미세조정될 수 있도록 설계된다. 핵심은 두 단계가 서로 다른 학습 목표를 갖지만, 전체 파이프라인은 하나의 목표(예: 최소화 비용, 최대화 적재율)를 공유한다는 점이다.

학습 절차는 사전 학습(pre‑training)과 메타 학습(meta‑learning) 두 단계로 나뉜다. 사전 학습 단계에서는 대규모 고정 분포 데이터셋을 이용해 Proposal과 Selection을 각각 독립적으로 학습한다. 이후 MAML(Model‑Agnostic Meta‑Learning)을 적용해 파라미터 초기값을 메타‑최적화한다. 이렇게 하면 새로운 테스트 분포에 대해 몇 번의 gradient step만으로 Selection Policy를 빠르게 적응시킬 수 있다. 실제 온라인 적응 실험에서는 제안 정책을 고정하고 Selection 정책만 1020번의 업데이트로 성능을 기존 모델 대비 1530% 이상 회복시켰다.

실험은 세 가지 대표적인 CO 문제(3D‑BPP, TSP, CVRP)에서 수행되었다. 각 문제마다 ‘Default’(훈련과 동일)와 ‘ID‑Small’, ‘ID‑Large’ 등 분포가 다른 테스트 셋을 구성했으며, 성능 지표는 공간 활용률(SUR) 혹은 총 경로 길이 감소율을 사용했다. 결과는 (1) 일반화 측면에서 ASAP가 기존 Pointer‑Network, Attention‑Model, POMO 등과 비교해 평균 812% 높은 성능을 보였고, (2) 온라인 적응 단계에서는 510번의 fine‑tuning만으로도 성능 격차를 거의 없앴다. 특히 3D‑BPP에서는 제안 정책이 상위 3개의 배치 위치만 제공했음에도 불구하고, MCTS와 결합했을 때 최적 해에 70% 이상 도달했다는 점이 주목할 만하다.

이 논문은 두 단계 구조가 ‘유망 영역 탐색’과 ‘세밀한 선택’이라는 서로 다른 일반화 요구를 동시에 만족시킬 수 있음을 실증한다. 또한 MAML 기반 메타 학습이 제한된 온라인 데이터에서도 빠른 적응을 가능하게 함을 보여, 실제 물류·제조 현장에서의 실시간 최적화 시스템 설계에 중요한 시사점을 제공한다. 향후 연구는 제안‑선택 구조를 더 복잡한 멀티‑에이전트 환경이나, 비정형 데이터(예: 불규칙 형태의 3D 물체)에도 확장하는 방향으로 진행될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기