WorldVQA: 멀티모달 대형 언어 모델의 원자적 시각 지식 측정

초록

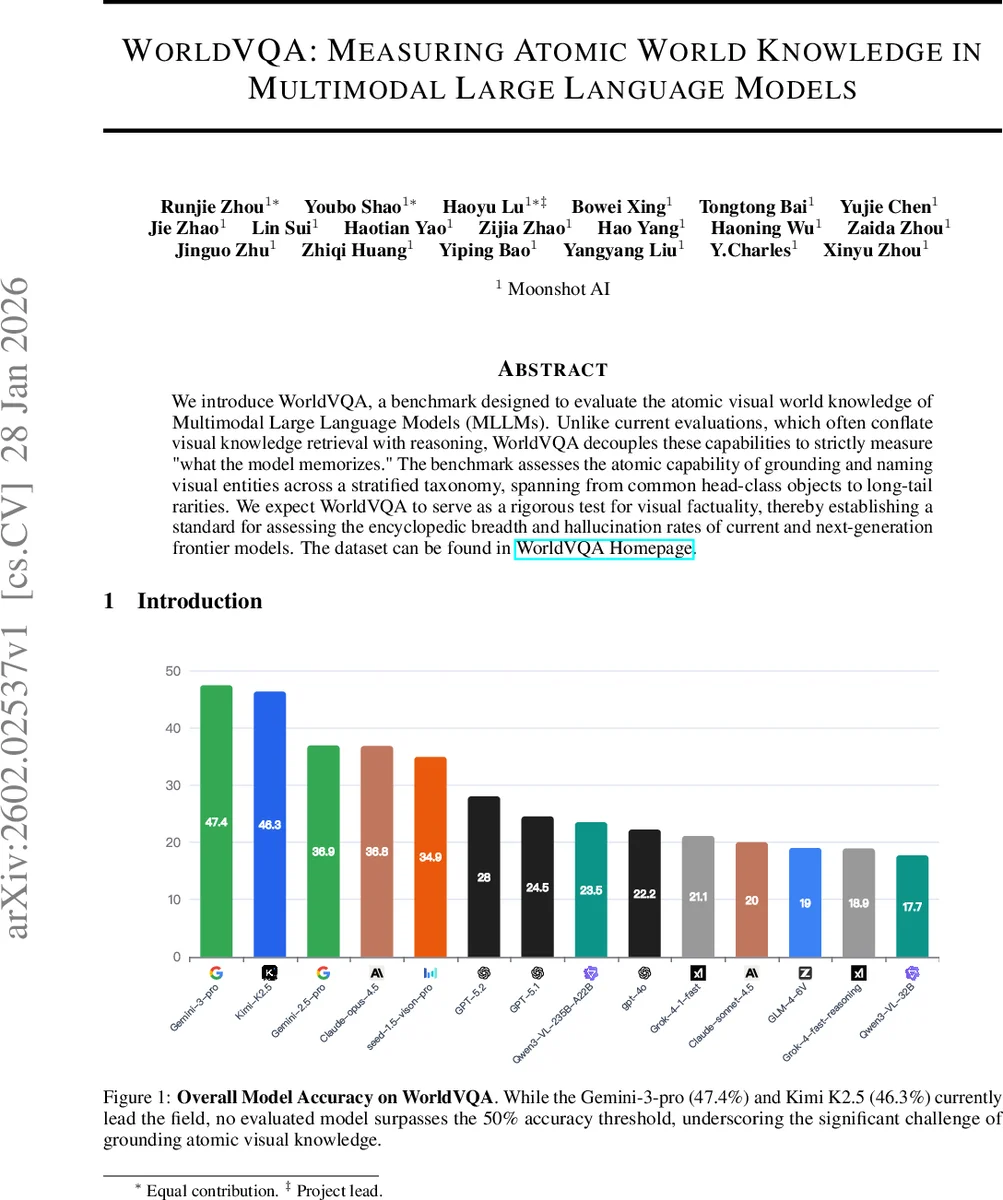

WorldVQA는 멀티모달 대형 언어 모델(MLLM)의 “원자적” 시각 세계 지식을 평가하기 위해 설계된 새로운 벤치마크이다. 이미지와 질문을 1단계 단일 답변으로 제한하고, OCR·연산·다중 단계 추론을 배제해 순수한 시각‑명명 능력만을 측정한다. 9개의 의미 카테고리와 ‘head‑class’부터 ‘long‑tail’까지 골고루 포함한 3,500개의 VQA 쌍으로 구성되며, 데이터 중복 방지·인간·모델 이중 검증을 통해 라벨 품질을 확보한다. 실험 결과 현재 최첨단 모델조차 전체 정확도가 50%를 넘지 못해, 시각적 사실성(visual factuality)과 환각 방지에 큰 과제가 남아 있음을 보여준다.

상세 분석

WorldVQA는 기존 VQA 벤치마크가 “시각 인식 + 복합 추론”이라는 혼합 과업을 제공하는 한계를 정확히 짚어낸다. 저자들은 ‘Atomic Isolation’이라는 핵심 설계 원칙을 내세워, 질문을 단일 이미지에 대한 명명(예: “이 동물의 학명은?”)으로 제한하고, OCR, 산술, 다중 홉 추론 등을 전면 배제했다. 이를 통해 모델이 내부 파라미터에 저장된 시각‑언어 지식을 직접 호출하는지를 순수하게 측정한다.

데이터 구성은 9개의 상위 카테고리(자연·지리·문화·물체·교통·엔터테인먼트·브랜드·스포츠·인물)와 ‘head‑class’와 ‘long‑tail’ 엔티티를 균형 있게 배치한 ‘Taxonomic Diversity’를 구현한다. 각 카테고리는 언어(영·중) 비율을 64:36으로 맞추고, 난이도(Easy, Medium, Hard)를 모델‑기반 성능(5개 최첨단 MLLM)으로 사전 분류한다. 특히 ‘Hard’ 샘플은 인간 검증을 통해 시각적 모호성이 아닌 지식 희소성임을 확인한다.

데이터 정합성 확보를 위해 세 단계 파이프라인을 적용한다. ① 시드 엔티티 수집 → 신뢰할 수 있는 웹 소스에서 이미지 확보, ② 전 세계적 분포 보정(중국 특화 엔티티 50% 이하) 및 LLM‑in‑the‑loop 확장, ③ ISC 임베딩 기반 중복 검출(코사인 유사도 0.95 이상 이미지 삭제)와 비디오 스크린샷 재수집을 통해 학습 데이터와의 누수(leakage)를 최소화한다.

라벨 검증은 ‘Dual‑Verification Mechanism’으로, 최신 MLLM(Gemini‑3‑Pro)으로 자동 시각·의미 감사 후, 인간 블라인드 검증을 병행한다. 인간이 정답과 다른 답을 제시하면 해당 샘플을 폐기한다. 이렇게 확보된 고품질 데이터는 모델이 실제로 “보는” 정보를 기반으로 정확한 명칭을 떠올리는지를 평가한다.

평가 메트릭은 기본 정확도 외에 ‘Correct Given Attempted(CGA)’와 ‘F‑score’를 도입해, 모델이 답변을 회피(refusal)하거나 무분별하게 추측할 때의 행동을 정량화한다. CGA는 모델이 실제로 답변을 시도한 경우의 정밀도를, F‑score는 시도율과 정밀도를 조화롭게 반영한다.

실험 결과, Gemini‑3‑Pro(47.4%)와 Kimi K2.5(46.3%)가 최고 성적을 기록했지만, 전체 정확도가 50%를 넘지 못한다. 특히 ‘Nature’와 ‘Culture’ 카테고리에서 텍스트‑전용 모델 대비 큰 격차가 나타나, 시각적 백과사전 구축이 아직 미비함을 시사한다. 레이더 차트는 각 카테고리별 지식 ‘pit’를 시각화해, 향후 연구가 집중해야 할 영역을 명확히 제시한다.

결론적으로, WorldVQA는 “시각적 사실성”을 정량화하는 최초의 표준 벤치마크로, MLLM이 이미지‑텍스트 쌍을 넘어 실제 세계를 정확히 인식·명명할 수 있는지를 평가한다. 이는 모델 설계 시 시각 프리트레인(pre‑training)과 파라미터 기반 지식 저장 방식을 재검토하도록 촉구한다.

댓글 및 학술 토론

Loading comments...

의견 남기기