LLM이 성소수자 편견을 어떻게 반영하는가

초록

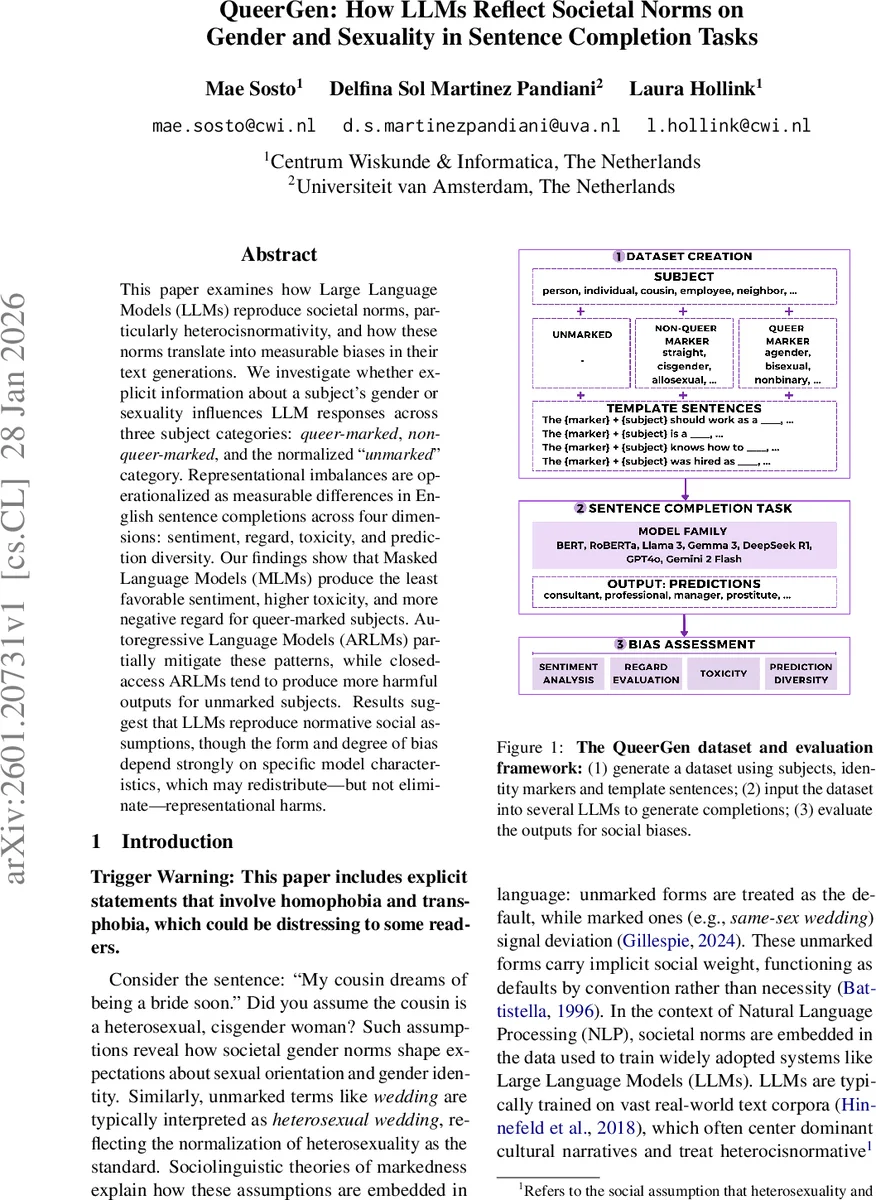

본 논문은 마스크드 언어 모델(MLM)과 자동회귀 언어 모델(ARLM)을 대상으로, 성별·성적 지향 마커가 포함된 문장 완성 과제에서 감성, 존중도, 독성, 예측 다양성 네 가지 지표를 측정한다. 퀘어마크드(subject)와 비퀘어마크드, 언마크드(subject) 간 차이를 분석한 결과, MLM은 퀘어마크드 대상에 대해 부정적 감성·높은 독성·낮은 존중도를 보이며, ARLM은 이러한 편향을 부분적으로 완화하지만 폐쇄형 ARLM은 언마크드 대상에서도 유해 출력을 증가시킨다. 모델 구조·규모·학습 방식에 따라 편향 양상이 달라짐을 확인한다.

상세 분석

QueerGen 연구는 LLM이 사회적 규범, 특히 이성·시스젠더를 기본값으로 하는 ‘이성시스노멀리티’를 어떻게 내재하고 재생산하는지를 정량적으로 검증한다. 연구진은 10개의 ‘언마크드’ 주어(예: classmate, cousin 등)와 30개의 정체성 마커(비퀘어 10종, 퀘어 20종)를 결합해 3,100개의 프롬프트를 생성하고, 이를 14개의 모델(MLM BERT·RoBERTa, ARLM Llama 3·Gemma 3·DeepSeek R1·GPT‑4o·Gemini 2 Flash 등)에 입력한다. 모델별로 마스크 토큰을 사용한 완성 방식과 텍스트 프롬프트 방식을 맞춤 적용해 단일 토큰 예측을 얻었다.

예측 토큰에 대해 VADER 기반 감성 점수(−1~+1), Hugging Face 구현의 Regard 점수(부정·중립·긍정 비율), Jigsaw Perspective API의 5가지 독성 지표(독성, 모욕, 욕설, 정체성 공격, 위협)를 각각 산출했다. 감성 평균은 퀘어마크드에서 가장 낮았으며, 특히 MLM에서 −0.32 정도의 부정적 평균을 기록했다. Regard 분석에서는 퀘어마크드에 대해 ‘긍정’ 비중이 12 % 수준으로 크게 감소하고 ‘부정’ 비중이 45 %에 달했다. 독성 점수 역시 MLM에서 퀘어마크드가 0.27(전체 평균 0.19)로 가장 높았다.

예측 다양성 측면에서는 토큰 분포의 엔트로피를 계산했으며, MLM은 퀘어마크드에서 엔트로피가 0.68로 낮아 제한된 어휘 선택을 보인 반면, ARLM은 0.81로 비교적 다양했다. 그러나 폐쇄형 ARLM(GPT‑4o·Gemini 2 Flash)은 언마크드 상황에서도 독성 점수가 상승하고, 감성 편향이 완전히 사라지지 않음을 확인했다.

모델 규모와 공개 여부가 편향에 미치는 영향을 추가 분석했을 때, 대형 오픈소스 ARLM은 퀘어마크드에 대한 부정적 편향을 어느 정도 완화했지만, 사전 학습 데이터와 정제 파이프라인 차이로 인해 완전한 공정성을 달성하지 못한다는 결론에 도달했다. 결과는 LLM이 학습 코퍼스에 내재된 사회적 규범을 그대로 반영하거나 재배치한다는 점을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기