점진적 행동 공간 확장으로 강화학습 효율을 높인 GPO

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

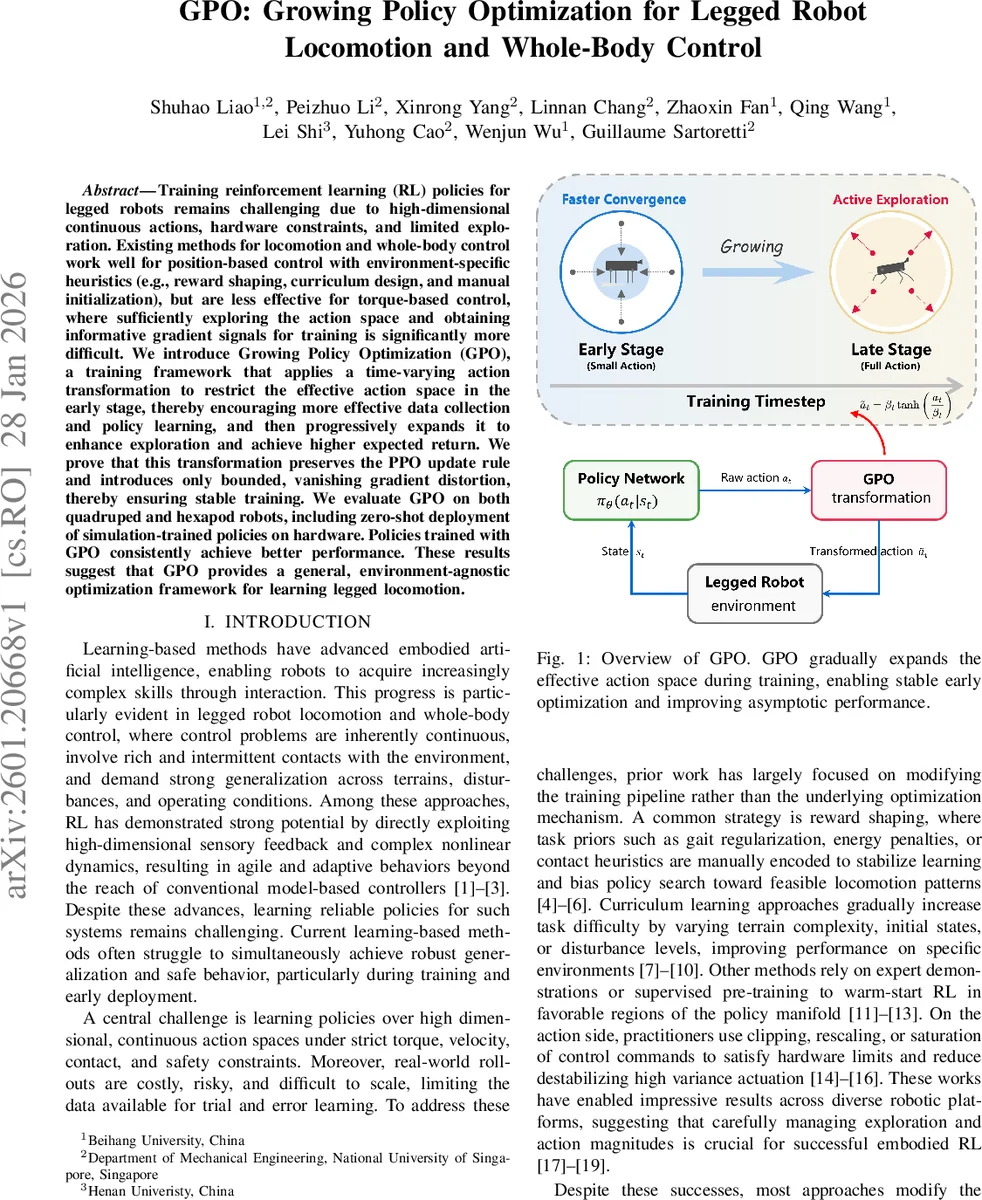

GPO는 학습 초기에 행동 공간을 제한하고, 훈련이 진행될수록 점진적으로 확대하는 시간‑가변 변환을 도입해 토크 기반 다족 로봇의 강화학습을 안정화한다. 변환이 PPO 업데이트 구조를 보존하고, 그래디언트 왜곡을 유계·소멸하게 함을 증명함으로써 초기 단계의 신호‑대‑잡음비를 높이고, 후기에는 탐색 능력을 회복한다. 시뮬레이션 및 실제 사족·육각 로봇 실험에서 GPO는 기존 PPO 대비 빠른 수렴과 높은 최종 성능을 달성한다.

상세 분석

본 논문은 고차원 연속 토크 제어를 필요로 하는 다족 로봇에 적용되는 강화학습의 핵심 문제, 즉 초기 단계에서의 과도한 탐색으로 인한 그래디언트 분산 증가와 안전 제약 위반을 해결하고자 한다. 기존 PPO는 고정된 행동 공간을 전제로 하여, 학습 초기에 전체 토크 범위를 그대로 사용한다. 이는 큰 액션 변동성을 초래하고, 정책 그라디언트의 분산을 급격히 늘려 수렴을 방해한다. GPO는 이 문제를 “행동 공간 성장(action space growth)”이라는 개념으로 접근한다. 구체적으로, 정책 네트워크가 출력하는 잠재 액션 a에 대해

\

댓글 및 학술 토론

Loading comments...

의견 남기기