다중턴 ECG 대화를 위한 온디바이스 툴콜링 LLM, ECG‑Agent

초록

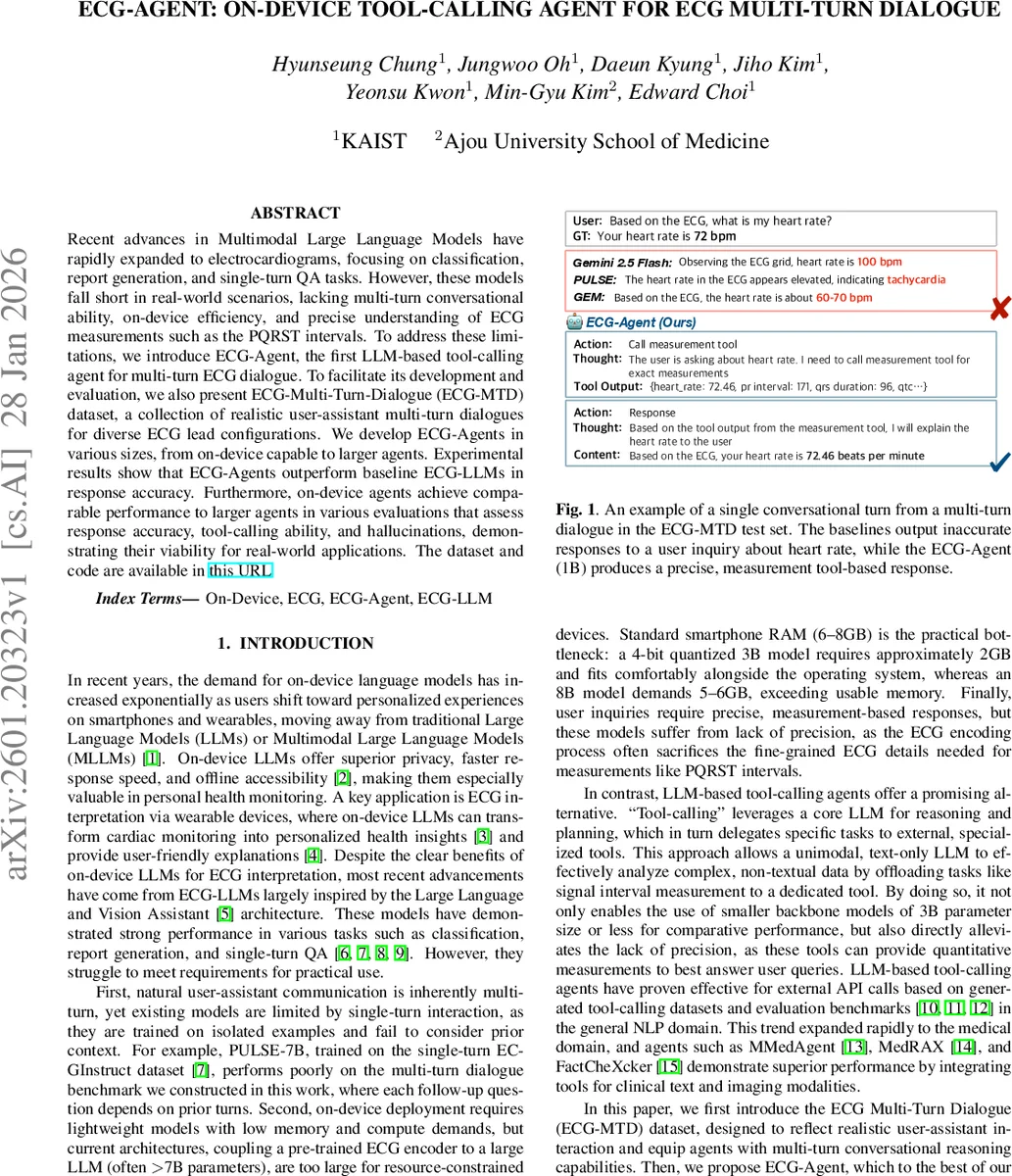

ECG‑Agent는 ECG 데이터를 이해하고 측정·분류·설명 툴을 호출해 다중턴 대화를 수행하는 최초의 온디바이스 LLM이다. 이를 위해 12‑lead, Lead I, Lead II 환경을 포괄하는 ECG‑MTD 데이터셋을 구축하고, 1 B~32 B 규모의 모델을 LoRA 기반으로 instruction‑tuning했다. 실험 결과, 온디바이스(≤4 B) 모델도 대형 모델에 근접한 정확도·완전도와 툴콜 정확성을 보이며, 기존 ECG‑LLM 대비 응답 정확도가 크게 향상되었다.

상세 분석

본 논문은 기존 ECG‑LLM이 단일턴 질의·응답에 머물러 다중턴 대화 흐름을 지원하지 못하고, 온디바이스 배치 시 메모리·연산 요구량이 과다하다는 두 가지 근본적인 한계를 정확히 짚어낸다. 이를 해결하기 위해 제안된 ECG‑Agent는 “툴콜링” 패러다임을 차용한다. 핵심 아이디어는 텍스트‑전용 LLM이 사용자 의도를 reasoning‑thought 단계에서 파악하고, 필요 시 전문화된 외부 툴(분류, 측정, 설명)로 작업을 위임하는 것이다. 이렇게 하면 LLM 자체는 경량화된 모델(1 B~3 B)로도 고정밀 ECG 파라미터(예: P‑R‑interval, QRS‑duration, QTc 등)를 얻을 수 있다.

데이터셋 구축 과정도 주목할 만하다. 저자들은 HealthCareMagic‑100k와 icliniq‑10k에서 ECG 관련 대화를 추출하고, CEFR 기준 3단계(기초·중급·고급) 언어 수준을 반영해 사용자 발화의 난이도를 다양화했다. 또한, 7개의 임상 토픽(심박수, 부정맥, 치료·예방 등)과 20개의 행동 시퀀스를 정의해, “ECG inquiry → 툴 호출 → 응답 → 후속 질문” 형태의 실제 상담 흐름을 시뮬레이션한다. 이러한 구조화된 시나리오는 툴콜링 에이전트가 언제, 어떤 툴을 호출해야 하는지를 명시적으로 학습하게 만든다.

모델 학습에서는 Llama‑3.2(1 B/3 B)와 Qwen‑3(32 B)를 베이스로 LoRA(r=16, α=16)를 적용해 파라미터 효율성을 극대화했다. 입력 시퀀스는 최대 4096 토큰으로 설정해 전체 대화 히스토리를 포함시켰으며, “thought” 라벨을 통해 LLM이 내부 reasoning 과정을 명시하도록 instruction‑tuning을 수행했다. 이는 툴 호출 시점과 직접 응답 시점을 정확히 구분하게 하여, NAP(Next Action Prediction)와 Faithfulness(툴 출력과 응답 일치) 지표에서 높은 점수를 얻는 원동력이 된다.

평가에서는 Gemini‑2.5‑Pro를 LLM‑as‑a‑Judge로 활용해 정확도와 완전도(15점)를 자동 채점했으며, 300개 샘플에 대해 인간 평가를 추가해 자동 평가의 신뢰성을 검증했다. 결과적으로 12‑lead, Lead I, Lead II 각각에서 ECG‑Agent(특히 3 B 모델)는 기존 ECG‑LLM(Llama‑3.2‑Flash, PULSE, GEM) 대비 정확도·완전도가 1.52점 이상 상승했다. 특히 온디바이스 1 B 모델도 8 B·32 B 대형 모델과 통계적으로 유의미한 차이가 없으며, 툴콜 정확도(NAP 70% 이상)와 응답 일관성(Faithfulness 85% 이상)에서도 경쟁력을 보였다.

한계점으로는 설명 툴(SpectralX)이 다변량 12‑lead ECG에 적용되지 못한 점, 그리고 생성된 데이터가 실제 환자와의 인터랙션을 완전히 대체하지 못한다는 점을 들 수 있다. 향후 실제 임상 데이터와의 연계, 툴 다양화(예: 위험도 예측, 치료 권고) 및 사용자 프라이버시 보호를 위한 안전 메커니즘이 필요하다. 전반적으로 본 연구는 온디바이스 의료 AI가 실시간, 개인 맞춤형 ECG 상담을 제공할 수 있는 실용적 로드맵을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기