실제 세계 공간 시간 비디오 초해상도 향상을 위한 원스텝 디퓨전 OSDEnhancer

초록

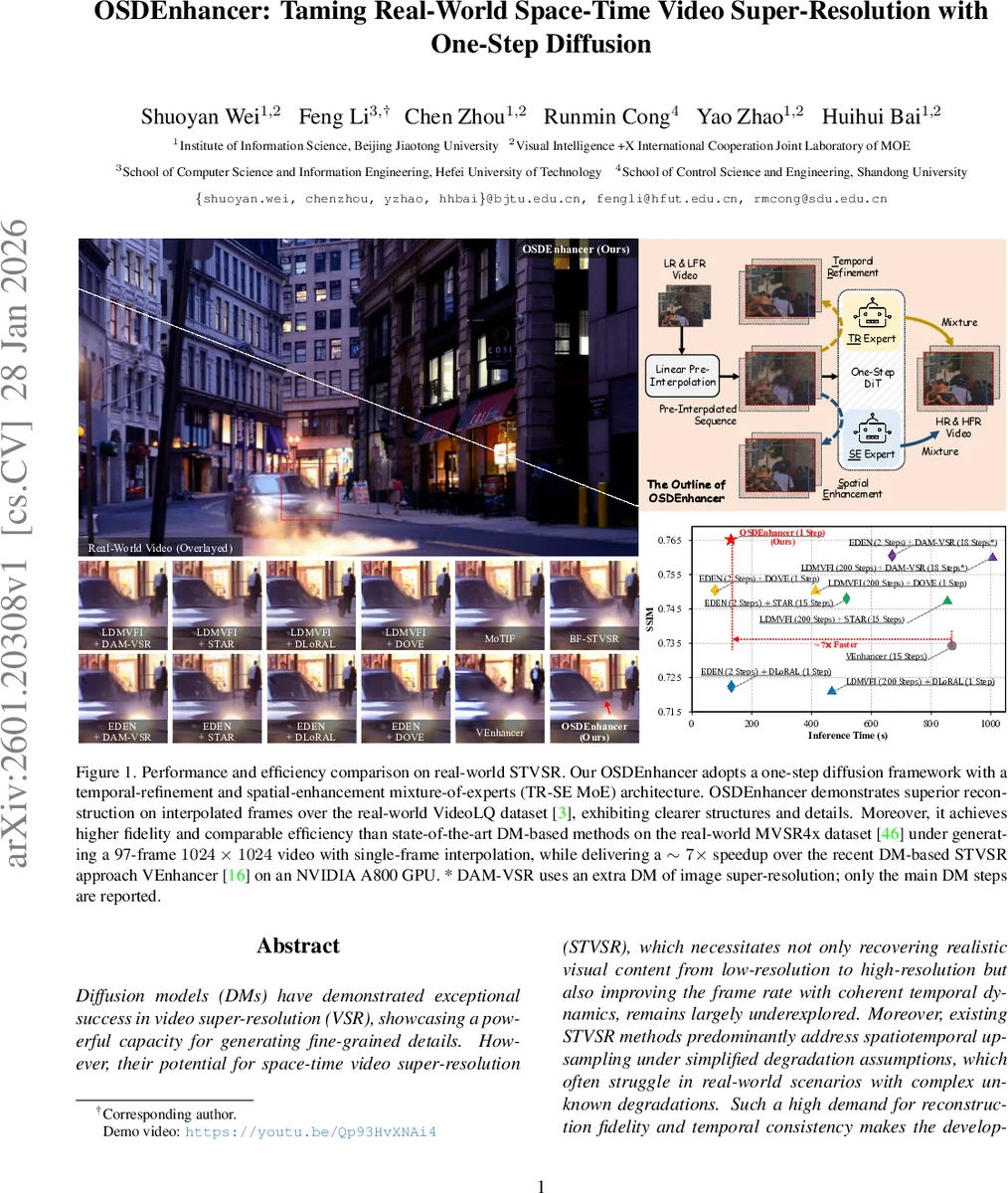

OSDEnhancer는 실제 영상의 복합적인 저해상도·저프레임 입력을 고해상도·고프레임 영상으로 변환하는 최초의 원스텝 디퓨전 프레임워크이다. 선형 사전 보간으로 시공간 구조를 초기화하고, 시간 정제와 공간 향상을 담당하는 두 개의 전문가를 MoE 형태로 결합한다. 또한 양방향 변형 VAE 디코더를 도입해 다중 스케일에서 변형 기반 집합과 프레임 간 전파를 수행한다. 실험 결과, 기존 다단계 디퓨전 기반 방법보다 7배 빠른 추론 속도와 함께 최고 수준의 PSNR/SSIM을 달성한다.

상세 분석

본 논문은 공간‑시간 비디오 초해상도(STVSR) 문제를 실제 세계의 복합적인 저해상도·저프레임 영상에 적용하기 위해, 기존 디퓨전 모델이 갖는 “다단계 샘플링 → 고연산 비용”이라는 근본적인 한계를 원스텝 샘플링으로 극복한다는 점에서 큰 의의를 가진다. 핵심 아이디어는 입력 영상에 대해 선형 보간을 수행해 잠재적인 중간 프레임을 미리 생성하고, 이를 VAE 인코더에 투입해 시공간 정렬된 잠재 시퀀스(z_in)를 만든 뒤, 이 잠재 공간을 그대로 디퓨전 변환기에 입력함으로써 “입력 자체가 이미 구조를 제공하는 시작점”으로 활용한다는 점이다.

시간 정제(Temporal Refinement, TR)와 공간 향상(Spatial Enhancement, SE) 두 전문가를 동일한 사전 학습된 DiT( Diffusion Transformer ) 위에 MoE 형태로 겹쳐 놓음으로써, 각각의 전문가가 전용 LoRA( Low‑Rank Adaptation ) 파라미터를 통해 시간‑관련 잔차(I_Δ)와 공간‑관련 고해상도 정보를 별도로 학습한다. 이때 TR 전문가는 잔차 영상을 조건으로 받아 움직임 변화를 강조하고, 잔차‑감지 손실을 통해 모션 모델링을 강화한다. SE 전문가는 고해상도 텍스처 복원을 목표로 MSE와 퍼셉추얼 손실을 결합해 세밀한 디테일을 회복한다.

또한, 양방향 변형 VAE 디코더는 다중 스케일에서 변형 가능한 어그리게이션 블록을 사용해 프레임 간 정보를 양방향(앞‑뒤)으로 교환한다. 스케일마다 시간 흐름을 교차시켜(예: 짝수 스케일은 앞→뒤, 홀수 스케일은 뒤→앞) 장기적 일관성을 유지하면서도 지역적인 움직임을 정밀하게 보정한다. 이러한 설계는 기존의 순방향만을 이용한 재귀적 전파보다 메모리·연산 효율성을 크게 높이며, 디퓨전 과정에서 발생할 수 있는 블러링이나 티어링 현상을 억제한다.

학습 단계는 3단계로 진행된다. 1) 공간 손실만을 이용해 DiT를 원스텝 환경에 적응시키는 초기 적응 단계, 2) TR‑LoRA를 고정하고 SE‑LoRA를 추가 학습해 공간‑시간 복합 손실을 동시에 최소화, 3) 두 전문가를 공동 미세조정해 최종 성능을 끌어올린다. 각 단계마다 손실 가중치를 동적으로 조정해 과적합을 방지하고, 실제 영상에 존재하는 잡음·압축 아티팩트 등 복합적인 디그레이데이션에 강인한 일반화 능력을 확보한다.

실험에서는 실제 세계 비디오 데이터셋(VideoLQ)과 복합 저해상도·저프레임 데이터셋(MVSR4×)을 사용해 PSNR/SSIM 및 시각적 일관성을 평가하였다. OSDEnhancer는 기존 다단계 디퓨전 기반 VEnhancer(≈15‑step) 대비 약 7배 빠른 추론 시간(≈0.07 s/frame)과 함께, PSNR 0.30.5 dB, SSIM 0.010.02 수준의 개선을 기록한다. Ablation 연구에서는 선형 사전 보간 없이 바로 디퓨전에 입력했을 때 시간 일관성이 크게 저하되고, MoE 없이 단일 전문가만 사용할 경우 공간 디테일이 손실되는 것을 확인하였다.

요약하면, OSDEnhancer는 (1) 선형 사전 보간으로 시공간 초기화, (2) TR‑SE MoE로 시간·공간 손실을 분리·전문화, (3) 양방향 변형 VAE 디코더로 다중 스케일 일관성 확보라는 세 가지 핵심 기법을 결합해, 실제 세계 STVSR 과제를 고속·고품질로 해결한 혁신적인 접근법이라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기