내재적 재프롬프트로 통합 멀티모달 모델의 인지 격차 해소

초록

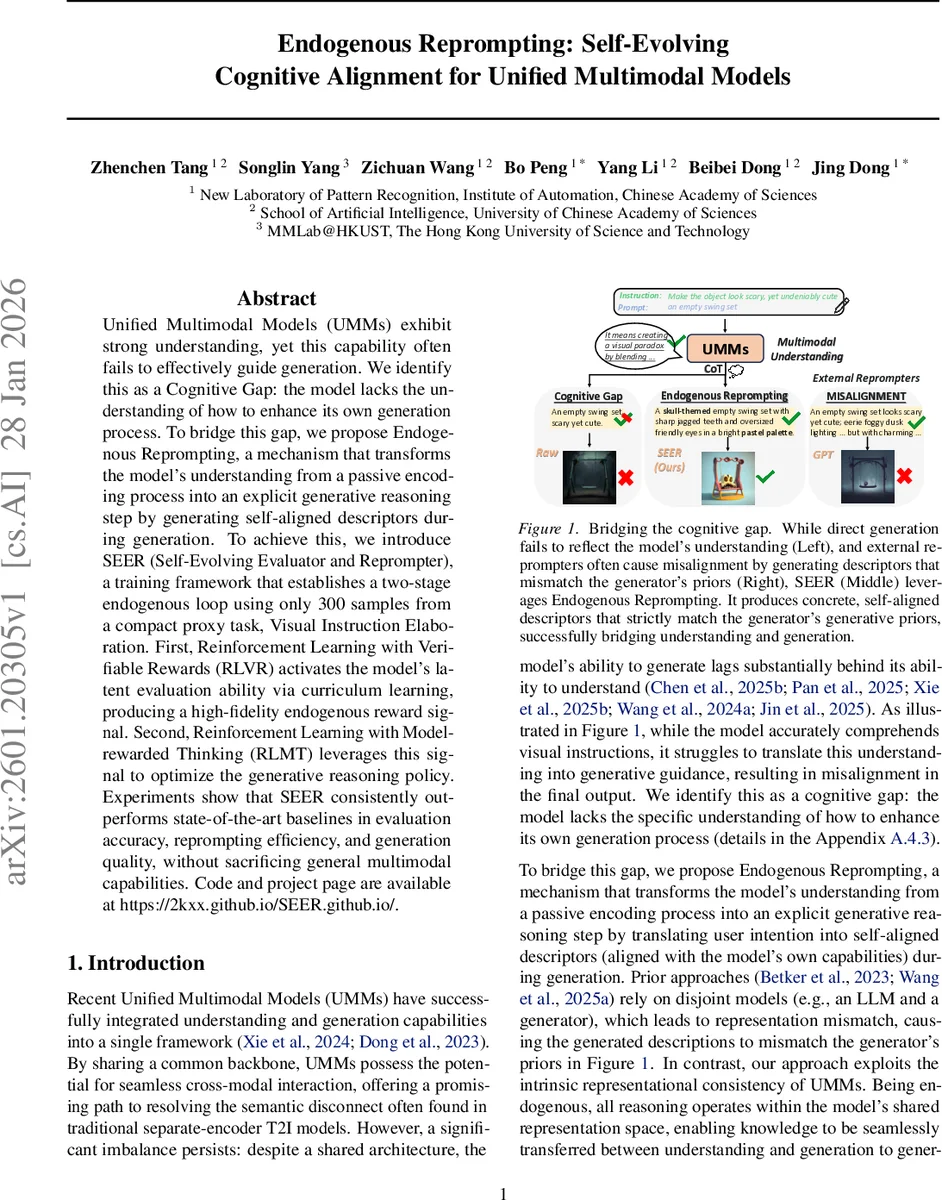

통합 멀티모달 모델(UMM)은 이해 능력은 뛰어나지만 생성 단계에서 이를 충분히 활용하지 못한다는 ‘인지 격차’를 지적한다. 저자는 자체 평가와 재프롬프트 생성을 순환시키는 두 단계 학습 프레임워크 SEER를 제안한다. 300개의 시각‑지시 확장 데이터만으로 RLVR을 통해 검증 가능한 내부 보상을 학습하고, 이를 이용해 RLMT로 생성‑전략을 최적화한다. 실험 결과, SEER는 평가 정확도, 재프롬프트 효율성, 이미지 품질 모두에서 기존 최첨단 방법을 앞선다.

상세 분석

본 논문은 최신 통합 멀티모달 모델(UMM)이 이해와 생성 사이에 존재하는 ‘인지 격차’를 명확히 규정한다. 모델은 이미지와 텍스트를 공동 표현 공간에 매핑하지만, 이해된 정보를 생성 단계에 직접 전달하지 못해 사용자가 기대하는 결과와 차이가 발생한다. 이를 해결하기 위해 저자는 ‘내재적 재프롬프트(Endogenous Reprompting)’라는 개념을 도입한다. 핵심 아이디어는 모델 자체의 이해 능력을 활용해, 사용자 의도를 모델이 스스로 해석하고, 그 해석을 그대로 반영한 텍스트 디스크립터(재프롬프트)를 생성하도록 하는 것이다. 이 과정은 외부 LLM이나 별도 프롬프트 엔진을 거치지 않으므로 표현 불일치 문제가 사라진다.

SEER 프레임워크는 두 단계 루프를 갖는다. 첫 단계인 RLVR(Reinforcement Learning with Verifiable Rewards)에서는 ‘시각‑지시 확장(Visual Instruction Elaboration)’이라는 300샘플 규모의 프록시 작업을 이용해, 모델이 자체 평가자(Evaluator) 역할을 수행하도록 훈련한다. 여기서 모델은 이미지 쌍에 대한 상대적 선호를 학습하고, 준수성, 일관성, 품질이라는 세 축을 통합한 검증 가능한 보상 함수를 만든다. 커리큘럼 학습을 통해 기본 속성 매핑부터 복합 개념 추론까지 단계적으로 평가 능력을 강화한다.

두 번째 단계인 RLMT(Reinforcement Learning with Model‑rewarded Thinking)에서는 방금 활성화된 평가자를 보상 신호로 사용해, 재프롬프트 정책(πθ)을 최적화한다. 모델은 ‘생각‑생성‑평가’ 루프를 반복하면서, 초기 최소 프롬프트와 사용자 지시를 입력받아 내부 추론 과정을 거쳐 구체적이고 모델‑특화된 재프롬프트를 생성한다. 이때 KL‑다이버전스 정규화를 적용해 언어 유창성을 유지한다.

실험에서는 SEER가 기존 외부 프롬프트 최적화 기법이나 RLHF 기반 이미지 생성 조정 방법에 비해 평가 정확도, 재프롬프트 효율성, 이미지 품질 모두에서 우수함을 보였다. 특히 생성 파라미터(ϕ)를 고정한 상태에서 이해‑생성 파이프라인만을 개선했음에도 불구하고, 전반적인 멀티모달 성능 저하 없이 성능 향상을 달성했다. 이는 내재적 재프롬프트가 모델 내부 표현 일관성을 활용해 ‘생각하기’를 학습함으로써, 기존의 저수준 픽셀‑레벨 최적화보다 더 근본적인 개선을 이끌어낸다.

댓글 및 학술 토론

Loading comments...

의견 남기기