전략적 정책 인식 탐색을 위한 핵심 상태 동적 분기

초록

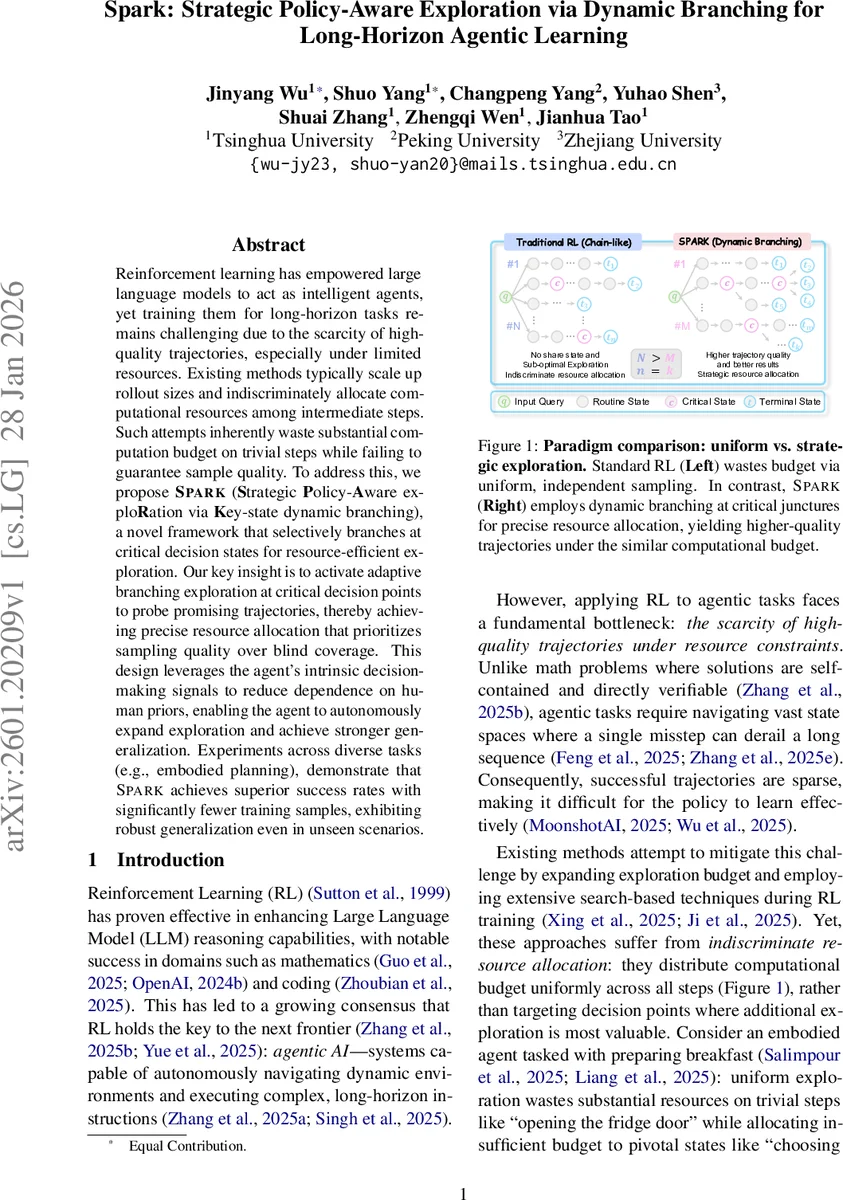

Spark는 장기 목표를 가진 에이전트 학습에서, 중요한 의사결정 지점에만 탐색을 집중하는 동적 분기 메커니즘을 제안한다. 내부

상세 분석

Spark는 장기‑ horizon 에이전트 학습의 핵심 문제인 “고품질 궤적의 희소성”을 해결하기 위해 동적 분기(Dynamic Branching) 라는 새로운 탐색 전략을 도입한다. 기존 RL 방법은 롤아웃 예산을 균등하게 할당해, 대부분의 트리비얼 단계에 불필요한 연산을 소비하고, 결정적인 전환점에서는 탐색이 부족한 구조적 한계를 가지고 있다. Spark는 에이전트가 생성하는 reasoning trace에 삽입된 <explore> 태그를 탐색 트리거 신호로 활용한다. 이 신호는 에피스테믹 불확실성 혹은 의미적 모호성을 감지했을 때 자동으로 발생하도록 사전 SFT 단계에서 학습된다.

핵심 메커니즘은 다음과 같다. 1) Root Initialization 단계에서 초기 상태에서 M개의 서로 다른 루트를 생성해 탐색 다양성을 확보한다. 2) 각 활성 트리 노드에서 <explore>가 감지되면 Branching Factor B 만큼의 자식 노드를 생성한다. 이때 전체 예산 N을 초과하지 않도록 Budget Enforcement 로직이 동적으로 b_eff = min(b, N‑N_current+1) 로 조정한다. 3) 완성된 리프 궤적은 동일 작업에 대해 그룹화되어 Tree‑Based Policy Update 단계에서 GRPO‑style 클리핑 최적화와 KL 제약을 이용해 정책을 업데이트한다.

이 설계는 핵심 상태(C)에서의 탐색 밀도를 기하급수적으로 증가시킨다. 수식 (8)에서 보듯, 단일 샘플링 시 성공 확률 q_t 를 B‑branching 시 q_branch_t = 1‑(1‑q_t)^B 로 변환함으로써, B≥2 일 때 반드시 q_branch_t > q_t 가 된다. 장기 과제는 다수의 핵심 결정 연쇄에 의존하므로, 이러한 확률 증가는 전체 성공 확률을 곱셈적으로 향상시킨다. 동시에 비핵심 단계에서는 선형 샘플링과 동일한 연산량만 사용하므로 토큰 사용량이 크게 늘어나지 않는다.

실험에서는 ALFWorld, ScienceWorld, WebShop 등 세 가지 도메인에서 1.5B·7B 규모의 Qwen2.5 모델을 사용했으며, N=8, M=4, B=2 라는 보수적인 설정에서도 기존 GRPO, GiGPO, RL‑VMR 등 최신 RL 기반 방법들을 크게 앞섰다. 특히 ScienceWorld L2와 같은 30‑step 이상 복잡한 과제에서 1.5B 모델이 49.2% 성공률을 기록, GPT‑5(33.6%)와 Gemini‑2.5‑Pro(30.5%)를 압도했다. 이는 전략적 탐색이 모델 규모와 무관하게 샘플 효율성을 극대화한다는 강력한 증거다.

한계점으로는 <explore> 태그의 정확도에 크게 의존한다는 점이다. 사전 SFT 단계에서 충분히 다양한 불확실성 상황을 학습시키지 못하면, 실제 환경에서 중요한 상태를 놓칠 위험이 있다. 또한 현재 구현은 이산적인 B값(보통 2)만 지원하므로, 연속적인 탐색 깊이 조절이나 비용‑편익 최적화와 같은 정교한 자원 배분 전략은 아직 미비하다. 향후 연구에서는 메타‑러닝 기반의 동적 B 조정 혹은 다중‑정책 앙상블을 결합해 더욱 세밀한 탐색 제어를 도입할 수 있을 것이다.

전반적으로 Spark는 “전략적·자율적 탐색”이라는 새로운 패러다임을 제시하며, 장기‑ horizon 에이전트 학습에서 연산 예산을 핵심 의사결정에 집중시키는 방법론적 혁신을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기