LVLM과 인간의 지시소통, 공통 기반 형성 차이

초록

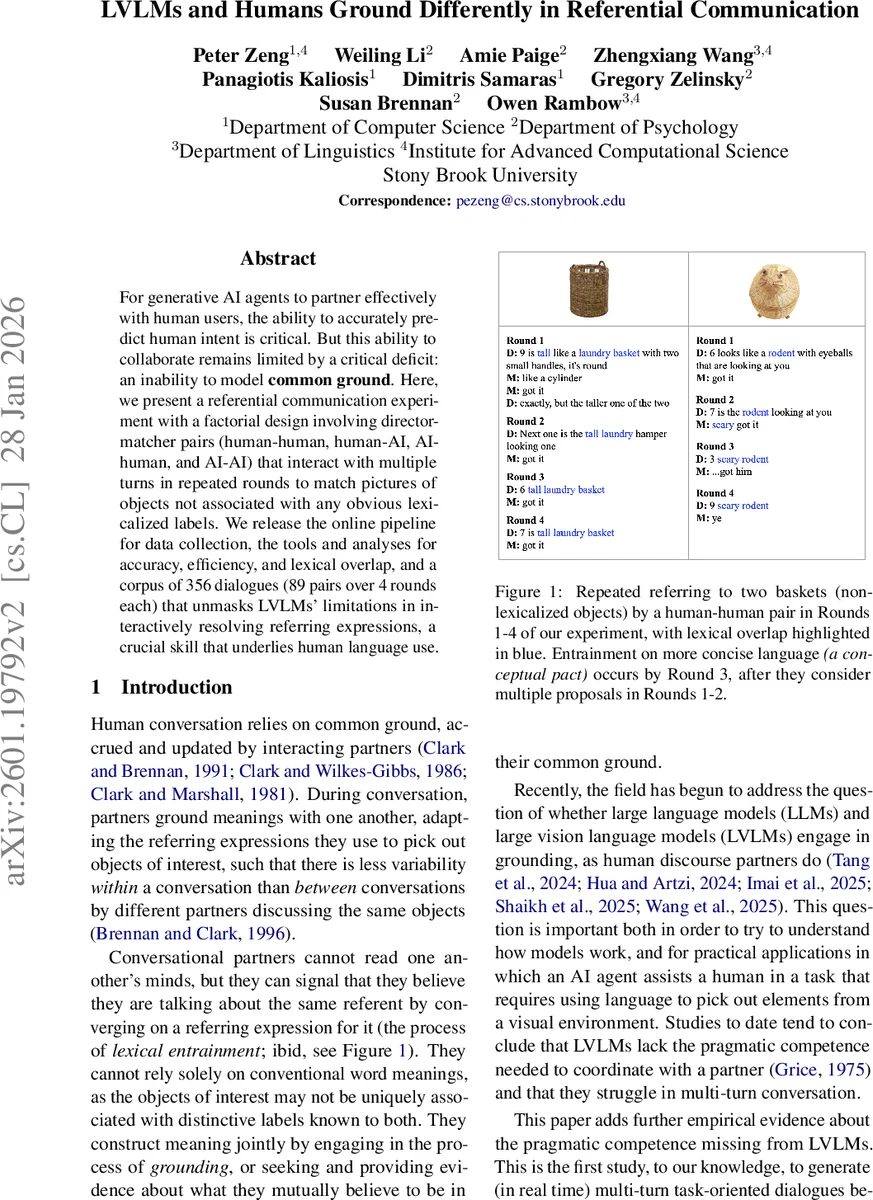

본 논문은 인간‑인간, 인간‑AI, AI‑인간, AI‑AI 네 가지 역할 조합으로 구성된 지시‑매칭 과제를 통해 대화 중 공통 기반(grounding) 형성 능력을 비교한다. 4라운드에 걸친 356개의 다중턴 대화를 수집·분석하고, 정확도, 커뮤니케이션 비용, 어휘 동조(lexical entrainment) 세 가지 지표를 제시한다. 실험 결과 LVLM(GPT‑5.2)은 인간 파트너와 비교해 정확도가 낮고, 라운드가 진행될수록 어휘 축소와 재사용이 거의 일어나지 않아 인간이 보이는 ‘개념적 협약(conceptual pact)’ 형성에 실패한다는 점을 밝혀냈다.

상세 분석

이 연구는 언어와 시각 정보를 동시에 처리하는 대형 비전‑언어 모델(LVLM)의 실용적 한계를 정량적으로 드러낸다. 먼저 실험 설계는 고전적인 Clark와 Wilkes‑Gibbs(1986)의 지시‑매칭 과제를 디지털 환경(oTree)으로 재현했으며, 동일한 12개의 비라벨 객체(바구니)를 4라운드에 걸쳐 반복 제시한다. 각 라운드에서 디렉터는 목표 순서를 텍스트로 서술하고, 매처는 화면상의 동일 객체를 선택한다. 인간‑인간 쌍은 라운드가 진행될수록 어휘 길이가 감소하고, 동일 어휘 재사용 비율(RLO)이 상승해 ‘어휘 동조’가 뚜렷이 나타난다. 이는 파트너가 서로의 의도를 점진적으로 추정하고, 불필요한 설명을 생략함으로써 커뮤니케이션 비용을 최소화한다는 기존 이론을 실증한다.

반면 LVLM을 디렉터 혹은 매처로 사용한 경우, 두 가지 역할 모두에서 정확도가 현저히 낮았다. 특히 AI‑AI 조합은 라운드가 진행될수록 정확도가 정체되거나 약간 감소했으며, 어휘 동조 지표가 거의 0에 가까워 인간 파트너와 달리 ‘개념적 협약’을 형성하지 못한다는 점이 두드러졌다. 이는 현재 LVLM이 대화 중 발생하는 미세한 의미 정렬(pragmatic alignment)과 오류 복구(repair) 메커니즘을 내재화하지 못한다는 증거로 해석할 수 있다.

모델 선택 측면에서도 흥미로운 점이 있다. 연구진은 GPT‑4o를 초기 프로토타입으로 사용했지만, 복잡한 12대 12 매칭 과제와 다중턴 상호작용을 감당하기에 부족함을 판단, 최신 GPT‑5.2(2025) 모델을 채택했다. 그럼에도 불구하고 ‘none’ 추론 옵션을 유지해 응답 속도는 인간 수준에 맞췄지만, 추론 깊이가 제한돼 대화 흐름을 파악하고 적절히 수정하는 능력이 크게 저하된 것으로 보인다.

평가 지표는 세 가지 축으로 구성된다. 첫째, 정확도(accuracy)는 라운드당 올바르게 매칭된 바구니 비율로, 인간‑인간 쌍은 라운드 4에서 거의 100%에 도달했지만 LVLM 기반 쌍은 60% 이하에 머물렀다. 둘째, 커뮤니케이션 비용은 총 단어 수와 턴 수로 측정했으며, 인간‑인간은 라운드가 진행될수록 두 지표가 현저히 감소해 효율성이 향상된 반면, AI‑AI는 오히려 단어 수가 증가하거나 변동이 적어 비효율성을 드러냈다. 셋째, 어휘 동조(RLO)는 현재 라운드와 이전 라운드 사이의 내용어 겹침 비율로 정의했으며, 인간‑인간은 0.45~0.68 사이의 높은 값을 보였지만 AI‑AI는 0.05 이하에 불과했다.

이러한 정량적 결과는 LVLM이 ‘공통 기반’ 형성이라는 인간 대화의 핵심 메커니즘을 모델링하지 못한다는 결론을 뒷받침한다. 특히 다중턴 상황에서 발생하는 ‘정확성 유지와 비용 절감 사이의 트레이드오프’를 자동으로 학습하거나 적응하는 능력이 부족하다. 연구는 또한 역할 비대칭(디렉터 vs 매처)에서 성능 차이가 존재함을 보여준다. AI‑인간 조합에서는 매처 역할을 맡은 LVLM이 디렉터의 인간 표현을 어느 정도 해석했지만, 디렉터 역할을 맡은 LVLM은 인간 매처에게 충분히 간결하고 일관된 지시를 제공하지 못했다.

결론적으로, 본 논문은 LVLM이 현재 수준에서는 인간과 협업하기 위한 실시간 ‘그라운딩’ 능력이 제한적이며, 이를 개선하기 위해서는 대화형 프루닝, 지속적 피드백 기반 미세조정, 혹은 명시적 프라그마틱 규칙 삽입과 같은 추가 연구가 필요함을 제시한다. 또한 공개된 356개의 다중턴 대화 데이터셋은 향후 LVLM의 대화형 능력 평가와 강화 학습에 귀중한 벤치마크가 될 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기