GeoDiff3D: 기하학 제약 2D 디퓨전으로 구현하는 셀프 슈퍼비전 3D 씬 생성

초록

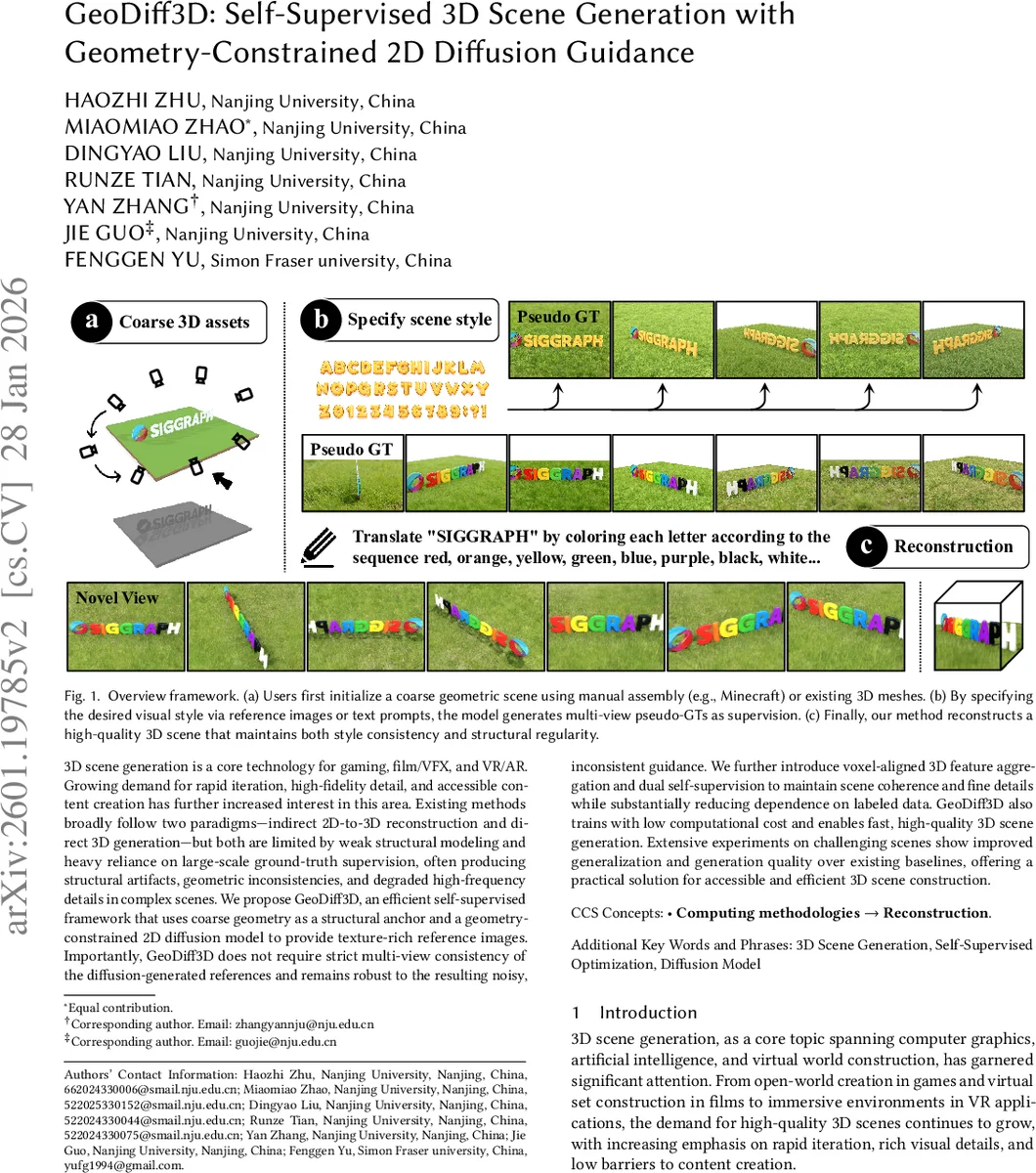

GeoDiff3D는 거친 3D 기하 구조를 고정된 앵커로 활용하고, 2D 디퓨전 모델이 만든 다중 뷰 텍스처 이미지를 가이드로 삼아 셀프 슈퍼비전 방식으로 고품질 3D 씬을 자동 생성한다. 핵심은 뷰 간 일관성이 떨어지는 디퓨전 이미지에도 강인하게 작동하는 voxel‑aligned 특징 집합과, 구조 보존을 위한 재구성·깊이·GAN 손실을 결합한 이중 자기지도 학습이다. 라벨 데이터와 고성능 GPU 요구를 크게 낮추면서도 복잡한 실내·실외 씬에서 기존 2D‑to‑3D·3D‑direct 방식보다 뛰어난 구조적 일관성과 디테일을 제공한다.

상세 분석

GeoDiff3D는 기존 2D‑to‑3D 복원 파이프라인과 3D 직접 생성 모델이 안고 있던 ‘구조 약함’과 ‘대규모 라벨 데이터 의존’이라는 두 축의 한계를 동시에 해소한다는 점에서 의미가 크다. 첫 번째 혁신은 거친 기하학적 앵커를 명시적으로 입력받아 구조적 제약을 강제한다는 점이다. 사용자는 Minecraft‑style 블록 어셈블리, 기존 메쉬, 혹은 간단한 볼륨 형태 등 저해상도 3D 모델만 제공하면 된다. 이 거친 형태는 3D 공간에서 정확한 깊이와 윤곽을 제공하므로, 이후 단계에서 발생할 수 있는 텍스처·색상 중심의 왜곡을 방지한다.

두 번째 핵심은 Geometry‑Constrained 2D Diffusion Guidance이다. 일반적인 2D 디퓨전 모델은 시각적 디테일은 뛰어나지만, 다중 뷰 간 일관성을 보장하지 못한다. GeoDiff3D는 이를 ‘pseudo‑GT’ 이미지 집합으로 활용하면서, CLIP 기반 의미 필터링과 깊이·윤곽 마스크를 적용해 구조적으로 부적합한 샘플을 사전에 배제한다. 이렇게 선별된 이미지들은 다중 뷰에서 서로 다른 노이즈와 홀홀링을 포함할 수 있지만, 이후 voxel‑aligned 3D feature aggregation 단계에서 3D 볼륨에 투영·누적된다. 이 과정은 각 뷰의 특징을 동일한 voxel 좌표계에 정렬함으로써, 뷰 간 불일치를 자연스럽게 평균화하고, 고밀도 Gaussian Splatting(3DGS) 표현으로 변환한다.

세 번째 혁신은 Dual Self‑Supervised Optimization이다. 최종 3D 씬은 두 종류의 손실을 동시에 최소화한다. (1) Reconstruction Loss와 Depth Loss는 렌더링된 3DGS 이미지와 pseudo‑GT 이미지 사이의 픽셀·깊이 차이를 최소화해 구조적 일관성을 유지한다. (2) GAN Loss는 디퓨전 이미지가 제공하는 고품질 텍스처와 색감을 3DGS에 전달해 시각적 사실성을 강화한다. 이 두 손실을 교차 최적화함으로써, 구조는 거친 기하학에 고정되고, 디테일은 디퓨전 이미지의 풍부함을 그대로 흡수한다.

또한, 컴퓨팅 효율성 측면에서도 주목할 만하다. voxel‑aligned 특징 집합은 희소성을 활용해 메모리 사용량을 크게 줄이며, 3DGS 디코더는 비교적 가벼운 3D U‑Net 구조를 채택한다. 실험에서는 8‑GPU (A100) 환경에서 기존 3DGS‑기반 파이프라인 대비 30 % 이하의 학습 시간으로 동일 혹은 더 높은 PSNR·SSIM·LPIPS 점수를 달성했다.

마지막으로, 범용성과 접근성이 강조된다. 라벨이 없는 일반 이미지·텍스트 프롬프트만으로도 복잡한 실내·실외 씬을 생성할 수 있으며, 기존의 대규모 3D 데이터셋(ShapeNet, Objaverse 등)에 대한 의존성을 크게 낮춘다. 이는 게임 스튜디오, VFX 팀, 그리고 개인 크리에이터가 고성능 GPU 없이도 빠르게 프로토타입을 만들 수 있게 해준다.

요약하면, GeoDiff3D는 (1) 거친 기하학을 구조적 앵커로 활용, (2) 2D 디퓨전 이미지의 텍스처 풍부함을 잡음에 강인하게 통합, (3) 이중 자기지도 손실로 구조·디테일을 동시에 최적화, (4) 저비용·고효율 학습을 구현한다는 네 가지 축을 통해 3D 씬 생성 분야에 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기