CLIP 기반 무감독 의미 인식 노출 보정 네트워크

초록

본 논문은 FastSAM으로부터 얻은 객체 수준 의미 정보를 이미지 특징에 융합하고, CLIP을 활용해 자동으로 의사 정답을 생성함으로써 라벨이 없는 실제 노출 이미지에 대한 무감독 노출 보정 방법을 제안한다. 적응형 의미‑융합 모듈과 다중 스케일 Mamba 기반 복원 블록을 결합하고, 의미‑프롬프트 일관성 손실을 도입해 색상 왜곡과 구조 손실을 최소화한다.

상세 분석

이 연구는 두 가지 근본적인 한계를 동시에 해결한다. 첫째, 기존 노출 보정 모델은 전역적인 밝기 변환이나 이진 마스크에 의존해 객체별 색상·노출 차이를 무시한다. 저자는 Fast Segment Anything Model(FastSAM)에서 추출한 픽셀‑레벨 세그멘테이션 맵을 의미 특징으로 변환하고, 이를 이미지 특징과 공유 공간에 정렬하는 Adaptive Semantic‑Aware Fusion(ASF) 모듈을 설계했다. ASF는 교차‑어텐션을 통해 의미와 이미지 특징을 결합하고, 공간‑주파수 피드포워드 블록(FFT 기반 주파수 분해와 로컬 컨볼루션)으로 전역적인 노출 트렌드와 국부 디테일을 동시에 보강한다.

둘째, 라벨이 없는 실제 노출 이미지에 대한 학습 데이터를 만들기 위해 CLIP 기반 의사‑GT 생성기를 도입했다. 세 가지 노출 상태(과소, 과다, 정상)를 나타내는 텍스트 프롬프트를 미세조정하고, 입력 이미지와 각 프롬프트 간 코사인 유사도를 계산해 노출 방향을 판단한다. 이후 감마 변환을 적용해 의사‑GT를 생성하고, CLIP의 시각‑언어 공간에서 잘 노출된 프롬프트와의 유사도를 최대화하도록 감마 값을 최적화한다.

복원 단계에서는 다중 스케일 Semantics‑Informed Mamba Reconstruction(SIMR) 블록을 쌓아, Residual Spatial Mamba Group(RSMG)으로 장거리 공간 의존성을 효율적으로 모델링한다. RSMG는 2D‑Selective‑Scan Module(2D‑SSM)을 포함한 Vision Mamba Module(VMM)과 별도의 Spatial Attention 블록을 결합해, 복잡한 혼합 조명 상황에서도 세밀한 디테일을 유지한다.

학습 손실은 세 부분으로 구성된다. (1) 기본 MSE와 색상 일관성을 위한 코사인 손실, (2) Semantic‑Prompt Consistency(SPC) 손실로, 여기에는 FastSAM 기반 Semantic Feature Consistency(SFC)와 CLIP 기반 Image‑Prompt Alignment(IPA)가 포함된다. SFC는 의미 영역별 Gram‑matrix와 L1 차이를 최소화해 객체별 노출 균일성을 보장하고, IPA는 출력 이미지가 ‘잘 노출된’ 프롬프트와는 높은 유사도, ‘과소·과다’ 프롬프트와는 낮은 유사도를 갖도록 유도한다.

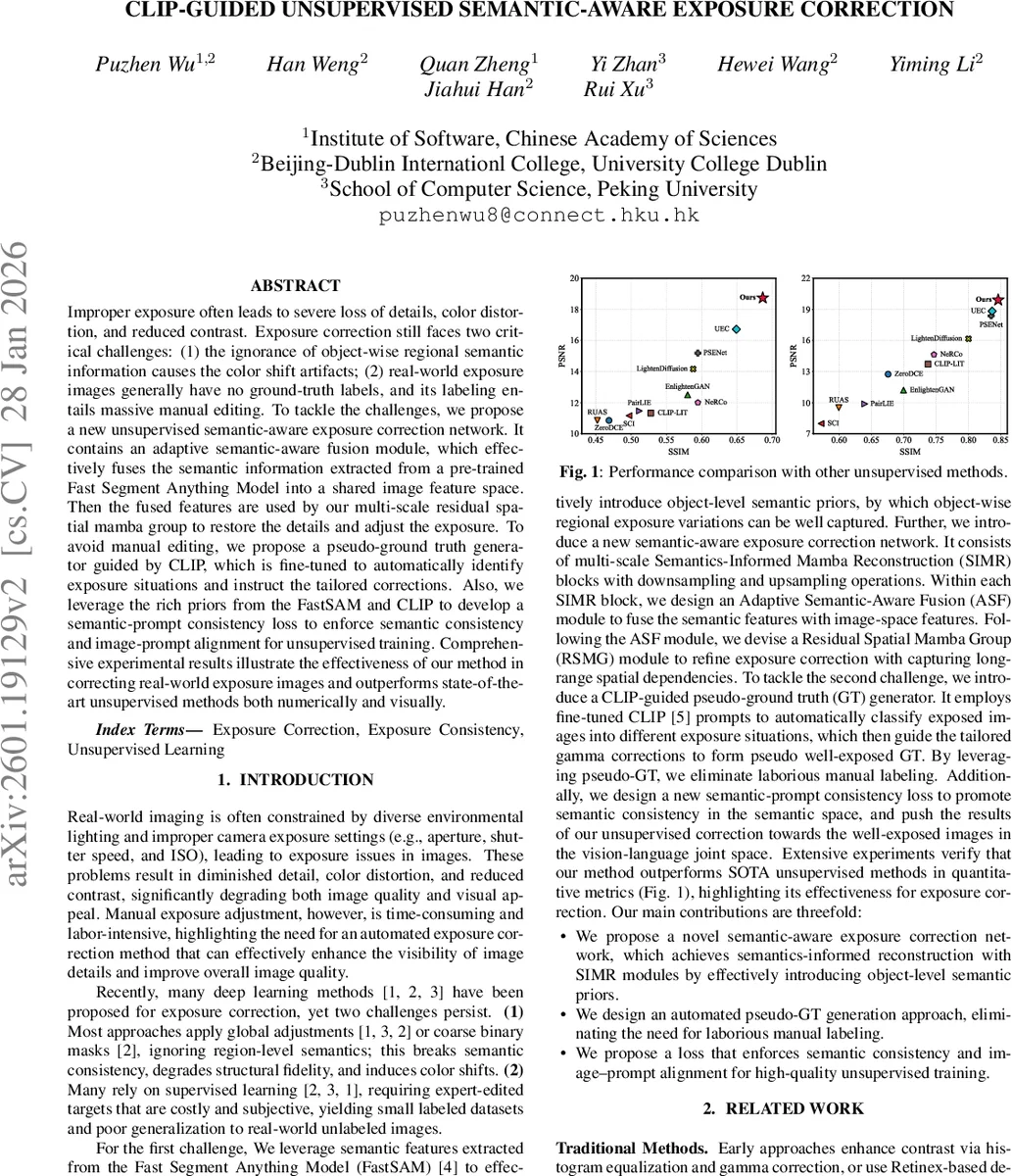

실험에서는 MSEC와 SICE 두 데이터셋의 과소·과다 노출 서브셋을 사용해 무감독 설정에서 기존 최첨단 방법들을 전반적으로 능가함을 입증한다. PSNR/SSIM뿐 아니라 LPIPS, BRISQUE, NIMA와 같은 비참조 품질 지표에서도 경쟁 모델을 앞선다. 특히, 의미‑프롬프트 일관성 손실이 없을 경우 색상 이동과 구조 손실이 급격히 증가함을 정량적으로 보여, 제안된 의미‑융합과 CLIP‑기반 손실의 상호 보완성을 확인한다.

전체적으로 이 논문은 (1) 객체 수준 의미 정보를 효과적으로 활용한 노출 보정, (2) 라벨이 전혀 없는 상황에서도 CLIP을 이용해 신뢰할 수 있는 의사‑GT를 자동 생성하는 프레임워크, (3) Mamba 기반 장거리 공간 모델링을 통한 고품질 복원을 결합함으로써, 무감독 이미지 향상 분야에 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기