희소성 인식 저랭크 적응으로 대형 언어 모델 효율적 파인튜닝

초록

**

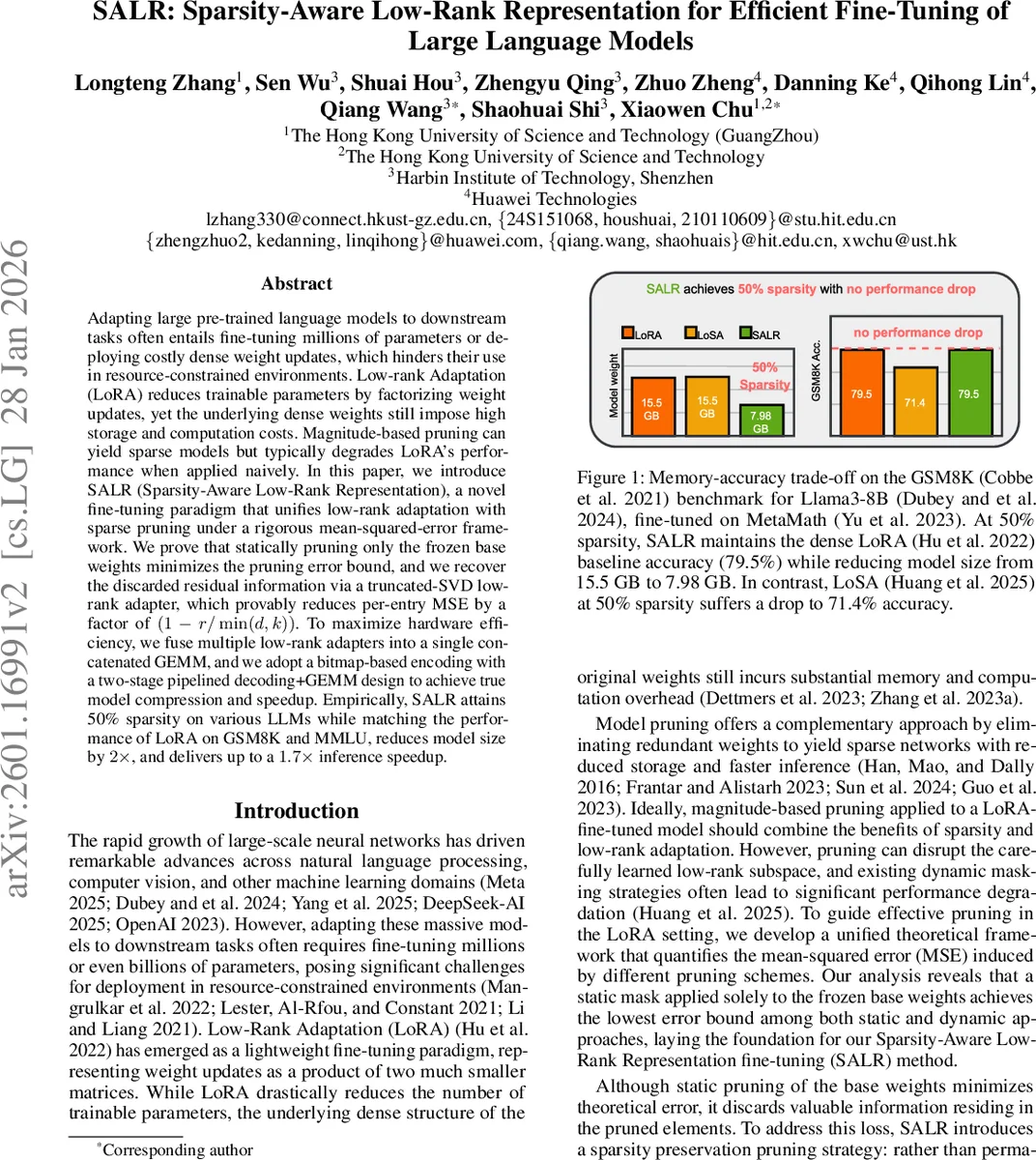

SALR은 고정된 베이스 가중치를 정적 마스크로 50% 희소화하고, 잘라낸 잔차를 저랭크 어댑터로 복원한다. bitmap 인코딩과 어댑터 병합 GEMM을 통해 모델 크기를 2배 줄이고, 추론 속도를 최대 1.7배 높이면서 LoRA와 동등한 정확도를 유지한다.

**

상세 분석

**

본 논문은 대규모 사전학습 언어 모델(LLM)의 파인튜닝 비용을 두 축, 즉 파라미터 저장량과 연산량으로 나누어 분석한다. 기존 LoRA는 가중치 업데이트를 저랭크 행렬 두 개(A·B)로 근사해 학습 가능한 파라미터 수를 크게 감소시키지만, 원본 가중치 W₀ 자체는 여전히 밀집 형태이기 때문에 메모리와 연산 측면에서 병목이 된다. 반면 전통적인 magnitude‑based pruning은 W₀을 희소화해 메모리와 FLOPs를 절감하지만, LoRA와 결합했을 때 저랭크 서브스페이스가 손상돼 성능이 급격히 떨어지는 문제가 있다.

SALR은 이 두 접근법의 장점을 수학적으로 정량화한다. 먼저 가중치 행렬을 정규분포(𝒩(0,σ²))로 가정하고, 희소화 비율 p에 대한 임계값 Tₚ를 구해 평균제곱오차(MSE)를 정확히 도출한다(정리 1). 이어서 LoRA 구조 W = W₀ + A·B를 고려한 세 가지 프루닝 전략을 제시한다. 정적 마스크를 W₀에만 적용하는 방법(방법 1)이 동적 마스크를 포함하거나 전체 행렬 U에 적용하는 방법(방법 2·3)보다 MSE가 항상 작음이 정리 2에서 증명된다. 이는 프루닝 과정에서 저랭크 적응 파라미터를 방해하지 않으면서도, 베이스 가중치만을 선택적으로 희소화하면 손실을 최소화할 수 있음을 의미한다.

하지만 정적 프루닝은 단순히 0으로 만든 엔트리를 완전히 버리므로, 중요한 잔차 정보가 사라진다. 이를 보완하기 위해 SALR은 프루닝된 엔트리들의 잔차 행렬 E = W – Ŵ를 추출하고, truncated SVD를 통해 rank‑r 저랭크 근사 Eᵣ을 만든다. 정리 3에 따르면, Eᵣ을 추가함으로써 전체 MSE는 (1 – r/ min(d,k)) 배만큼 감소한다. 즉, 희소화 비율이 높아도 적절한 r을 선택하면 손실을 거의 회복할 수 있다.

실제 구현 단계에서는 여러 저랭크 어댑터(A·B, Eᵣ)들을 하나의 큰 행렬 A_cat, B_cat으로 연결(concatenation)한다. 이렇게 하면 입력 벡터 x에 대해 작은 GEMM을 여러 번 호출하는 대신, 하나의 대형 GEMM으로 일괄 처리해 커널 런치 오버헤드를 크게 줄이고, GPU/TPU와 같은 하드웨어의 메모리 대역폭과 연산 유닛을 최대로 활용한다.

또한 모델 압축을 위해 bitmap 기반 인코딩을 도입한다. 프루닝된 W₀는 비트맵 마스크와 남은 dense 엔트리만 저장되며, 디코딩 단계는 두 단계 파이프라인으로 설계된다. 첫 단계에서는 바이트‑레벨 마스크와 룩업 테이블을 이용해 희소 서브매트릭스를 재구성하고, 동시에 LoRA 어댑터 연산을 진행한다. 두 번째 단계에서는 재구성된 서브매트릭스를 고성능 GEMM에 투입한다. 이 설계는 디코딩 비용을 연산 단계와 겹치게 함으로써 전체 추론 파이프라인이 compute‑bound 상태를 유지하도록 만든다.

실험에서는 Llama‑3‑8B, Llama‑2‑13B 등 다양한 LLM에 50% 희소화를 적용했으며, GSM8K와 MMLU 벤치마크에서 LoRA와 동일한 정확도를 달성했다. 모델 파일 크기는 15.5 GB에서 7.9 GB로 절반 수준으로 감소했고, 실제 추론 속도는 1.7배 가속되었다. 비교 대상인 LoSA와 SparseLoRA는 각각 정확도 저하 혹은 실제 압축·가속 효과 부재라는 한계를 보였다.

요약하면, SALR은 (1) 정적 베이스 가중치 프루닝이 MSE를 최소화한다는 이론적 근거, (2) 프루닝 잔차를 저랭크 SVD 어댑터로 복원해 손실을 보정한다는 수학적 증명, (3) 어댑터 병합 GEMM과 bitmap‑based 디코딩 파이프라인을 통해 실제 하드웨어 효율성을 극대화한다는 실용적 설계를 결합한다. 이 세 축이 유기적으로 작동함으로써 대형 언어 모델을 메모리·연산·배포 측면에서 모두 최적화한다는 점이 본 연구의 핵심 기여이다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기