아프리카 언어 식별을 위한 통합 프레임워크 AfroScope

초록

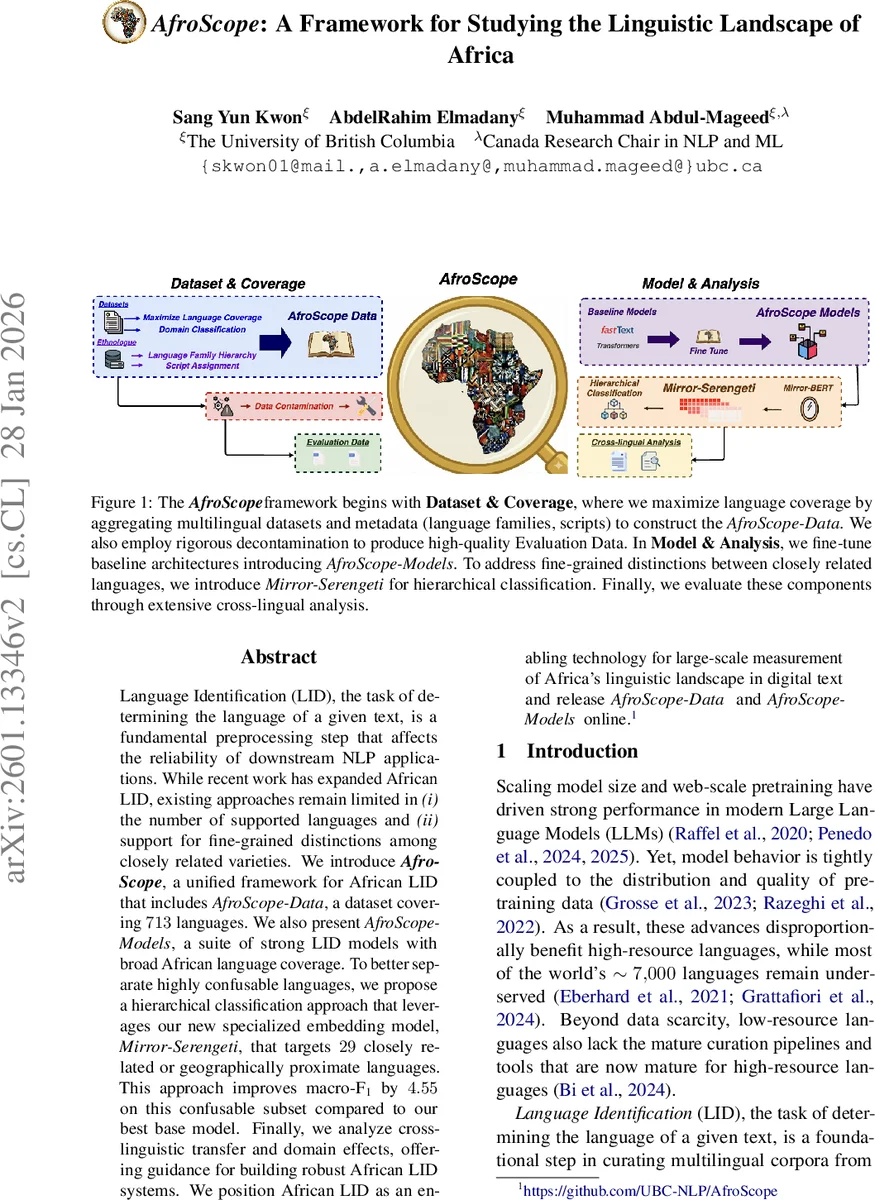

AfroScope는 713개 아프리카 언어를 포괄하는 대규모 데이터셋(AfroScope‑Data)과, 이를 기반으로 학습된 강력한 LID 모델군(AfroScope‑Models)을 제시한다. 특히 29개의 혼동이 잦은 언어군을 대상으로 설계한 계층형 임베딩 모델 Mirror‑Serengeti를 활용해 기존 최고 모델 대비 매크로 F1 점수를 4.55% 향상시켰다. 논문은 언어 자원 수준, 도메인, 스크립트별 성능 분석과 교차 언어 전이 효과를 조사해 실용적인 구축 가이드를 제공한다.

상세 분석

본 논문은 아프리카 언어 식별(LID) 분야에서 두 가지 핵심 한계를 동시에 해결하려는 시도로 평가된다. 첫 번째는 언어 커버리지 문제다. 기존 LID 시스템은 수백 개 수준에 머물러 ‘형제 언어’ 오류, 즉 지원되지 않은 언어가 가장 가까운 지원 언어로 오분류되는 현상이 빈번했다. AfroScope‑Data는 11개의 공개 데이터 소스를 통합해 713개 언어, 9개 언어 가족, 7개 스크립트, 9개 도메인에 걸쳐 19,682,636개의 고유 문장을 제공함으로써 현재 공개된 아프리카 LID 데이터 중 가장 넓은 범위를 달성한다. 데이터 정제 과정에서 4‑gram 중복 검사를 통해 훈련‑평가 간 오염을 최소화했으며, 각 언어당 최대 100 K 문장(훈련)과 100문장(평가)으로 균형을 맞추어 고자원 언어가 모델을 압도하지 않도록 설계했다.

두 번째는 미세 구분 능력이다. 아프리카 내 많은 언어는 유전적·지리적 근접성으로 표면 형태가 매우 유사해 기존 단일 레이블 분류기로는 구분이 어려웠다. 이를 해결하기 위해 저자들은 계층형 분류 구조를 도입하고, 29개의 고혼동 언어군을 대상으로 사전 학습된 대조 임베딩 모델 Mirror‑Serengeti를 구축했다. 이 모델은 언어 간 미세 차이를 강조하도록 설계된 contrastive loss와 특화된 토크나이저를 사용해, 상위 레벨에서 대분류(언어 가족) 예측 후 하위 레벨에서 세부 언어를 판별한다. 실험 결과, 이 계층형 접근법은 해당 29개 언어군에서 매크로 F1를 4.55% 상승시켰으며, 특히 저자원 언어에서의 성능 격차를 크게 줄였다.

성능 평가에서는 FastText 기반 경량 모델(ConLID)부터 XLM‑R 기반 AfroLID, Serengeti, T5 기반 Cheetah까지 다양한 베이스라인을 비교했다. 전체 713개 언어에 대한 매크로 F1는 AfroScope‑Models 중 가장 높은 97.2%를 기록했으며, 데이터 양에 따른 성능 곡선을 분석해 약 980문장 이상이면 평균 95% 이상의 정확도를 달성한다는 ‘인플렉션 포인트’를 제시했다. 도메인별 분석에서는 종교·뉴스 텍스트가 가장 높은 정확도를 보인 반면, 웹·헬스 등 다변화된 도메인에서는 성능 편차가 커짐을 확인했다. 이는 도메인 편향이 LID 모델의 일반화에 큰 영향을 미친다는 점을 시사한다.

또한 교차 언어 전이 효과를 정량화했다. 언어 가족 간 전이에서는 동일 가족 내 스크립트가 겹치는 경우 긍정적 전이가 두드러졌으며, 서로 다른 스크립트를 사용하는 경우 부정적 간섭이 관찰되었다. 이러한 분석을 통해 저자들은 데이터 수집 시 가족·스크립트 다양성을 확보하고, 전이 손실을 최소화하기 위한 멀티‑스크립트 학습 전략을 제안한다.

전체적으로 AfroScope는 (1) 광범위한 언어·스크립트·도메인 커버리지, (2) 계층형·대조 임베딩 기반의 미세 구분 메커니즘, (3) 체계적인 전이·도메인 분석이라는 세 축을 통해 아프리카 LID 연구의 현재 한계를 뛰어넘는 종합 솔루션을 제공한다. 데이터와 모델을 공개함으로써 향후 대규모 다언어 NLP 파이프라인 구축에 필수적인 기반을 마련했으며, 특히 저자원 언어의 디지털 가시성을 높이는 데 기여할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기