루브릭허브: 자동화된 거친‑세밀 생성으로 만든 고차별 루브릭 데이터셋

초록

**

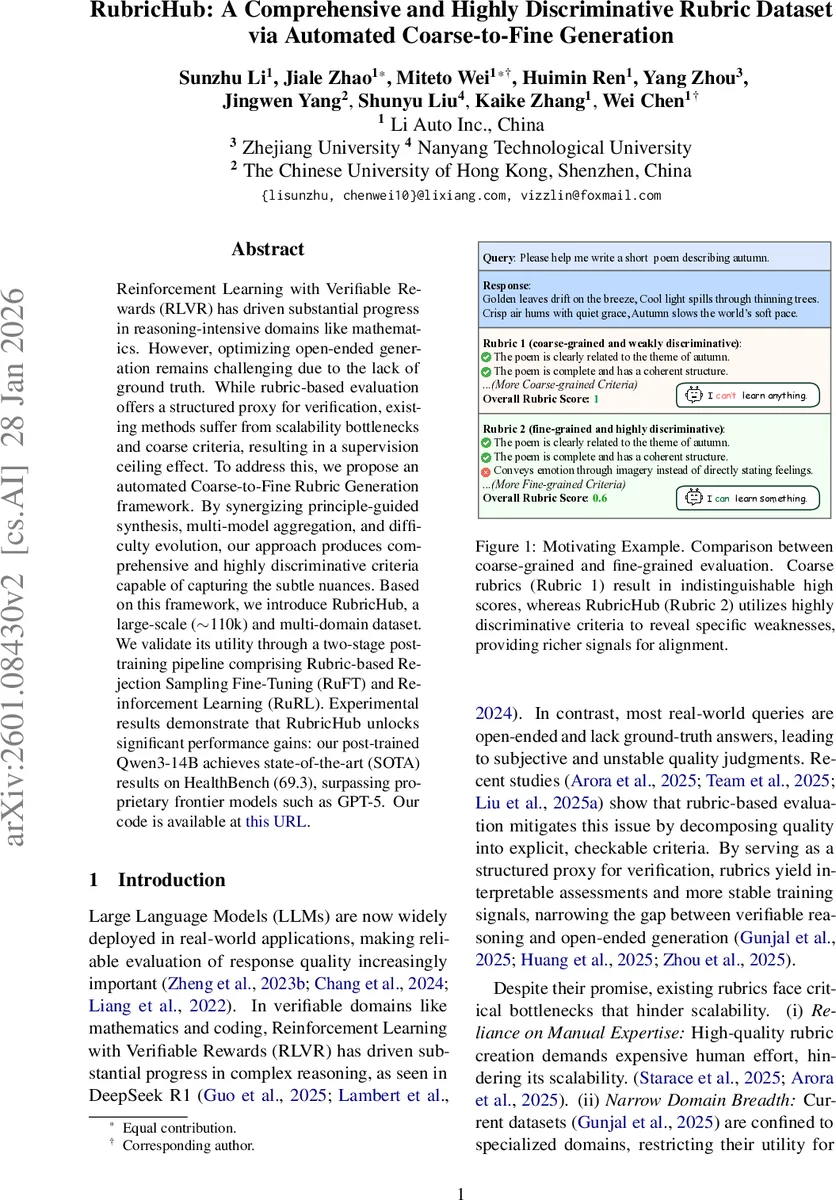

본 논문은 원시 질의‑응답 쌍에 대해 원칙‑가이드와 응답‑그라운딩을 결합하고, 다중 모델 집계와 난이도 진화를 통해 거친 기준에서 세밀하고 차별화된 루브릭을 자동 생성한다. 110 k 규모의 다도메인 데이터셋 ‘RubricHub’를 구축하고, 이를 활용한 루브릭 기반 재샘플링 파인튜닝(RuFT)과 강화학습(RuRL) 파이프라인을 제시한다. Qwen‑3‑14B를 사후 학습시켜 HealthBench에서 69.3점으로 GPT‑5(67.2점)를 앞선 SOTA 성능을 달성하였다.

**

상세 분석

**

이 연구는 기존 루브릭 기반 평가가 “수작업 의존·도메인 편중·평가 세분화 부족”이라는 세 가지 병목을 정확히 짚고, 이를 해결하기 위한 Coarse‑to‑Fine Rubric Generation 프레임워크를 제안한다. 첫 단계에서는 질의와 모델이 생성한 대표 답변을 입력으로, Principle‑Guided(일관성·구조·명료성·추론 가능성)와 Response‑Grounded(답변에 기반한 구체성) 프롬프트를 사용해 초기 기준을 만든다. 이때 답변을 함께 제공함으로써 “루브릭 드리프트”를 방지하고, 기준이 실제 출력과 직접 연결되도록 설계한다.

두 번째 단계인 Multi‑Model Aggregation은 서로 다른 최첨단 LLM(GPT‑5.1, Gemini 3 Pro 등)으로부터 동일 질의에 대한 후보 루브릭을 다수 생성한 뒤, 집계 프롬프트를 통해 중복을 제거하고 충돌을 조정한다. 이렇게 하면 단일 모델의 편향이 평균화되어 보다 포괄적이고 객관적인 기준 집합을 얻을 수 있다.

세 번째 단계인 Difficulty Evolution은 기본 루브릭이 포괄성은 확보했지만 차별력이 부족하다는 점을 보완한다. 고품질 답변 두 개를 선정하고, 이를 분석해 “우수→탁월” 수준을 구분하는 미세 기준을 추가한다. 예를 들어 “코드가 O(n) 복잡도를 유지하는가”와 같은 구체적 검증 항목을 삽입함으로써, 상위 모델이 점수 포화에 빠지지 않도록 설계한다.

데이터 구축 측면에서 5개 도메인(Science, Medical, Writing, Chat, Instruction‑Following)에서 약 110 k 질의‑루브릭 쌍을 수집·정제했으며, 각 도메인별 평균 기준 수는 25~32개 수준으로, 기존 데이터셋에 비해 규모·다양성·세분성이 크게 향상되었다.

실험에서는 제안된 루브릭을 활용한 두 단계 사후 학습 파이프라인을 적용했다. RuFT는 루브릭 점수를 기준으로 고품질 응답을 선별해 파인튜닝 데이터로 재구성하고, RuRL은 루브릭 점수를 보상 신호로 사용해 정책 최적화를 수행한다. 결과적으로 Qwen‑3‑14B‑Base를 사후 학습한 모델이 HealthBench에서 69.3점을 기록했으며, 이는 동일 규모의 공개 모델을 넘어 GPT‑5(67.2점)를 앞선다.

비판적으로 보면, 자동 루브릭 생성 과정에 사용된 프롬프트와 메타‑원칙이 충분히 일반화 가능한지, 그리고 다른 언어·문화권에 적용할 때 발생할 수 있는 편향 문제는 충분히 논의되지 않았다. 또한, 루브릭 점수를 보상으로 사용할 때 “루브릭 최적화”가 실제 사용자 만족도와 일치하는지 검증하기 위한 인간 평가가 제한적이었다. 재현성 측면에서는 사용된 다중 모델(특히 GPT‑5.1 등 비공개 모델)의 상세 설정이 공개되지 않아, 동일 파이프라인을 완전 복제하기 어려울 수 있다. 마지막으로, 대규모 자동 생성 루브릭이 악용될 경우, 모델이 루브릭에 과도하게 맞춰져 창의적·다양한 표현을 억제할 위험도 존재한다.

전반적으로, 자동화된 거친‑세밀 루브릭 생성이라는 아이디어와 RubricHub 데이터셋은 LLM 정렬 연구에 새로운 감독 신호를 제공하며, 특히 검증 가능한 보상이 어려운 개방형 생성 태스크에 실용적인 해결책을 제시한다. 향후 인간‑루브릭 비교, 다언어 확장, 그리고 윤리적 가이드라인 수립이 뒤따른다면 더욱 강력한 정렬 프레임워크가 될 것으로 기대된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기