FastDINOv2 – 주파수 기반 커리큘럼으로 빠르고 강인한 비전 모델 만들기

초록

**

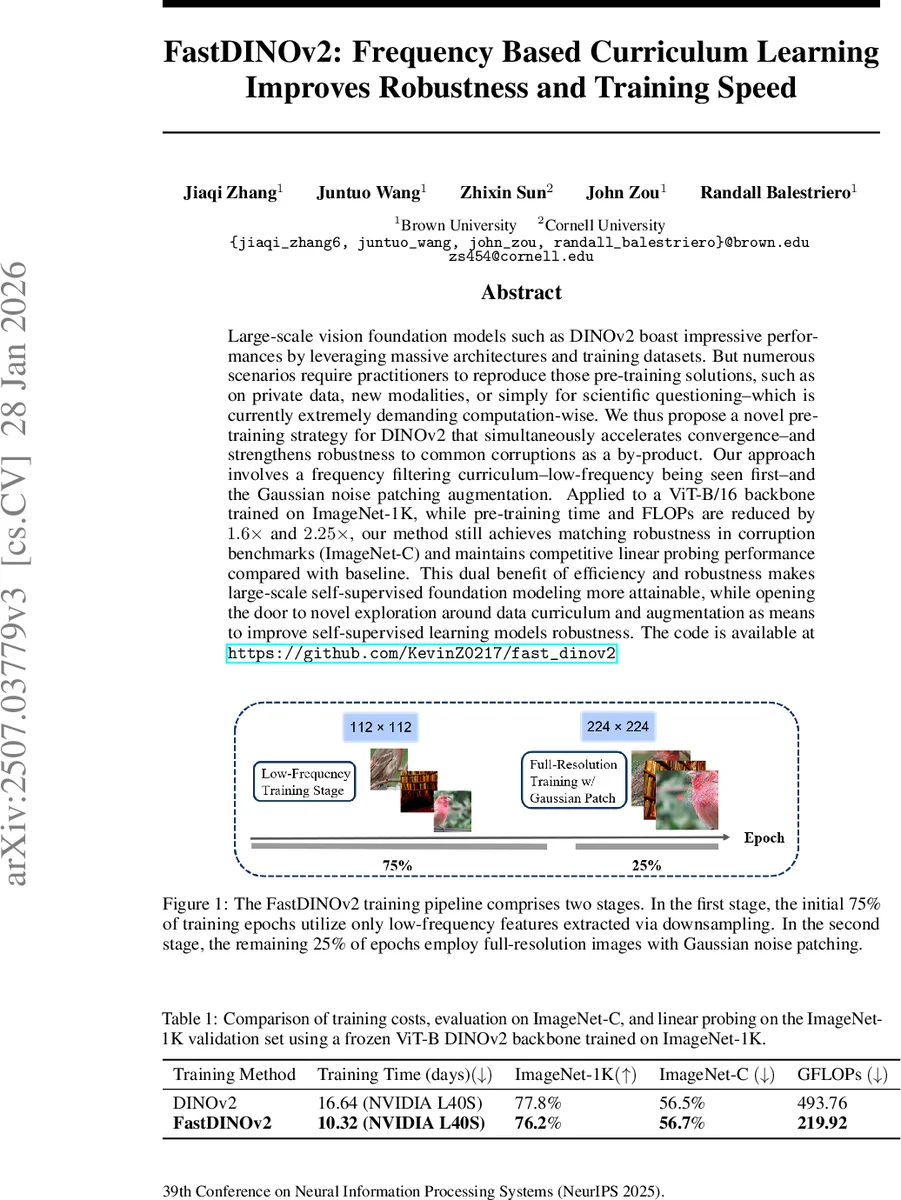

FastDINOv2는 이미지의 저주파 성분만을 이용해 초기 75 % 학습을 진행하고, 이후 전체 해상도와 Gaussian noise patching을 적용하는 두 단계 커리큘럼을 제안한다. 이 방식은 ViT‑B/16 기반 DINOv2를 ImageNet‑1K에서 1.6배 빠르게 수렴시키고 FLOPs를 2.25배 절감하면서, ImageNet‑C에서 기존 DINOv2와 동등한 강인성을 유지한다.

**

상세 분석

**

본 논문은 대규모 자기지도 학습 모델의 학습 비용과 강인성 사이의 트레이드오프를 주파수 관점에서 재조명한다. 첫 번째 단계에서는 이미지 전체를 다운샘플링해 저주파 성분만 남기고, 토큰 수를 크게 줄여 연산량을 감소시킨다. 이는 Vision Transformer가 자체적으로 저주파 필터 역할을 수행한다는 기존 연구와 일치하며, 모델이 큰 구조적 패턴을 빠르게 학습하도록 유도한다. 두 번째 단계에서는 원본 해상도로 복귀하면서 Gaussian noise patching을 적용한다. 이 augmentation은 고주파 잡음을 국소적으로 삽입해 모델이 고주파 변동에도 견디도록 강제한다. 저주파‑고주파 두 축을 모두 학습함으로써, 저주파 중심의 데이터 커리큘럼이 초래할 수 있는 고주파 편향을 보완하고, 전반적인 주파수 스펙트럼에 걸친 강인성을 확보한다. 실험 결과, 75 % → 25 % 비율의 스케줄링이 가장 효율적이며, 첫 단계 해상도를 112×112로 설정했을 때 토큰 수가 75 % 감소하면서도 선형 프로빙 정확도는 0.2 % 이하로 감소하지 않는다. 반면 64×64와 같은 과도한 저해상도는 정보 손실로 정확도 저하를 초래한다. 또한, Gaussian noise patching은 ImageNet‑C의 저주파(밝기·대비)와 고주파(노이즈·블러) 모두에 대해 기존 DINOv2와 동등하거나 약간 상회하는 mCE를 기록한다. FLOPs 절감은 다운샘플링 단계에서 토큰 수 감소와 학습 epoch 수 단축(250 → 200)으로 인한 직접적인 효과이며, 전체 학습 시간은 1.6배 가량 단축된다. 한계점으로는 현재 ViT‑B/16에만 적용했으며, 대규모 데이터(LVD‑142M, LAION‑5B)에서의 확장성 및 중간 주파수(모션 블러 등) 강인성에 대한 정량적 분석이 부족하다는 점을 들 수 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기