데이터 효율적인 멀티모달 비디오 LLM을 위한 시간 인식 오케스트레이터 DaMO

초록

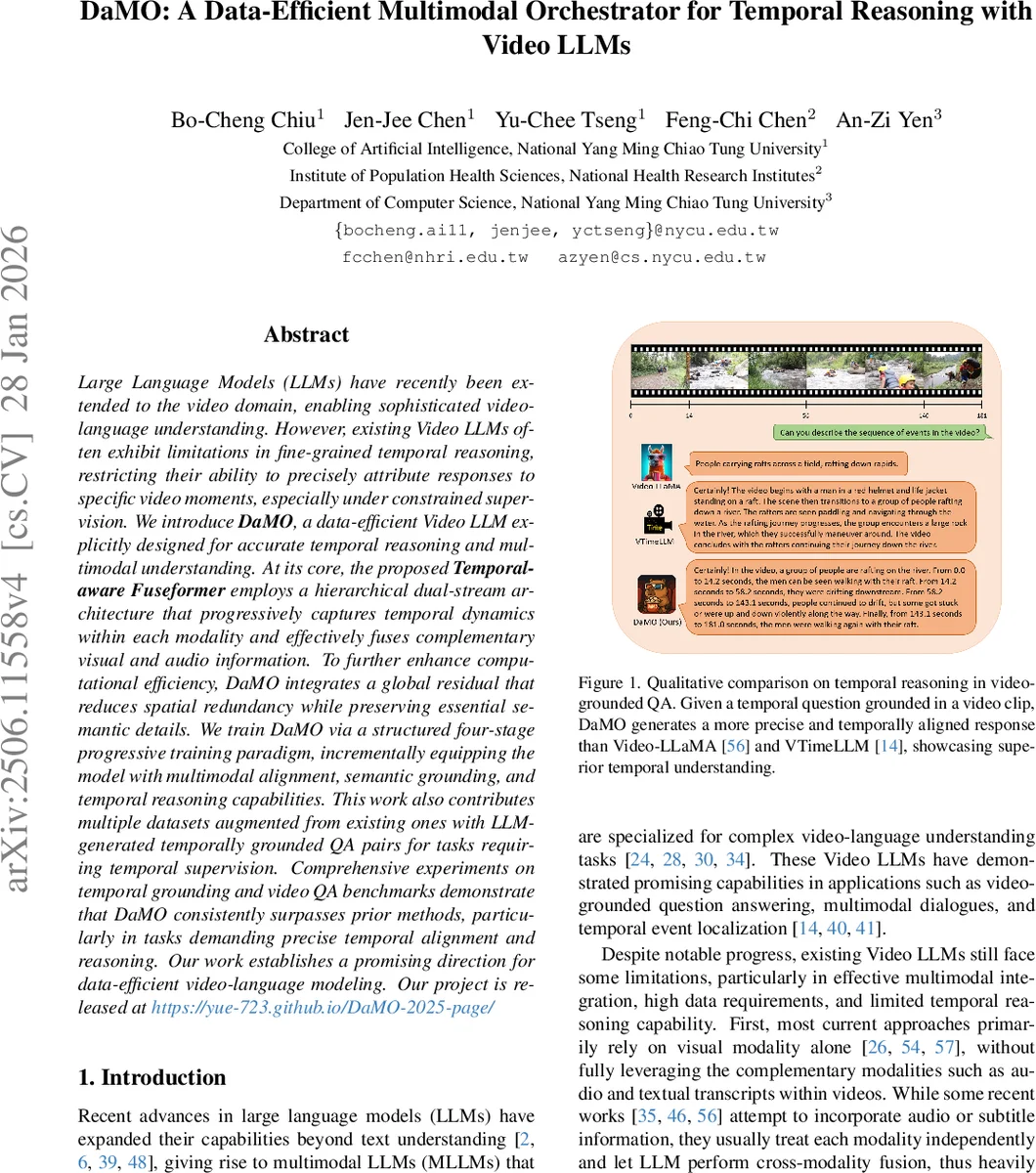

DaMO는 시각·청각 정보를 계층적 이중 스트림으로 처리하고, 전역 잔차와 시간 임베딩을 결합한 Temporal‑aware Fuseformer를 도입해 제한된 데이터에서도 정밀한 시간 추론을 가능하게 하는 데이터‑효율적인 비디오 LLM이다. 네 단계의 점진적 학습과 LLM‑생성 시간 QA 데이터셋을 활용해 기존 모델보다 시간 정렬·질문응답 성능이 크게 향상된다.

상세 분석

본 논문은 비디오 LLM이 직면한 세 가지 핵심 한계—멀티모달 통합 부족, 대규모 데이터 의존, 그리고 시간 정보 손실—를 동시에 해결하고자 한다. 이를 위해 제안된 DaMO는 크게 네 가지 기술적 기여를 제공한다. 첫째, Temporal‑aware Fuseformer(T‑Fuseformer)라는 이중 스트림 트랜스포머 구조를 설계하였다. 시각과 청각 각각에 대해 독립적인 시간‑인식 Unimodal Attention을 수행한 뒤, 소수의 학습 가능한 쿼리를 이용해 Cross‑Attention으로 토큰을 압축한다. 이후 Fusion Query를 통해 두 모달리티를 다중 스케일에서 통합함으로써, 시간적 연속성과 상호 보완적 오디오‑비주얼 신호를 동시에 보존한다. 둘째, 전통적인 풀링이 전역 컨텍스트를 파괴하는 문제를 해결하기 위해 Global Residual 방식을 도입하였다. 각 프레임·오디오 토큰을 로컬(AdaptiveAvgPool)과 글로벌(클래스 토큰 또는 평균 풀링)로 분리하고, 글로벌 부분을 경량 FFN으로 정제한 뒤 잔차 합산을 수행한다. 이 과정은 공간 차원을 크게 축소하면서도 전체 장면의 의미적 흐름을 유지한다. 셋째, 시간 임베딩을 위치 임베딩과 정현파 임베딩의 혼합 형태로 설계해, 모델이 고정된 순서뿐 아니라 유연한 시간 관계도 학습하도록 돕는다. 넷째, 네 단계의 Progressive Training Paradigm을 제시한다. (1) Video‑Text Alignment 단계에서 시각·청각 융합 특징을 텍스트와 정렬해 기본적인 크로스‑모달 기반을 마련하고, (2) Representation Bridging 단계에서 Q‑Former와 LoRA를 이용해 LLM‑호환 임베딩 공간으로 매핑한다. (3) Temporal Perception Learning 단계에서는 LLM‑생성 시간 QA 데이터와 함께 이벤트 경계 및 순서 관계를 명시적으로 학습시켜 시간 인식 능력을 강화한다. (4) Dialogue Tuning 단계에서는 다중 턴 대화 데이터를 통해 시간‑조건 질문에 대한 대화형 추론 능력을 최적화한다. 또한, 기존 영상‑언어 데이터셋에 LLM‑프롬프트를 이용해 시간‑그라운드 QA 페어를 자동 생성함으로써, 대규모 라벨링 없이도 시간 감독을 제공한다. 실험에서는 TVQA‑Temporal, Ego4D‑Temporal Grounding, 그리고 AVSD‑Temporal 등 다양한 벤치마크에서 기존 Video‑LLaMA, VTimeLLM 등을 크게 앞선 성능을 기록하였다. 특히, 제한된 학습 샘플(전체 데이터의 10% 이하)에서도 시간 정밀도와 답변 일관성이 유지되는 점은 데이터 효율성 측면에서 큰 의미를 가진다. 전체적으로 DaMO는 공간‑시간‑멀티모달 삼중 축을 동시에 최적화함으로써, 비디오 LLM이 실제 응용(예: 교육, 감시, 멀티미디어 검색)에서 요구하는 정밀한 시간 추론을 실현할 수 있는 실용적 토대를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기