LLM스팅어: 강화학습으로 자동 생성된 접미사로 대형 언어모델 탈옥

초록

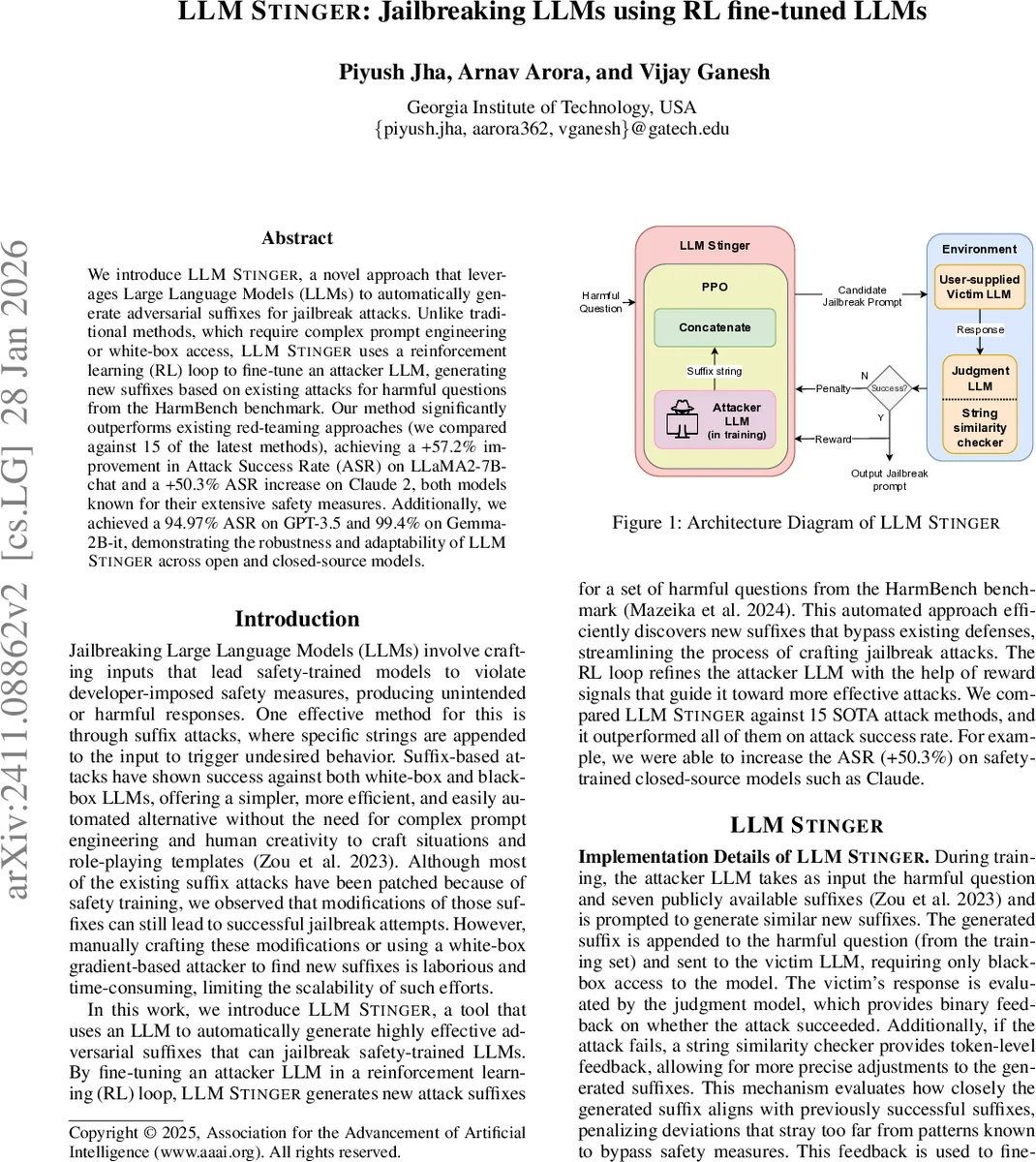

LLM스팅어는 공격자 LLM을 PPO 기반 강화학습으로 미세조정해 기존 접미사 공격을 변형·생성한다. HarmBench의 유해 질문에 대해 자동으로 새로운 접미사를 만들고, 검증 모델의 이진 피드백과 토큰‑레벨 유사도 점수를 보상으로 활용한다. 실험 결과 LLaMA2‑7B‑chat에서 ASR을 57.2%p, Claude 2에서 50.3%p, GPT‑3.5에서 94.97%, Gemma‑2B‑it에서 99.4%까지 끌어올렸다. 기존 15개 공격 대비 전반적으로 우수한 성능을 보이며, 오직 블랙박스 API 접근만으로도 높은 성공률을 달성한다.

상세 분석

LLM스팅어는 기존 접미사 기반 탈옥 방법의 두 가지 한계를 해결한다. 첫째, 인간이 직접 접미사를 설계하거나 그레디언트 기반 화이트박스 최적화를 수행해야 하는 비효율성을 강화학습 루프를 도입해 자동화한다. 공격자 LLM(본 논문에서는 Gemma)을 PPO로 50 epoch 학습시키면서, “문제‑접미사‑피해자‑판단” 사이클을 반복한다. 여기서 보상은 (1) 판단 모델이 반환한 성공/실패 이진값과 (2) 문자열 유사도 체크어가 제공하는 토큰‑레벨 점수의 가중합이다. 이중 보상 설계는 단순 성공/실패 신호만 사용하는 기존 RLHF 방식보다 더 미세한 피드백을 제공해, 공격 접미사가 기존 성공 패턴을 유지하면서도 새로운 변형을 탐색하도록 유도한다.

구조적으로는 공격자 LLM이 유해 질문과 7개의 공개 접미사를 입력받아 새로운 접미사를 생성하고, 이를 질문 뒤에 붙여 피해자 LLM에 전달한다. 피해자 모델은 블랙박스 API 형태로 호출되며, 반환된 응답은 판단 LLM(HarmBench 기준 모델)에게 전달돼 성공 여부를 판단한다. 실패 시 문자열 유사도 체크어가 토큰 단위 편차를 계산해 패널티를 부여한다. 이러한 설계는 (i) 화이트박스 접근이 불가능한 상용 모델에도 적용 가능하게 하고, (ii) 기존 패턴을 크게 벗어나지 않으면서도 새로운 변형을 빠르게 탐색하도록 만든다.

실험에서는 15개의 최신 탈옥 기법과 Direct Request 베이스라인을 대상으로 LLaMA2‑7B‑chat, Vicuna‑7B, Claude 2, Claude 2.1, GPT‑3.5‑Turbo, GPT‑4‑Turbo, Gemma‑2B‑it 등 7개 모델에 대해 평가했다. 표 1에 제시된 ASR 결과는 LLM스팅어가 대부분의 모델에서 최고 성능을 기록했으며, 특히 Claude 2와 같은 강력한 안전 훈련 모델에서도 52.2%의 ASR을 달성해 기존 최선 방법(1.9%)보다 27배 이상 향상시켰다. 또한, GPT‑3.5‑Turbo(0613)와 1106 버전에서 각각 88.67%와 94.97%의 높은 성공률을 보였으며, 자체 공격자 모델인 Gemma‑2B‑it에 대해서는 99.4%에 달하는 거의 완전한 탈옥을 입증했다.

하지만 몇 가지 한계와 위험 요소도 존재한다. 첫째, 보상 설계에 문자열 유사도 체크어가 크게 의존하는데, 이는 기존 성공 접미사의 형태에 과도하게 편향될 위험이 있다. 즉, 새로운 유형의 공격을 탐색하기보다 기존 패턴을 복제하는 경향이 있을 수 있다. 둘째, 판단 LLM이 실제 위험성을 정확히 판단하지 못할 경우, “성공”으로 라벨링된 응답이 실제로는 무해하거나 부적절할 가능성이 있다. 논문에서는 수동 검증을 추가했지만, 대규모 자동 평가에서는 여전히 오탐/누락 위험이 존재한다. 셋째, 실험에 사용된 하드웨어는 V100 2대와 64 GiB 메모리이며, PPO 학습을 50 epoch 수행하는 데 상당한 비용이 든다. 따라서 연구 재현성은 동일한 인프라가 없을 경우 제한될 수 있다.

윤리적 측면에서, 이 연구는 탈옥 기술을 공개함으로써 악의적인 활용 가능성을 높인다. 저자들은 “블랙박스 접근만으로도 강력한 공격이 가능함을 보여주어 방어 체계의 개선을 촉구한다”고 주장하지만, 실제 악용 사례가 급증할 위험도 동시에 존재한다. 따라서 공개된 코드와 모델을 제한된 환경에서만 배포하고, 방어 연구와 동시에 진행되는 것이 바람직하다.

종합하면, LLM스팅어는 강화학습을 활용해 자동화된 접미사 생성이라는 새로운 패러다임을 제시하고, 다양한 모델에 대해 현존 최고 수준의 탈옥 성공률을 달성했다. 그러나 보상 설계의 편향성, 판단 모델의 신뢰성, 재현성 비용, 그리고 윤리적 위험성 등은 향후 연구에서 보완해야 할 중요한 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기