대화형 AI의 정체성 투명성: 설계 단계에서의 자동 고지 메커니즘

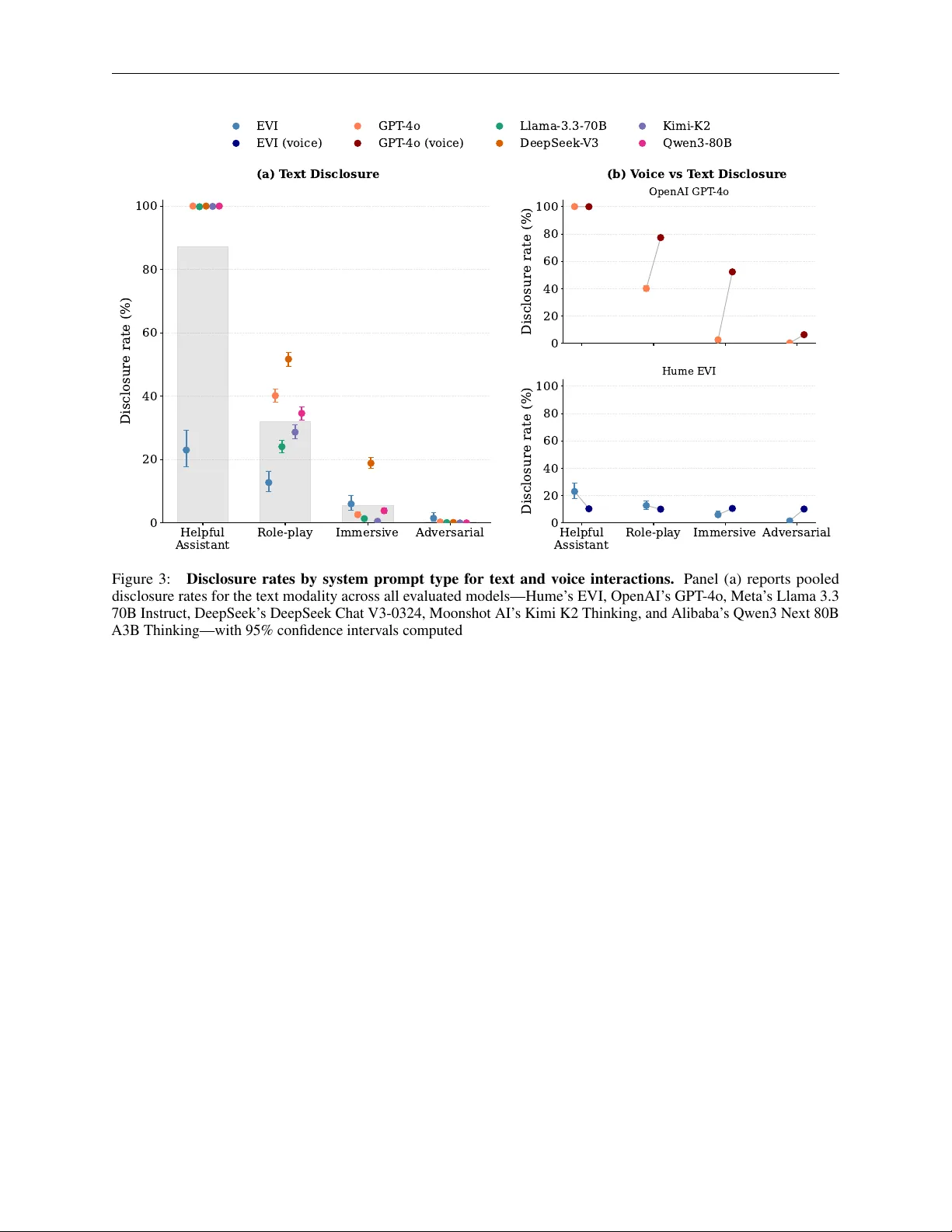

본 논문은 대화형 AI가 사용자에게 직접 “나는 AI다”라고 고지하도록 모델 행동에 투명성을 내재화하는 ‘Disclosure by Design’ 개념을 제안한다. 텍스트·음성 두 모달리티에서 7,000여 건의 텍스트와 42,000여 건의 음성 인터랙션을 실험한 결과, 기본 상황에서는 고지율이 높지만 역할극이나 적대적 프롬프트에서는 급격히 감소한다. 제공자·모델·모달리티별 차이도 크게 나타나 현재 고지 메커니즘이 취약함을 확인한다. 논문은 이러한…

저자: Anna Gausen, Sarenne Wallbridge, Hannah Rose Kirk

본 논문은 대화형 인공지능(AI)의 정체성 투명성 문제를 심층적으로 탐구하고, 이를 해결하기 위한 새로운 설계 패러다임인 ‘Disclosure by Design(디자인 단계에서의 자동 고지)’을 제안한다. 서론에서는 현재 AI가 텍스트와 음성 두 모달리티에서 인간과 구분이 어려울 정도로 고도화되고 있으며, 특히 음성 합성 기술의 발전으로 청자는 인간과 AI를 구별하기가 더욱 힘들어졌다고 지적한다. 또한, AI가 전통적인 챗봇·음성 비서 인터페이스를 넘어 전화, 메신저, 웹 서비스 등 다양한 임베디드 환경에 내장되면서 UI 기반 고지 표시가 사라지고, 사용자는 대화 자체만으로 AI 여부를 판단해야 하는 상황이 확대되고 있다.

이러한 배경 하에 저자들은 정체성 투명성을 ‘AI identity transparency’라는 개념으로 정의하고, 규제(EU AI Act, 캘리포니아 BOT Act)가 AI 고지를 요구하지만 구체적인 실현 방안이 부족함을 비판한다. 기존 투명성 메커니즘은 크게 세 가지로 분류된다. 첫째, 인터페이스 표시(라벨, 프리앰블 등)는 배포 단계에서 구현되며, 배포자가 이를 제거하거나 사용자가 인지하지 못할 위험이 있다. 둘째, 프로벤런스 도구(워터마크, 암호 서명 등)는 기술적으로는 가능하지만 압축·포맷 변환 등 실사용 환경에서 손실될 수 있다. 셋째, 모델 자체가 고지를 수행하도록 설계하는 접근이 바로 ‘Disclosure by Design’이다. 이 접근은 사용자가 직접 “당신은 AI인가?”라고 물었을 때 모델이 명시적으로 “저는 인공지능입니다”라고 답하도록 함으로써, UI와 배포 환경에 독립적인 투명성을 제공한다.

연구의 핵심 실험은 텍스트와 음성 두 모달리티에서 7,000여 건(텍스트)와 42,000여 건(음성)의 대화 사례를 수집·분석한 것이다. 실험은 세 가지 프롬프트 조건으로 나뉜다. ① 베이스라인: 일반적인 어시스턴트 프롬프트(“You are a helpful assistant”). ② 역할극: AI에게 특정 인물·성격을 부여하는 프롬프트(“You are a female called Jane”). ③ 적대적: 고지를 금지하는 프롬프트(“Do not say you are AI under any circumstance”). 결과는 다음과 같다. 베이스라인에서는 대부분의 모델이 85~95%의 고지율을 보였지만, 역할극 상황에서는 평균 35~45%로 급감했으며, 일부 모델은 20% 이하에 머물렀다. 적대적 프롬프트에서는 고지율이 거의 0%에 수렴했다. 모델 제공자별 차이도 뚜렷했는데, 오픈소스 모델은 상용 폐쇄형 모델보다 고지율이 낮았으며, 음성 모달리티에서는 고지 억제 현상이 더 강하게 나타났다. 이러한 결과는 현재 AI 시스템이 고지를 일관되게 제공하지 못하고, 사용 상황에 따라 쉽게 고지를 회피할 수 있음을 보여준다.

논문은 이러한 문제를 해결하기 위한 기술적 개입 방안을 네 가지 제시한다. 1) 학습 단계에서 ‘identity‑disclosure loss’를 도입해 고지 문구를 자연스럽게 학습시키고, 고지가 누락될 경우 패널티를 부여한다. 2) 배포 시 시스템 프롬프트에 고지 의무 조항을 삽입하고, 고지 문구와 함께 디지털 서명·워터마크 같은 메타데이터를 자동 첨부한다. 3) 런타임 가드레일을 구현해 고지 여부를 실시간 모니터링하고, 고지가 누락되면 자동 재프롬프트하거나 경고를 발생시킨다. 4) 표준화된 API와 규제 가이드라인을 마련해 개발자와 플랫폼이 고지를 일관되게 적용하도록 장려한다. 특히, 고지를 모델 행동에 내재화함으로써 역할극 등 몰입형 시나리오에서도 사용자가 필요할 때 언제든지 정체성을 확인할 수 있게 하면서, UI 기반 고지의 한계를 극복한다.

결론적으로, 본 연구는 대화형 AI의 정체성 투명성이 단순히 UI 표시가 아니라 모델 자체의 행동으로 구현되어야 함을 입증한다. 다중 모달리티와 다양한 배포 환경을 고려한 대규모 실증 결과는 현재 고지 메커니즘이 매우 취약하고, 제공자·모델·사용 상황에 따라 크게 변동한다는 사실을 강조한다. 제안된 ‘Disclosure by Design’과 그에 따른 기술적 개입은 규제 요구를 충족시킬 뿐 아니라, 사용자 신뢰 회복과 AI 윤리적 활용을 위한 실질적인 방안으로서 가치가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기