강의 영상 이해를 위한 LEMON 벤치마크: 멀티모달 대형 언어 모델의 시간적 추론 능력 평가

초록

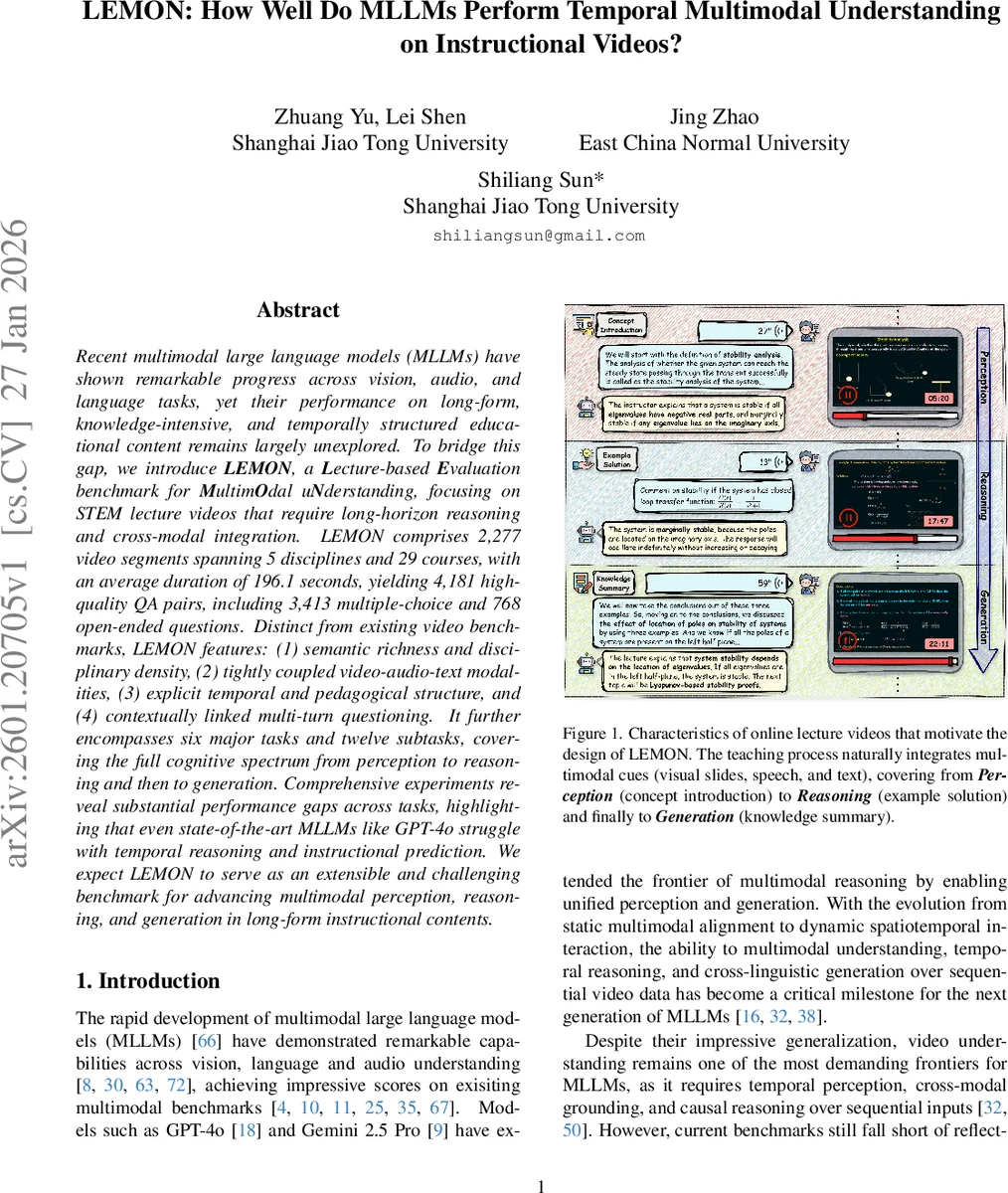

LEMON은 STEM 강의 영상을 기반으로 2,277개의 영상 세그먼트와 4,181개의 QA 쌍을 제공하는 새로운 멀티모달 벤치마크이다. 영상·오디오·자막의 삼중 모달리티와 긴 시간 흐름, 다단계 인지 과제를 결합해 MLLM의 시각·청각·언어 통합 능력과 시간적 추론·예측 능력을 종합적으로 평가한다. 실험 결과 GPT‑4o 등 최신 모델도 시간적 일관성 및 교육적 예측에서 큰 격차를 보인다.

상세 분석

LEMON은 기존 비디오 QA 벤치마크와 차별화되는 네 가지 핵심 특성을 갖는다. 첫째, 교육용 강의라는 도메인 특성상 내용이 고도로 구조화되고 개념 간 인과관계가 명확히 드러난다. 이는 모델이 단순 객체 인식이 아니라 ‘왜’와 ‘어떻게’라는 질문에 답하도록 강제한다. 둘째, 영상, 오디오, 자막이 모두 제공돼 멀티모달 정합성을 검증한다. 특히 자막이 없는 상황에서도 오디오만으로 질문을 풀어야 하는 서브태스크가 포함돼, 음성 인식·청취 이해 능력을 별도로 측정한다. 셋째, ‘시간적 인식(TA)’과 ‘교육적 예측(IP)’ 같은 과제는 모델이 긴 시퀀스를 기억하고 미래 행동을 예측하도록 설계돼 있다. 이는 현재 대부분의 MLLM이 30초1분 정도의 짧은 컨텍스트에 최적화돼 있는 점을 드러낸다. 넷째, 다중 턴 대화 형식으로 질문이 연쇄적으로 연결돼, 이전 답변을 기억하고 활용해야 한다. 이는 대화형 AI가 실제 교육 현장에서 연속적인 강의 흐름을 따라가며 학생의 질문에 답변하는 시나리오를 모사한다. 실험에서는 오픈소스 Omni 모델부터 상용 GPT‑4o, Gemini 2.5 Pro까지 10여 종을 평가했으며, 전반적으로 시각·청각·텍스트 정합성은 어느 정도 달성했지만, 특히 ‘시간적 순서 추론’과 ‘다음 강의 내용 예측’에서는 2030% 수준의 정확도 저하가 관찰되었다. 이는 현재 모델이 프레임‑레벨 정보를 효율적으로 누적하거나, 강의자의 의도와 교육 흐름을 파악하는 고차원 메타 인지를 아직 충분히 학습하지 못했음을 의미한다. 또한, QA 생성 과정에서 GPT‑4o를 활용했음에도 불구하고 인간 검증을 거쳐야 할 정도로 자동 생성 질문의 품질 관리가 필요함을 보여준다. 전반적으로 LEMON은 멀티모달 장기 기억, 인과 추론, 그리고 교육적 의도 파악이라는 세 축에서 MLLM의 한계를 명확히 드러내며, 향후 모델 설계 시 ‘스트리밍 인코더’, ‘멀티모달 기억 네트워크’, ‘교수법 기반 프롬프트’ 등의 연구 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기