디사: 시각 언어 모델의 전경·배경 편향을 해소한 오픈보캘러리 세그멘테이션 프레임워크

초록

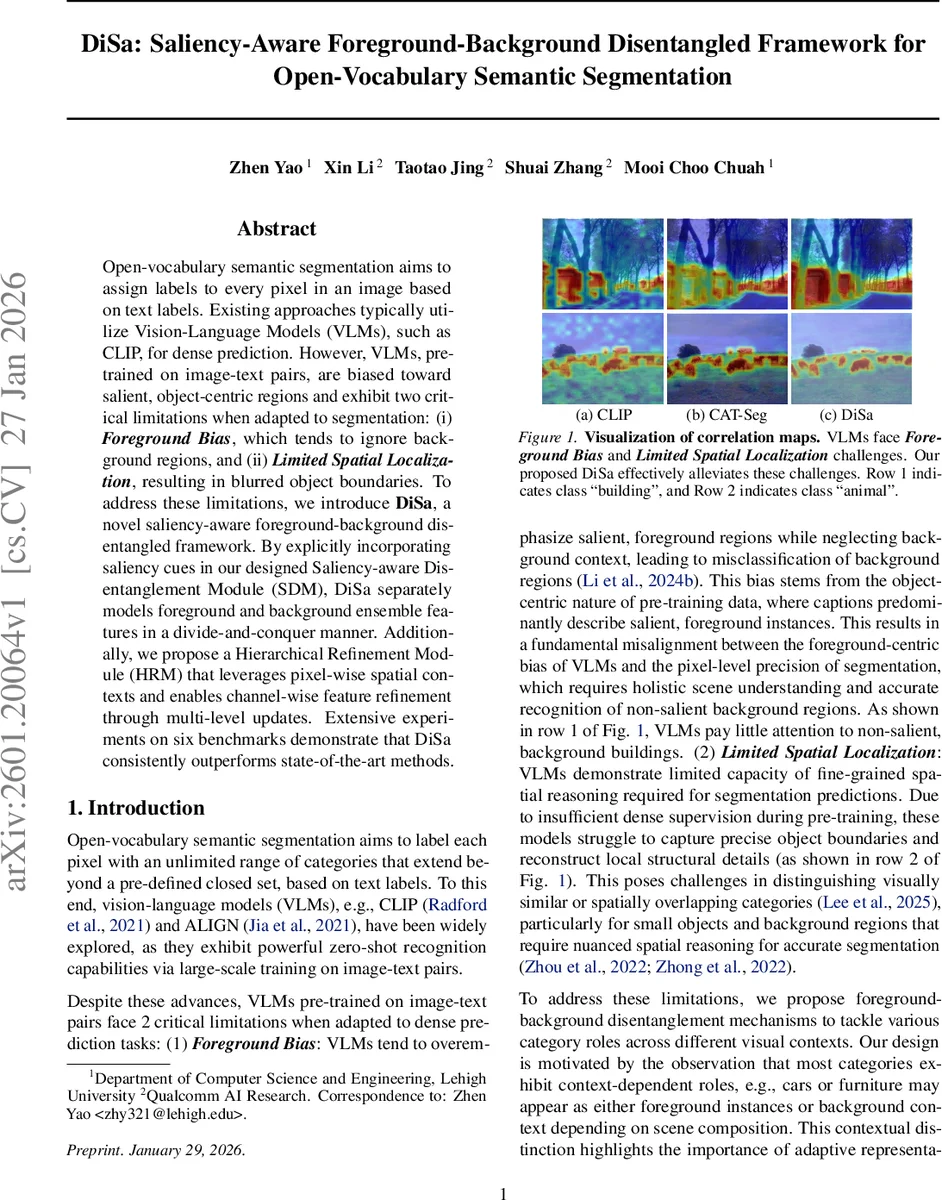

DiSa는 CLIP 기반 VLM의 전경 편향과 흐릿한 경계 문제를 해결하기 위해, 클래스별 saliency 맵을 이용해 전경·배경 특징을 명시적으로 분리하는 Saliency‑aware Disentanglement Module(SDM)과, 픽셀·채널·시맨틱 수준에서 다중 단계 정제하는 Hierarchical Refinement Module(HRM)을 도입한다. 6개 벤치마크에서 기존 최첨단 방법들을 지속적으로 앞선다.

상세 분석

본 논문은 오픈보캘러리 의미분할(Open‑Vocabulary Semantic Segmentation, OVSS)에서 Vision‑Language Model(VLM)인 CLIP이 갖는 두 가지 근본적인 한계, 즉 전경 편향(Foreground Bias)과 제한된 공간 위치정밀도(Limited Spatial Localization)를 체계적으로 분석한다. 전경 편향은 이미지‑텍스트 쌍 학습 시 캡션이 주로 눈에 띄는 객체만을 기술하기 때문에, 모델이 배경 영역을 무시하거나 오인식하게 만든다. 제한된 공간 위치정밀도는 CLIP이 전역적인 이미지‑텍스트 정합에 초점을 맞추어, 픽셀 수준의 세밀한 경계 정보를 학습하지 못한다는 점에서 비롯된다.

DiSa는 이러한 문제를 “전경‑배경 분리(disentanglement)”라는 관점에서 접근한다. 핵심은 클래스별 saliency 맵을 활용해 각 클래스의 시각 임베딩을 전경(고유한, 물체 중심)과 배경(맥락·주변)으로 나누는 Saliency‑aware Disentanglement Module(SDM)이다. 구체적으로, 텍스트 임베딩을 쿼리, 이미지 임베딩을 키·밸류로 하는 cross‑attention을 수행해 초기 attention map A를 얻는다. 이후 Image‑Text Matching(ITM) 손실을 통해 얻은 그라디언트를 Grad‑CAM 방식으로 A에 재가중치하여 클래스별 saliency Sₙ을 생성한다. 이 saliency는 각 픽셀에 대한 중요도 스코어로 작용해, 임계값 기반 혹은 소프트맥스 기반으로 전경·배경 토큰을 분리한다. 이렇게 분리된 두 흐름은 각각 독립적인 백본(프론트엔드)에서 ensemble feature를 학습하며, 전경 흐름은 물체 경계와 세밀한 형태 정보를, 배경 흐름은 장면 전반의 맥락 정보를 강조한다.

분리된 특징은 Hierarchical Refinement Module(HRM)으로 전달된다. HRM은 세 단계로 구성된다. ① Pixel‑wise Refinement은 3×3 혹은 5×5 컨볼루션과 dilated convolution을 결합해 지역적 공간 컨텍스트를 강화하고, 전경·배경 각각의 경계 흐림을 보정한다. ② Category‑wise Refinement은 채널 차원에서 클래스별 attention을 적용해, 동일 클래스 내 전경·배경 토큰 간의 상호 보완성을 학습한다. 여기서는 squeeze‑excitation 구조와 transformer‑style self‑attention을 교차 적용해 클래스 간 관계를 정제한다. ③ Semantic‑wise Refinement은 전경·배경 그룹 전체를 하나의 시맨틱 클러스터로 묶어, 그룹 레벨에서 일관된 표현을 만들고, 특히 작은 객체와 얇은 경계에서 발생하는 잡음을 억제한다. 각 단계는 residual 연결을 통해 이전 단계의 정보를 보존하면서 점진적으로 정제된다.

최종적으로, 정제된 전경·배경 특징 C′′_f, C′′_b는 가중치 기반 어그리게이션 블록을 통해 하나의 통합된 correlation map eC에 합쳐진 뒤, up‑sampling decoder(예: bilinear + 1×1 conv)로 픽셀‑레벨 마스크 ȳ를 출력한다.

실험에서는 ADE20K‑Panoptic, COCO‑Stuff, Pascal‑Context 등 6개 대규모 OVSS 벤치마크에 대해 mIoU, mAcc, FB‑IoU 등 다양한 지표를 측정하였다. DiSa는 기존 CLIP‑기반 방법(CAT‑Seg, SegCLIP 등) 대비 평균 3~5%p의 mIoU 향상을 보였으며, 특히 배경 클래스에서의 성능 상승이 두드러졌다. Ablation study에서는 (1) saliency‑guided 분리 없이 단순 토큰‑레벨 분리, (2) HRM 없이 단일 refinement, (3) ITM 손실 제거 등 각각을 제거했을 때 성능이 급격히 감소함을 확인하였다. 이는 saliency‑aware 전경·배경 분리와 다단계 정제가 각각 독립적으로 기여함을 증명한다.

한계점으로는 saliency 맵 생성에 Grad‑CAM과 ITM 손실을 사용함에 따라 추가 연산 비용이 발생하고, 매우 복잡한 장면에서 saliency가 과도하게 전경에 편중될 가능성이 있다. 향후 연구에서는 경량화된 saliency 추정기와 동적 임계값 조정 메커니즘을 도입해 실시간 적용성을 높이는 방향이 제시된다.

요약하면, DiSa는 “전경‑배경을 명시적으로 구분하고, 다중 레벨에서 정제한다”는 두 축을 통해 VLM 기반 OVSS의 근본적인 편향과 위치정밀도 문제를 효과적으로 해소한 프레임워크라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기