실제 크기 복원으로 식사량 추정하는 3D 모델링

초록

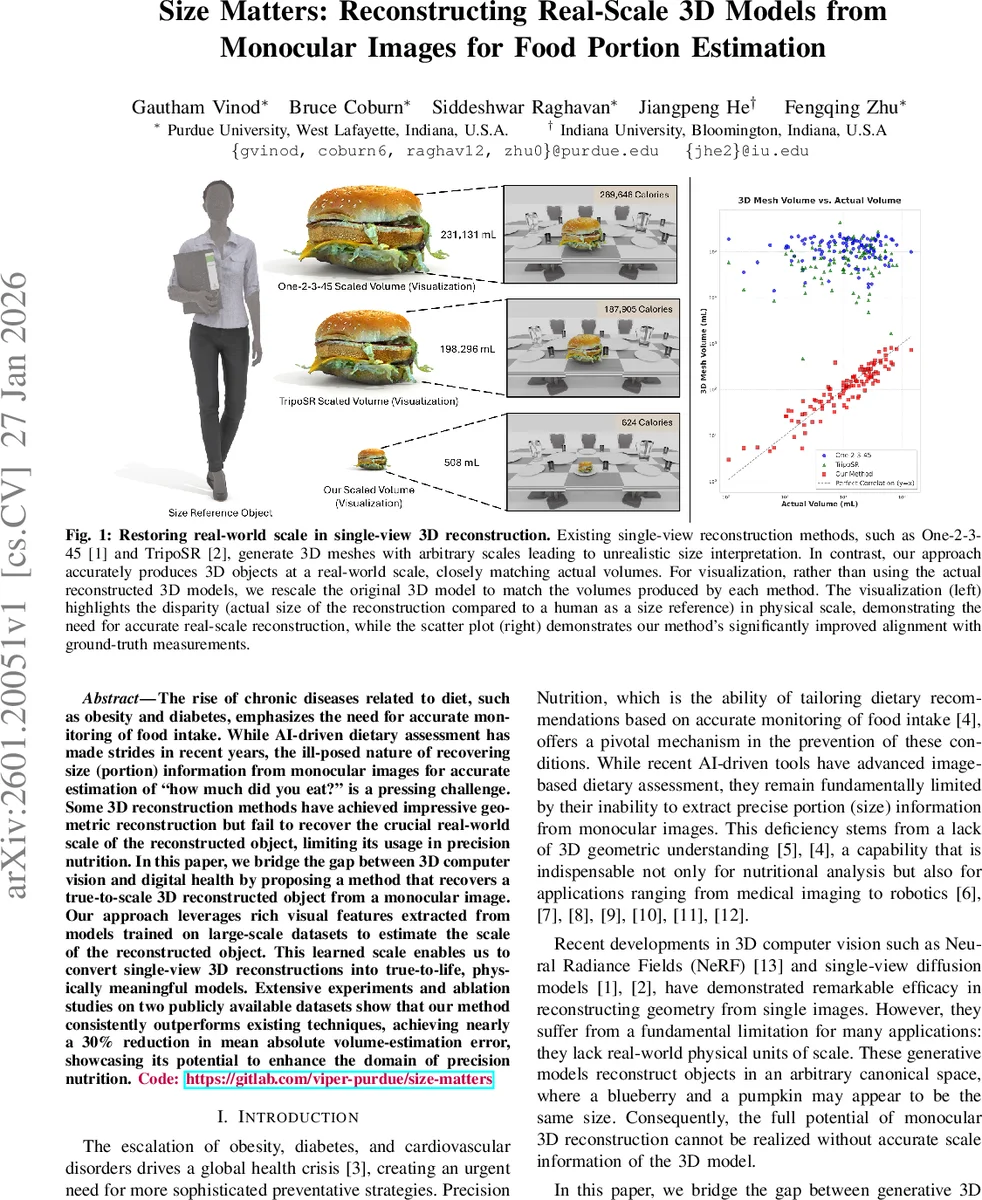

본 논문은 단일 RGB 이미지로부터 물체의 실제 물리적 크기를 복원하는 방법을 제안한다. CLIP 기반 이미지 특징과 다각도 렌더링을 결합해 3D 재구성 모델의 부피 스케일 팩터를 예측하고, 이를 통해 식품의 부피와 칼로리를 정확히 추정한다. MetaFood3D와 OmniObject3D 데이터셋에서 기존 방법 대비 평균 부피 오차를 최대 30% 감소시켰다.

상세 분석

이 연구는 “단일 이미지 → 실제 스케일 3D 모델”이라는 고전적인 역문제에 새로운 해법을 제시한다. 핵심 아이디어는 두 단계로 나뉜다. 첫 번째 단계는 최신 단일‑뷰 3D 재구성 모델인 One‑2‑3‑45를 그대로 사용해 고품질 메쉬를 생성하되, 스케일은 임의의 정규화된 단위에 머무른다. 여기서 중요한 점은 사전 학습된 Segment Anything Model(SAM)으로 입력 이미지를 전처리해 객체 마스크를 제공함으로써 재구성 품질을 높인다는 것이다.

두 번째 단계인 Real‑Scale Module은 물리적 스케일을 추정한다. 저자들은 CLIP 이미지 인코더(ViT‑L/14)를 활용해 원본 이미지와 재구성 메쉬를 다양한 각도에서 렌더링한 75개의 뷰를 각각 임베딩한다. CLIP은 비록 메트릭 스케일을 직접 학습하지 않았지만, 객체의 카테고리, 재질, 전형적인 크기 정보를 내재하고 있어 스케일 추정에 충분한 신호를 제공한다. 각 렌더링 뷰와 원본 이미지 임베딩을 연결(concatenate)한 뒤, 3‑layer MLP에 입력해 부피 스케일 팩터(v_scale)를 회귀한다. 여기서 v_scale은 실제 부피(V_gt)와 재구성 부피(V_recon)의 비율이며, 최종 스케일링은 메쉬에 ³√v̂_scale 를 적용해 물리적 단위(밀리리터)로 변환한다.

학습 손실은 정규화 L1 손실을 사용해 작은 부피 객체에서 발생하는 퍼센트 오류를 완화한다. 또한, 다중 뷰 평균을 통해 노이즈를 감소시키고, 렌더링 수를 실험적으로 조정해 성능-연산 비용 트레이드오프를 분석한다.

실험에서는 두 개의 공개 데이터셋을 사용한다. MetaFood3D는 637개의 식품 3D 모델과 실제 부피·영양 정보를 제공하며, OmniObject3D는 일반 물체 3,417개를 포함한다. 평가 지표는 MAE, MAPE, Pearson r, R², 코사인 유사도 등이다. 결과는 기존 RGB‑only 추정, 깊이 기반 재구성, 3D‑보조 방법, 최신 VLM(GPT‑4o) 등을 크게 앞선다. 특히 MetaFood3D에서 MAE가 59 mL(‑29.3%)로, MAPE가 35.8 %(‑43.3%) 감소했으며, OmniObject3D에서도 MAE가 70 mL(‑22.9%)까지 개선되었다.

이 논문의 강점은 (1) 기존 단일‑뷰 재구성 파이프라인을 그대로 활용해 추가 학습 비용을 최소화, (2) CLIP이라는 범용 비전‑언어 모델을 스케일 추정에 효과적으로 재활용, (3) 다각도 렌더링을 통해 2D 특징에 3D 형태 정보를 보강한다는 점이다. 한계점으로는 (a) 렌더링 수가 많을수록 GPU 메모리와 시간 비용이 급증한다는 점, (b) 매우 작은 혹은 비정형 물체에 대해 스케일 추정 정확도가 떨어질 가능성, (c) 실제 식사 환경에서 조명·배경·그림자 변동에 대한 견고성 검증이 부족하다는 점을 들 수 있다. 향후 연구에서는 경량화된 뷰 샘플링 전략, 도메인 적응을 위한 메타‑학습, 그리고 실시간 모바일 적용을 위한 최적화가 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기