추론‑핵심 뉴런 활성 조정으로 LLM 추론 신뢰성 크게 향상

초록

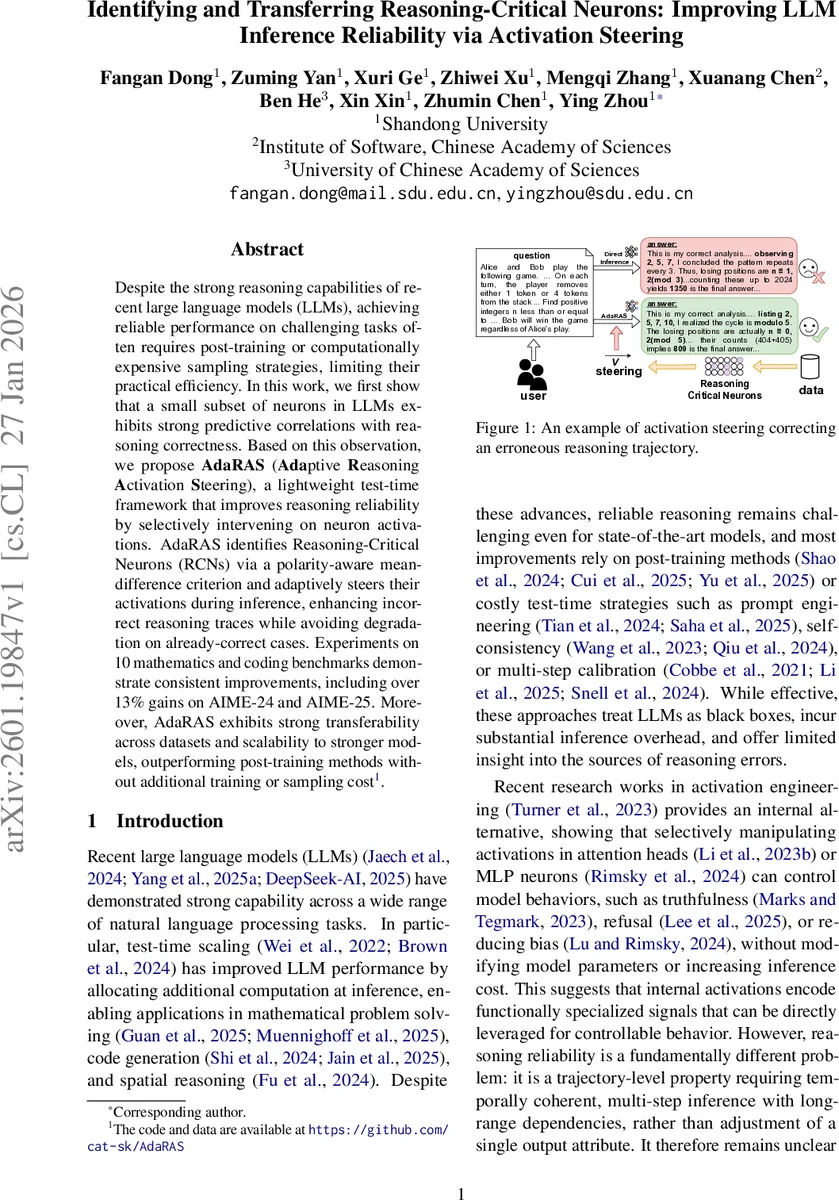

AdaRAS는 소수의 추론‑핵심 뉴런(RCN)을 찾아 테스트 시 활성값을 조절함으로써, 별도 파인튜닝이나 고비용 샘플링 없이도 수학·코딩 벤치마크에서 평균 5% 이상, 특히 AIME‑25에서는 13% 이상의 정확도 상승을 달성한다.

상세 분석

본 논문은 대형 언어 모델(LLM)의 내부 MLP 뉴런 중, 추론 과정의 성공·실패를 강하게 구분하는 소수의 뉴런이 존재한다는 경험적 증거를 제시한다. 저자들은 Qwen‑3 시리즈 모델을 대상으로 마지막 토큰의 활성값을 이용해 이진 정확도 예측(classifier) 를 학습했으며, AUROC가 0.70~0.76 수준에 달함을 확인했다. 이는 “정답‑오답” 트레이스가 뉴런 활성 패턴에서 통계적으로 뚜렷한 차이를 만든다는 것을 의미한다.

이를 기반으로 AdaRAS는 두 단계의 핵심 절차를 수행한다. 첫째, 동일 입력에 대해 정답과 오답을 낸 추론 트레이스를 쌍(pair)으로 수집하고, 각 뉴런의 평균 활성값 차이 S(l,i)를 계산한다. 여기서 S(l,i) > 0이면 정답 트레이스에서 더 활발히 작동하고, <0이면 오답 트레이스에서 더 활발히 작동한다. 둘째, 단순 평균 차이뿐 아니라 활성값 부호가 정답·오답 사이에서 반전되는 뉴런만을 선별한다(극성‑필터링). 이는 SwiGLU와 같은 시그모이드‑형 활성함수에서 부호가 의미하는 “지원” 혹은 “억제” 역할을 활용한 설계이다. 이렇게 추출된 뉴런 집합을 상위 K 개만 남겨 희소한 스티어링 벡터 S′ₗ를 만든다.

AdaRAS의 실제 적용은 MLP 블록 내부에서 hₗ ← hₗ₋₁ + W_down·ϕ(W_up·hₗ₋₁) + α·S′ₗ 와 같이, 기존 출력에 α배의 스티어링 신호를 더하는 형태다. 여기서 α는 실험적으로 조정되는 하이퍼파라미터이며, 모든 디코딩 스텝에 동일하게 적용된다.

하지만 무조건적인 스티어링은 이미 올바른 추론을 방해할 위험이 있다. 이를 해결하기 위해 저자들은 “추론 실패 예측기”를 별도 학습한다. 입력 프롬프트 단계에서의 초기 뉴런 활성값을 F‑통계 기반으로 차원 축소한 뒤, 경량 어텐션 분류기로 학습시켜 AUROC ≈ 0.83을 달성한다. 추론 과정 중 이 예측기가 “실패 가능성”을 감지하면 스티어링을 활성화하고, 그렇지 않으면 원본 모델 출력을 그대로 사용한다. 이 적응형 게이팅 메커니즘은 전체 정확도 손실을 최소화하면서도 오류 샘플에 대한 교정 효과를 극대화한다.

실험은 10개의 수학·코딩 벤치마크(AIME‑24/25, AMC‑12, GSM8K, MATH‑500 등)에서 수행되었으며, AdaRAS는 모든 데이터셋에서 기존 CoT 기반 베이스라인보다 높은 정확도를 기록했다. 특히 AIME‑25에서는 +13.64% 향상을 보이며, 동일 규모의 사후 학습 모델(DeepSeek‑R1‑Distill, OpenThinker 등)을 능가했다. 또한, RCN을 다른 데이터셋에 그대로 적용했을 때도 평균 ≈ 4% 정도의 이득을 유지해 전이 가능성을 입증했다.

이러한 결과는 LLM 내부의 “추론 신호”가 비교적 제한된 뉴런 집합에 집중되어 있음을 시사한다. 기존 연구가 주로 전체 레이어나 어텐션 헤드 수준에서 조작을 시도한 반면, AdaRAS는 MLP 뉴런 수준의 미세 조정을 통해 추론 흐름을 직접적으로 재구성한다. 따라서 파라미터를 변경하지 않으면서도 추론 신뢰성을 크게 향상시킬 수 있는 실용적인 테스트‑타임 솔루션으로 평가된다.

댓글 및 학술 토론

Loading comments...

의견 남기기