시뮬레이션·인간 데이터 공동 학습으로 효율적 로봇 조작

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

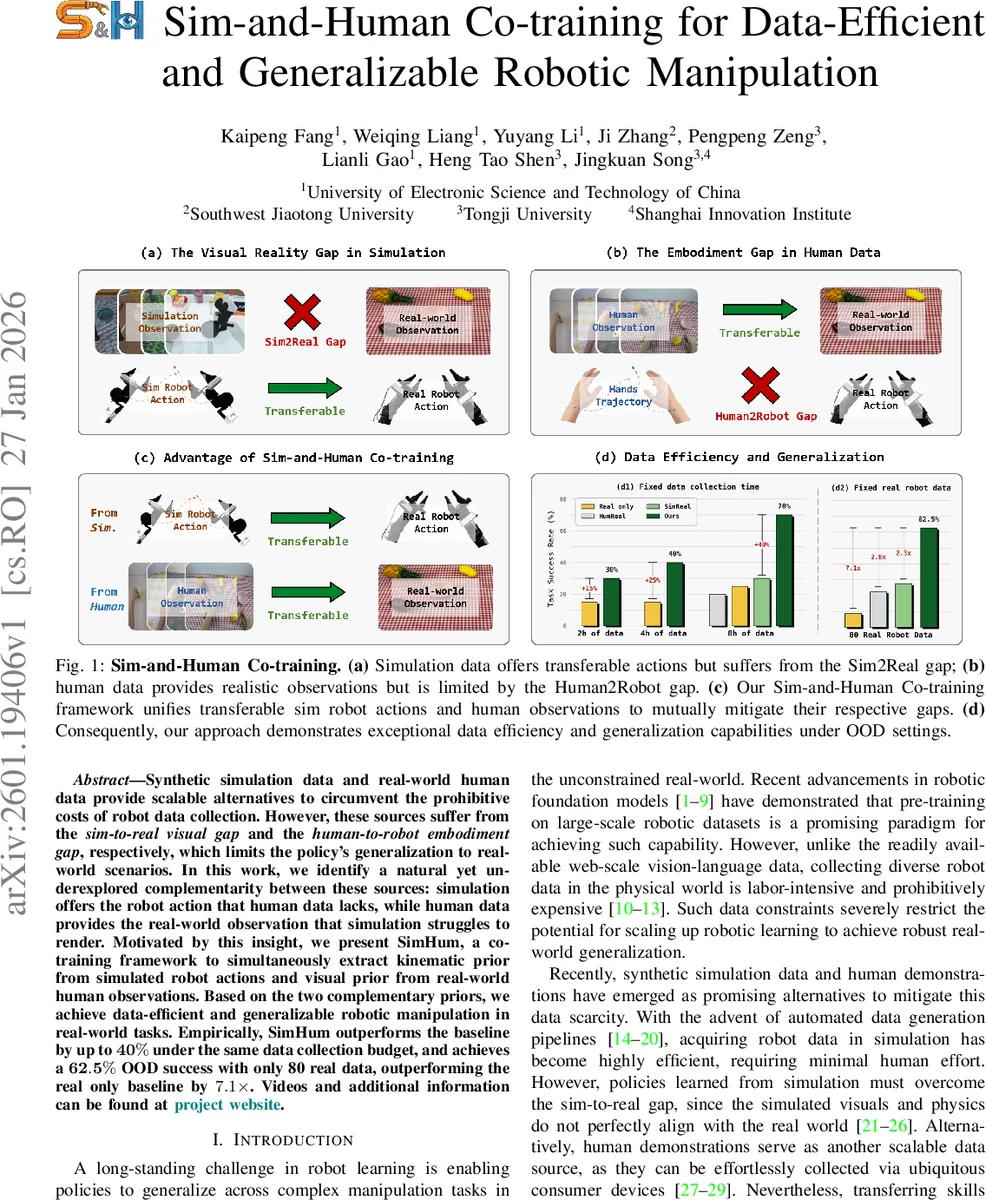

SimHum은 시뮬레이션에서 얻은 로봇 동작과 인간이 촬영한 실제 영상이라는 두 상보적인 데이터원을 동시에 학습해, 적은 양의 실제 로봇 데이터만으로도 높은 일반화 성능을 달성한다. 모듈식 디퓨전 정책 구조와 두 단계 학습(공동 사전학습 → 실제 로봇 미세조정)을 통해 시뮬‑실 차이와 인간‑로봇 구현 차이를 각각 보완한다. 실험 결과, 동일 데이터 예산에서 최대 40 % 성능 향상, 80개의 실제 샘플만으로도 OOD 성공률 62.5 %를 기록했다.

상세 분석

SimHum은 로봇 조작 학습에서 가장 흔히 마주치는 두 가지 도메인 격차—시뮬레이션‑실(Sim2Real) 시각 차이와 인간‑로봇(Human2Robot) 구현 차이—를 동시에 해결하려는 새로운 공동 학습 프레임워크이다. 핵심 아이디어는 “시뮬레이션은 로봇이 실제로 수행 가능한 정확한 액션을 제공하지만, 시각적 현실감이 부족하고, 인간 데이터는 현실적인 관찰을 제공하지만 로봇 관절 구성이 다르다”는 점을 이용해 각각의 강점을 별도의 모듈에 할당하고, 이를 하나의 통합 정책 네트워크에 결합한다는 것이다.

-

데이터 파이프라인

- 시뮬레이션 데이터(D_sim): 실제 로봇과 동일한 URDF를 사용해 kinematic 일치를 보장하고, 도메인 랜덤화(DR)로 다양한 조명·배경·물체 변형을 적용한다. 이렇게 하면 액션 레이블이 실제 로봇과 직접 매핑 가능해진다.

- 인간 데이터(D_hum): 동일 카메라 모델·시점으로 촬영해 시각적 도메인을 실제와 일치시키며, 인간 손 자세를 기록한다. 인간의 행동 자체는 로봇에 바로 적용할 수 없지만, 시각적 특징은 그대로 활용 가능하다.

-

모듈식 디퓨전 정책 구조

- Vision Encoder + Domain‑Specific Adaptors: 공유 비전 인코더 뒤에 시뮬레이션 전용 어댑터와 인간 전용 어댑터를 두어, 각 도메인의 시각적 편향을 별도로 정규화한다. 어댑터는 2‑layer MLP로 설계돼 가벼우면서도 도메인 특성을 효과적으로 캡처한다.

- Action Encoder/Decoder: 인간 손 포즈와 로봇 관절 상태를 각각 별도의 인코더·디코더로 변환한다. 이는 백본 트랜스포머가 “구현 무관한” 조작 의미를 학습하도록 하면서, 구체적인 kinematic 세부사항은 각 인코더/디코더에 국한시킨다.

- Backbone Transformer: 위에서 정제된 시각 토큰과 행동 토큰을 결합해 denoising diffusion 과정을 수행한다. 이 구조는 시퀀스‑투‑시퀀스 행동 예측에 강점이 있다.

-

두 단계 학습 전략

- Sim‑Human Pre‑training: D_sim과 D_hum을 동일 배치에 α 비율(실험에서 0.5가 최적)로 섞어 noise prediction loss를 최소화한다. 이 단계에서 백본은 시각‑행동 간의 공통 표현을 학습하고, 각 어댑터·인코더는 도메인‑특화된 프라이어를 축적한다.

- Real‑Robot Fine‑Tuning: 사전 학습된 모델에서 인간 어댑터(실제 시각 프라이어)와 로봇 액션 인코더/디코더(전달 가능한 kinematic 프라이어)만을 재조합한다. 이후 소량의 실제 로봇 데이터(예: 80 샘플)로 전체 네트워크를 미세조정해 실제 환경에 맞춘다.

-

실험 및 결과

- Task Suite: 스택볼, 벨클릭, 롤러 잡기, 빵 캐비닛 삽입 등 4가지 복합 조작 과제를 선정, 각각이 정밀도, 동시성, 장기 계획을 요구한다.

- 데이터 효율성: 동일 수집 시간(시뮬+인간 vs. 순수 로봇)에서 SimHum이 최대 40 % 높은 성공률을 보였으며, 80개의 실제 샘플만으로 OOD(Out‑of‑Distribution) 상황에서 62.5 % 성공, 기존 실험만 사용한 베이스라인 대비 7.1배 향상했다.

- Ablation: α 비율, 어댑터 존재 여부, 모듈 재조합 전략 등을 교체했을 때 성능 급락을 확인, 특히 인간 비전 어댑터를 유지하지 않으면 시각 격차가 크게 부각된다.

-

핵심 인사이트

- 데이터 상보성 활용: 시뮬레이션과 인간 데이터는 서로의 약점을 메우는 “보완적” 특성을 갖는다. 이를 단순히 합치는 것이 아니라, 각 도메인의 강점을 전용 모듈에 격리시켜 학습시키는 것이 핵심이다.

- 모듈식 설계의 확장성: 어댑터·인코더·디코더를 독립적으로 교체하거나 추가 데이터(예: 실제 로봇 시뮬레이션)와 결합할 수 있어, 다양한 로봇 플랫폼에 쉽게 적용 가능하다.

- 데이터 효율성 vs. 일반화: 소량의 실제 데이터만으로도 높은 OOD 일반화를 달성함으로써, 로봇 학습 비용을 크게 절감한다는 실용적 가치를 제공한다.

-

제한점 및 향후 과제

- 현재는 동일 로봇 구조와 카메라 시점을 전제로 하므로, 다른 로봇 팔·그리퍼 혹은 다중 카메라 설정에선 추가 정렬 단계가 필요할 수 있다.

- 인간 시연이 로봇이 수행하기 어려운 복합 동작(예: 손가락 섬세 조작)을 포함할 경우, 행동 인코더/디코더의 변환 정확도가 제한될 가능성이 있다.

- 향후 연구에서는 자동화된 도메인 매핑(예: 시뮬‑실 이미지 변환 GAN)과 인간‑로봇 동작 매핑을 위한 메타‑러닝 기법을 결합해, 보다 일반적인 로봇 플랫폼에 적용하는 방향을 모색할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기