DART: 확산 영감을 받은 초고속 LLM 추론을 위한 새로운 스펙터티브 디코딩

초록

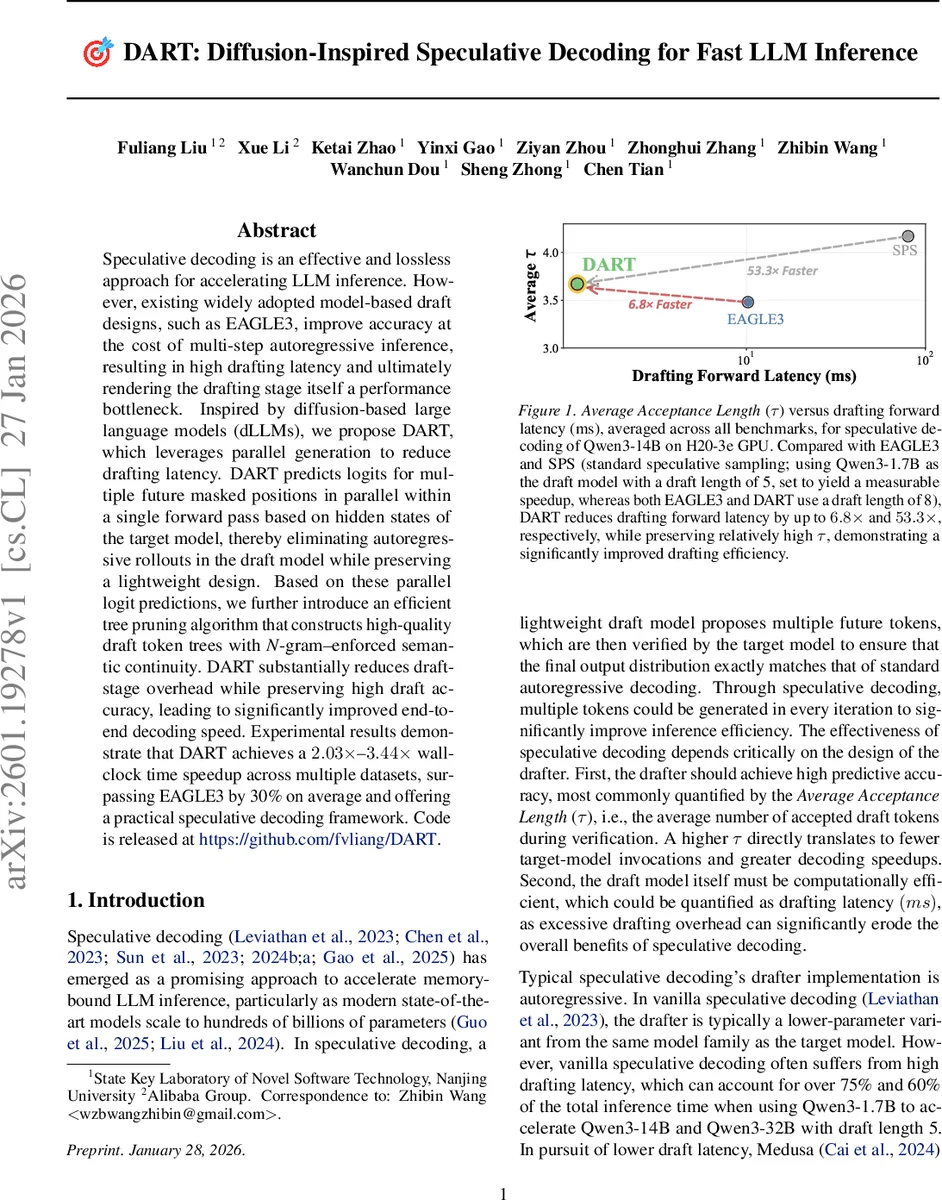

DART는 기존 스펙터티브 디코딩에서 발생하던 초안 단계의 자동회귀 비용을 제거하고, 목표 모델의 은닉 상태를 활용해 단일 경량 레이어로 다중 미래 토큰의 로짓을 한 번에 예측한다. 예측된 로짓을 기반으로 N‑gram 연속성을 보장하는 트리 가지치기 알고리즘을 적용해 고품질 초안 토큰 트리를 구성하고, 이를 목표 모델이 한 번에 검증한다. 실험 결과, DART는 2.03×~3.44×의 전체 속도 향상을 달성하며, 기존 EAGLE3 대비 평균 30% 더 빠른 성능을 보인다.

상세 분석

DART는 확산 기반 대형 언어 모델(dLLM)의 병렬 토큰 생성 아이디어를 스펙터티브 디코딩에 맞게 재구성한 것이 핵심이다. 기존의 EAGLE3와 같은 초안 모델은 경량 레이어를 사용해 정확도를 높였지만, 여전히 자동회귀 방식으로 K 단계씩 순차적으로 토큰을 생성한다. 이 과정에서 초안 단계가 전체 추론 시간의 20~40%를 차지해 병목이 된다. DART는 이를 해결하기 위해 목표 모델의 중간 은닉 상태(h, m, l)를 추출하고, 이를 하나의 완전 연결 층으로 압축한 뒤, 고정 길이의

병렬 로짓 예측은 조합 폭이 기하급수적으로 커지기 때문에, 단순히 모든 후보를 탐색하면 비현실적인 연산 비용이 발생한다. DART는 이를 해결하기 위해 N‑gram 기반 연속성 검증을 포함한 트리 가지치기 알고리즘을 설계했다. 각 위치별 상위 후보 토큰을 N‑gram 모델로 필터링해 의미적 연속성을 유지하고, 불필요한 가지를 조기에 제거한다. 이렇게 구성된 초안 토큰 트리는 ‘Tree Attention’ 메커니즘을 통해 목표 모델이 한 번에 검증한다. 검증 과정은 기존 스펙터티브 디코딩과 동일하게 거부‑수용 절차를 따르므로, 최종 출력 분포는 원본 목표 모델과 완전히 일치한다.

성능 측면에서 DART는 초안 단계의 포워드 지연을 최대 6.8배까지 감소시켰으며, 평균 수용 길이 τ는 기존 방법과 비슷하거나 약간 상승했다. 이는 초안 단계의 비용 감소가 전체 속도 향상에 직접적으로 기여했음을 의미한다. 다양한 벤치마크(코드 생성, 일반 텍스트, 대화형)와 Qwen3·LLaMA2 계열 모델에 대한 실험에서 DART는 2.03×~3.44×의 속도 향상을 기록했고, 특히 코드 중심 워크로드에서 65%까지 추가 가속을 달성했다.

한계점으로는 초안 토큰 수 d가 증가할수록 트리 가지치기 비용이 상승하고, N‑gram 모델의 품질에 크게 의존한다는 점이다. 또한, 현재 구현은 목표 모델과의 긴밀한 결합을 전제로 하므로, 완전히 독립적인 초안 모델을 사용하고자 하는 시나리오에는 적용이 어려울 수 있다. 향후 연구에서는 동적 d 조절, 더 정교한 연속성 모델(예: Transformer 기반 N‑gram), 그리고 멀티‑GPU 환경에서의 스케일링을 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기