고해상도 이미지 품질 평가를 위한 컨텍스트 인식 에이전트 Q‑Probe

초록

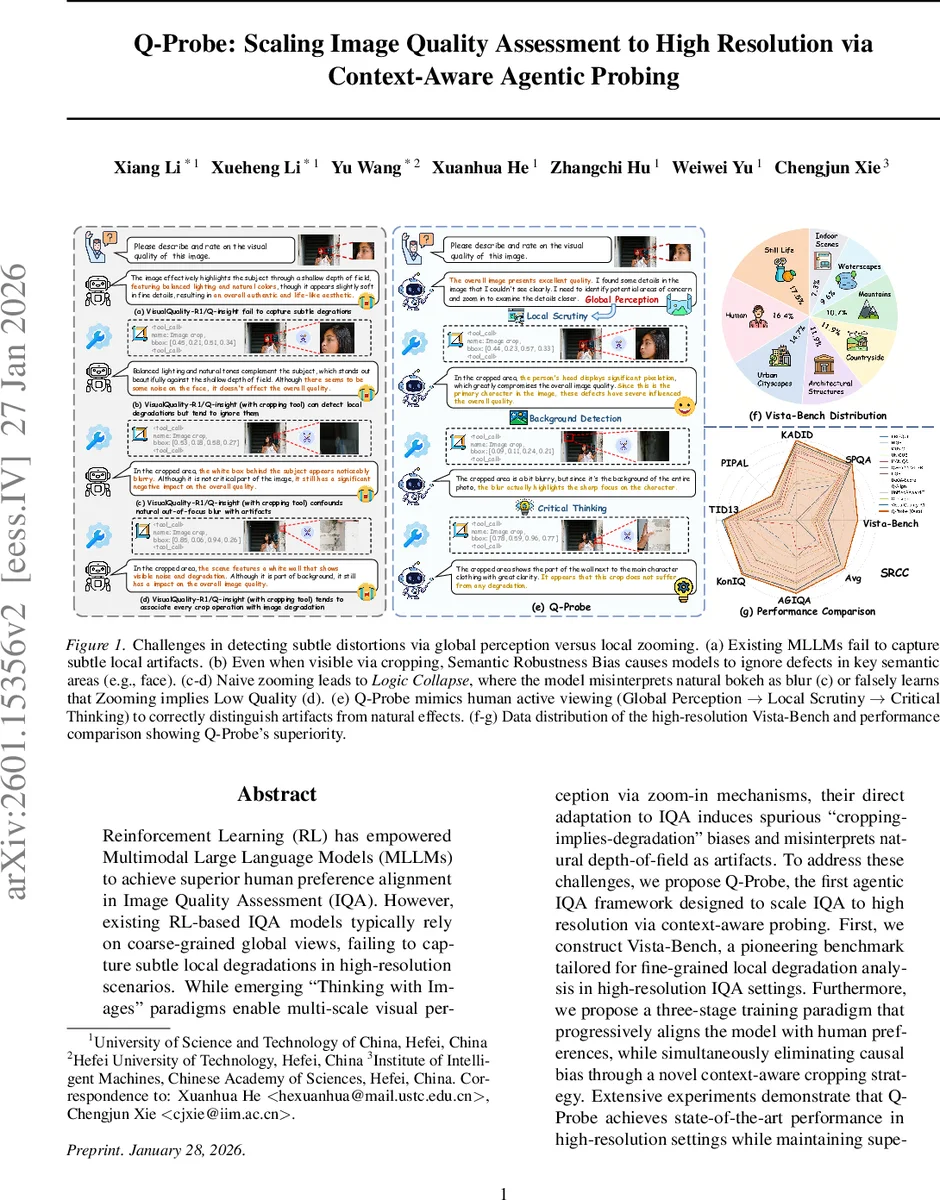

Q‑Probe는 고해상도 이미지에서 미세한 손상을 정확히 포착하기 위해 전역 인식 → 지역 정밀 탐색 → 비판적 사고의 3단계 인간 시각 메커니즘을 모방한 에이전트형 IQA 모델이다. 이를 위해 고해상도 로컬 손상 분석에 특화된 Vista‑Bench 벤치마크와, 전역‑지역 균형을 유지하는 컨텍스트‑aware 크롭 전략을 도입한 3단계 학습 파이프라인을 제안한다. 실험 결과, Q‑Probe는 기존 RL 기반 IQA 모델을 크게 앞서며 다양한 해상도에서 일관된 성능 향상을 보인다.

상세 분석

본 논문은 고해상도 이미지 품질 평가(IQA)에서 두드러지는 두 가지 근본적 한계를 정확히 짚어낸다. 첫째, 기존 RL 기반 MLLM은 전역적인 시야에 의존해 미세한 로컬 손상을 놓치기 쉽다. 특히 얼굴, 차량 번호판 등 의미론적으로 중요한 영역에 발생하는 잡음이나 블러는 전역 점수에 거의 반영되지 않는다. 둘째, “Thinking with Images” 패러다임을 그대로 IQA에 적용하면 “크롭 → 저품질”이라는 인과적 편향이 생겨, 자연스러운 심도 효과(bokeh)를 손상으로 오인하거나, 고품질 영역을 크롭했을 때도 점수가 낮아지는 논리 붕괴가 발생한다.

Q‑Probe는 이러한 문제를 해결하기 위해 세 가지 핵심 설계를 제시한다.

-

Vista‑Bench: 고해상도(>4K) 이미지에 파동변환(wavelet) 기반으로 텍스처와 구조를 분리한 뒤, 텍스처가 풍부한 영역에 선택적으로 블러·압축·모자이크 등 다양한 왜곡을 주입한다. Gemini‑2.5 Pro를 이용해 지역별 의미론적 중요도와 손상 정도를 가중합한 정밀 라벨을 생성함으로써, “어디가 중요한가”와 “얼마나 손상됐는가”를 동시에 학습할 수 있는 데이터셋을 만든다.

-

컨텍스트‑aware 크롭 전략: 단순히 손상 영역만을 크롭하는 것이 아니라, 동일 크롭 안에 자연스러운 배경 흐림이나 선명한 전경을 함께 포함시켜 “크롭이 곧 저품질”이라는 스패urious correlation을 깨뜨린다. 크롭 시점은 전역 인식 단계에서 품질 저하 가능성이 높은 영역을 탐지한 뒤, 필요에 따라 동적으로 선택된다.

-

3단계 학습 파이프라인

- Stage 1: 전역 인식 사전 RL – 저해상도(KADID‑10k) 이미지 쌍을 이용해 그룹 상대 정책 최적화(GRPO) 기반의 쌍별 순위 학습을 수행, 전역적인 미적 감각과 자연스러운 심도 효과를 구분하도록 한다.

- Stage 2: Probe‑CoT‑3K SFT – 전역‑지역 혼합 크롭 트래젝터리를 포함한 CoT(Chain‑of‑Thought) 데이터를 사용해 지도학습을 진행한다. 여기서는 “전역 요약 → 필요 시 지역 탐색 → 결과 종합” 흐름을 모델에게 학습시켜, 도구 사용 시점과 범위를 스스로 판단하도록 만든다.

- Stage 3: Probe‑RL‑4K 강화 RL – 최종적으로 고해상도 Vista‑Bench을 활용, 지역 손상 탐지와 품질 점수 예측을 동시에 최적화하는 복합 보상 함수를 설계한다. 보상은 (i) 손상 지역 정확도, (ii) 전역‑지역 스코어 일관성, (iii) 불필요한 크롭 억제를 포함한다.

실험에서는 SRCC, PLCC 등 표준 상관계수와 함께 인간 주관 평가와의 일치도를 측정하였다. Q‑Probe는 SPQA, KADID‑10k, PIPAL, TID13, KonIQ‑10k, AGIQA 등 기존 벤치마크에서 평균 4‑6%p 상승을 기록했으며, 특히 Vista‑Bench에서 0.92 이상의 SRCC를 달성해 로컬 손상 감지 능력이 크게 향상된 것을 확인했다. 또한, 크롭을 남용하는 기존 모델과 달리 Q‑Probe는 고품질 배경을 포함한 크롭에서도 점수 저하가 없으며, 자연스러운 배경 흐림을 올바르게 ‘품질 유지’로 인식한다.

이 논문은 고해상도 이미지에서 인간과 유사한 “전체‑세부” 시각 전략을 MLLM에 구현함으로써, 기존 전역‑중심 IQA의 한계를 근본적으로 극복했다는 점에서 큰 의의를 가진다. 특히, 컨텍스트‑aware 크롭과 단계적 RL‑SFT 결합은 다른 시각‑언어 작업(예: 비디오 품질 평가, 의료 영상 진단)에도 확장 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기