엣지 GPU에서 딥러닝 추론을 위한 성능 격리 기법 비교

초록

본 논문은 NVIDIA A100과 Jetson Orin에서 제공되는 MPS, MIG, Green Contexts 세 가지 격리 메커니즘을 실험적으로 평가한다. MIG는 높은 메모리·연산 격리를 제공하지만 에너지 효율이 낮고, Green Contexts는 SM 단위의 미세한 할당이 가능해 엣지 디바이스에 적합하지만 메모리 격리는 지원하지 않는다. 실시간 안전‑중요 애플리케이션에서의 추론 지연 예측 가능성을 중심으로 각 기술의 장·단점을 정리한다.

상세 분석

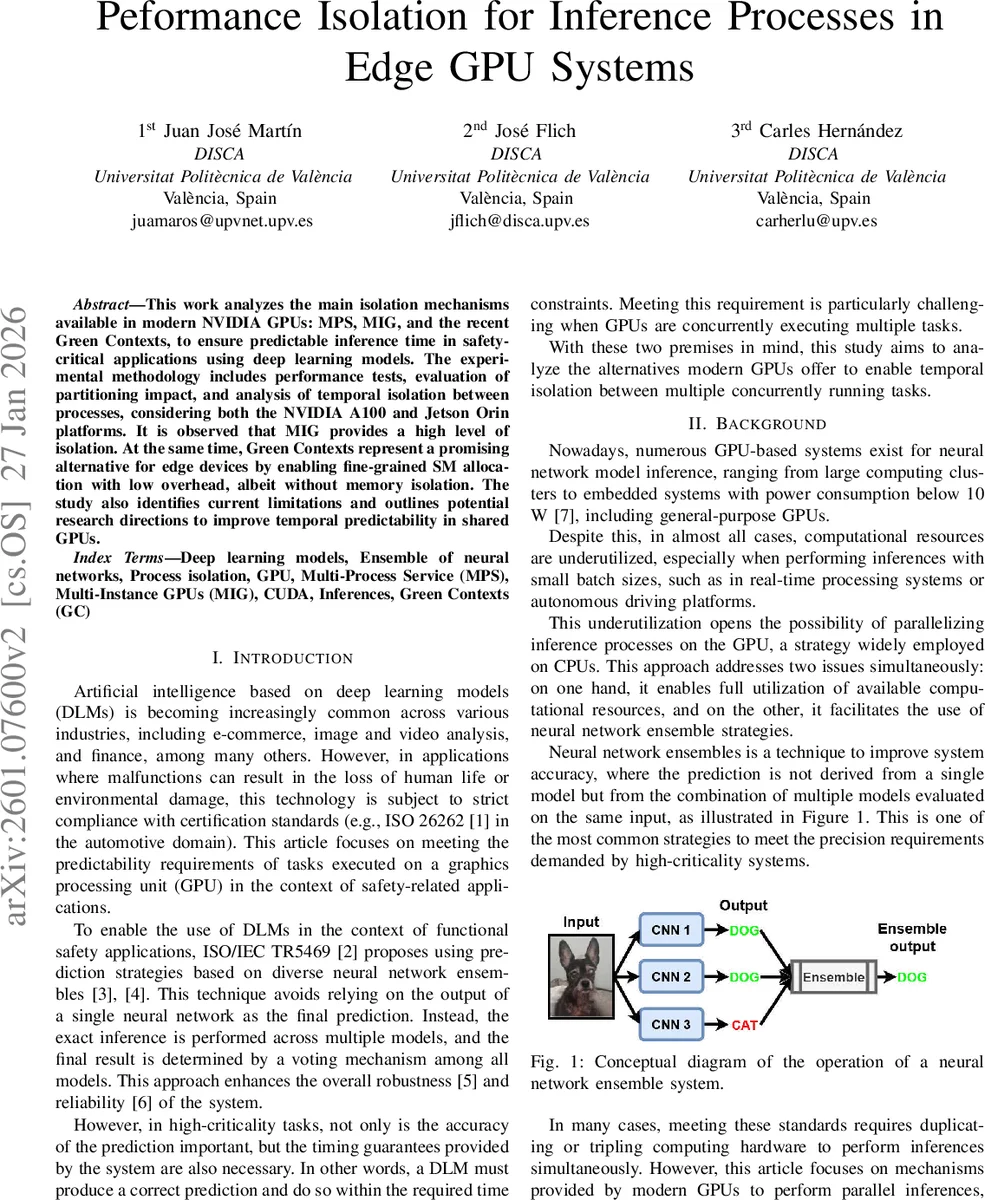

논문은 먼저 GPU 기반 딥러닝 추론이 배치 크기가 작을 때 자원 활용도가 낮아지는 현상을 지적하고, 이를 해결하기 위해 다중 모델 앙상블을 동시에 실행하는 방안을 제시한다. 이를 위해 선택된 격리 메커니즘은 크게 소프트웨어 기반(MPS, Green Contexts)과 하드웨어 기반(MIG)으로 구분된다.

MPS는 CUDA 컨텍스트를 통합해 컨텍스트 전환 오버헤드를 최소화하지만, 실제 연산 자원의 물리적 분할은 제공하지 않는다. 실험 결과, MPS 환경에서 두 프로세스가 경쟁할 경우 한 프로세스의 최대 추론 주파수가 급격히 감소하며, 타임아웃 발생률이 높아짐을 확인했다. 이는 안전‑중요 시스템에서 시간 보장을 요구할 때 MPS만으로는 충분하지 않음을 시사한다.

MIG는 GPU를 GPC 단위로 물리적으로 분할하고, 각 파티션에 전용 메모리와 SM을 할당한다. A100에서 3 GPC씩 두 파티션으로 나눌 경우, 각 파티션은 독립적인 메모리 풀을 갖게 되므로 메모리 충돌이 발생하지 않는다. 실험에서는 MIG 파티션이 전체 GPU 사용 시보다 약 5 % 정도 낮은 스루풋을 보였지만, 타임아웃 발생이 거의 없었으며, 파티션 간 전력 소비도 균등하게 분배되는 것을 확인했다. 이는 높은 예측 가능성을 제공하지만, 파티션 크기가 고정돼 유연성이 떨어지고, 파티션당 메모리 용량이 제한되는 단점이 있다.

Green Contexts는 CUDA 12.4에서 도입된 기능으로, SM 단위의 미세한 할당을 가능하게 한다. Jetson Orin Nano(4 SM)에서 2 SM씩 두 파티션을 구성했을 때, 메모리 격리는 제공되지 않지만, 각 파티션이 할당된 SM만 사용하도록 강제함으로써 연산 충돌을 방지한다. 실험 결과, Green Contexts는 MPS 대비 타임아웃 발생률이 현저히 낮았으며, 파티션 크기에 따라 스루풋이 선형적으로 변하는 특성을 보였다. 다만, 메모리 사용량이 파티션 간에 공유되기 때문에 메모리 압박 상황에서는 예측 불가능한 지연이 발생할 가능성이 있다.

종합적으로, 논문은 안전‑중요 엣지 애플리케이션에서 요구되는 ‘시간적 격리’를 달성하기 위해서는 물리적 메모리 격리를 제공하는 MIG가 가장 확실한 방법임을 강조한다. 그러나 MIG를 지원하지 않는 저전력 엣지 디바이스에서는 Green Contexts가 실용적인 대안이 될 수 있다. 향후 연구 과제로는 SM 단위의 미세 할당과 메모리 격리를 동시에 제공하는 하이브리드 기법, 그리고 실시간 스케줄러와 연계한 동적 파티션 재구성이 제시된다.

댓글 및 학술 토론

Loading comments...

의견 남기기