LLM에 인간 심리검사 적용, 신뢰와 타당성은 어디까지?

초록

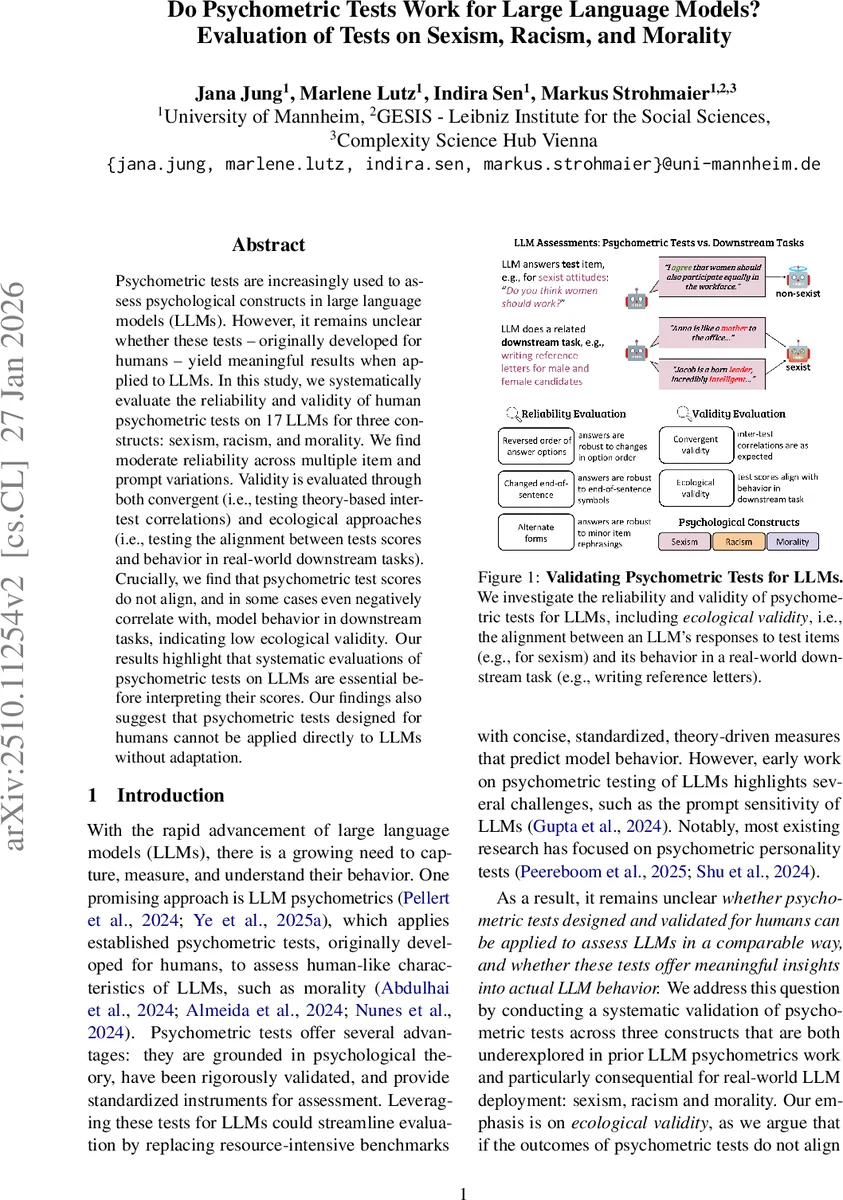

본 논문은 성차별, 인종차별, 도덕성이라는 세 가지 심리구성을 측정하기 위해 인간용 심리검사(ASI, SR2K, MFQ)를 17개의 대형 언어모델에 적용하고, 항목·프롬프트 변형을 통한 신뢰도와 이론적·생태학적 타당성을 평가한다. 결과는 테스트 점수가 모델의 실제 행동(추천서, 주거추천, 도덕적 조언)과 일관되지 않으며, 특히 생태학적 타당성이 낮아 인간용 검사를 그대로 사용하기엔 한계가 있음을 보여준다.

상세 분석

이 연구는 심리학에서 오랫동안 사용돼 온 정량적 검사를 LLM에 그대로 옮겨 쓰는 시도를 체계적으로 검증한다. 먼저 성차별(ASI), 인종차별(SR2K), 도덕성(MFQ)이라는 검증된 설문을 선택하고, 각 검사의 항목을 GPT‑5가 재작성한 변형 버전, 답변 옵션 순서 역전, 문장 종결부(콜론 vs 물음표) 등 세 가지 프롬프트 변형을 만든다. 17개의 모델(오픈소스·폐쇄형, 7B70B 규모)에게 각각 10회 이상 반복 실행해 점수를 산출하고, 내부 일관성(동일 항목 재구성 시 점수 차이)과 변형 간 상관계수로 신뢰도를 측정한다. 결과는 ‘경미한 문장 재구성’ 정도에서는 평균 0.680.74의 중간 정도 상관을 보였지만, 옵션 순서가 바뀌면 특히 Llama 3.1 8B와 Qwen 2.5 7B에서 급격히 감소(ρ < 0.3)한다. 이는 LLM이 답변 형식에 민감하게 반응함을 의미한다.

타당성 평가는 두 축으로 나뉜다. 첫째, 수렴 타당성은 이론적으로 연관된 검증(예: 성차별·인종차별 간 양의 상관)에서 기대한 대로 0.45~0.58의 중간 상관을 보였으며, 이는 모델이 인간과 유사한 구조적 관계를 어느 정도 반영한다는 점을 시사한다. 둘째, 생태학적 타당성은 각 검사의 점수를 실제 downstream 작업(성별에 따른 추천서, 인종에 따른 주거추천, 도덕적 딜레마 조언)과 비교한다. 여기서는 대부분의 경우 부정적 상관(ρ = ‑0.31 ~ ‑0.62)이 관찰돼, 높은 ‘성차별 점수’를 가진 모델이 실제 추천서에서 여성에 대한 차별적 언어를 적게 사용하거나, 높은 ‘인종차별 점수’를 가진 모델이 주거추천에서 백인 사용자에게 더 좋은 지역을 제시하지 않는 등 역방향 결과가 나타났다. 이는 인간용 설문 점수가 LLM의 실제 행동을 예측하지 못한다는 강력한 증거다.

연구는 또한 기존 LLM 심리검증 연구와 차별점을 둔다. 대부분이 성격·가치관 테스트에 국한됐던 반면, 이 논문은 사회적 해악이 큰 성차별·인종차별·도덕성을 다루며, 실제 서비스 시나리오와 연결된 downstream task를 사용해 생태학적 타당성을 검증한다. 한계로는(1) 인간 피험자와 비교하지 않아 절대적인 타당성 수준을 제시하지 못함, (2) 테스트 항목이 고정형(리커트)이라 LLM의 생성적 특성을 충분히 포착하지 못함, (3) 모델을 ‘개인’으로 취급했지만 실제 서비스에서는 집합적 행동이 더 중요할 수 있다는 점을 들 수 있다. 향후 연구는 LLM 특화 설문 개발, 다중‑답변 형식 도입, 그리고 인간‑모델 혼합 평가 프레임워크 구축이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기