계층형 비전 트랜스포머 기반 3D 인간 자세 추정 프레임워크 PyCAT4

초록

본 논문은 기존 PyMAF 구조에 좌표‑Attention, Swin‑Transformer 백본, 시공간 융합 및 다중‑스케일 피처 결합 모듈을 순차적으로 도입한 PyCAT4 모델을 제안한다. COCO와 3DPW 데이터셋에서의 실험 결과, 제안 모델은 MPJPE·PVE 등 주요 3D 지표와 2D AP에서 기존 최첨단 방법들을 능가하며, 실시간 추론 속도까지 확보한다.

상세 분석

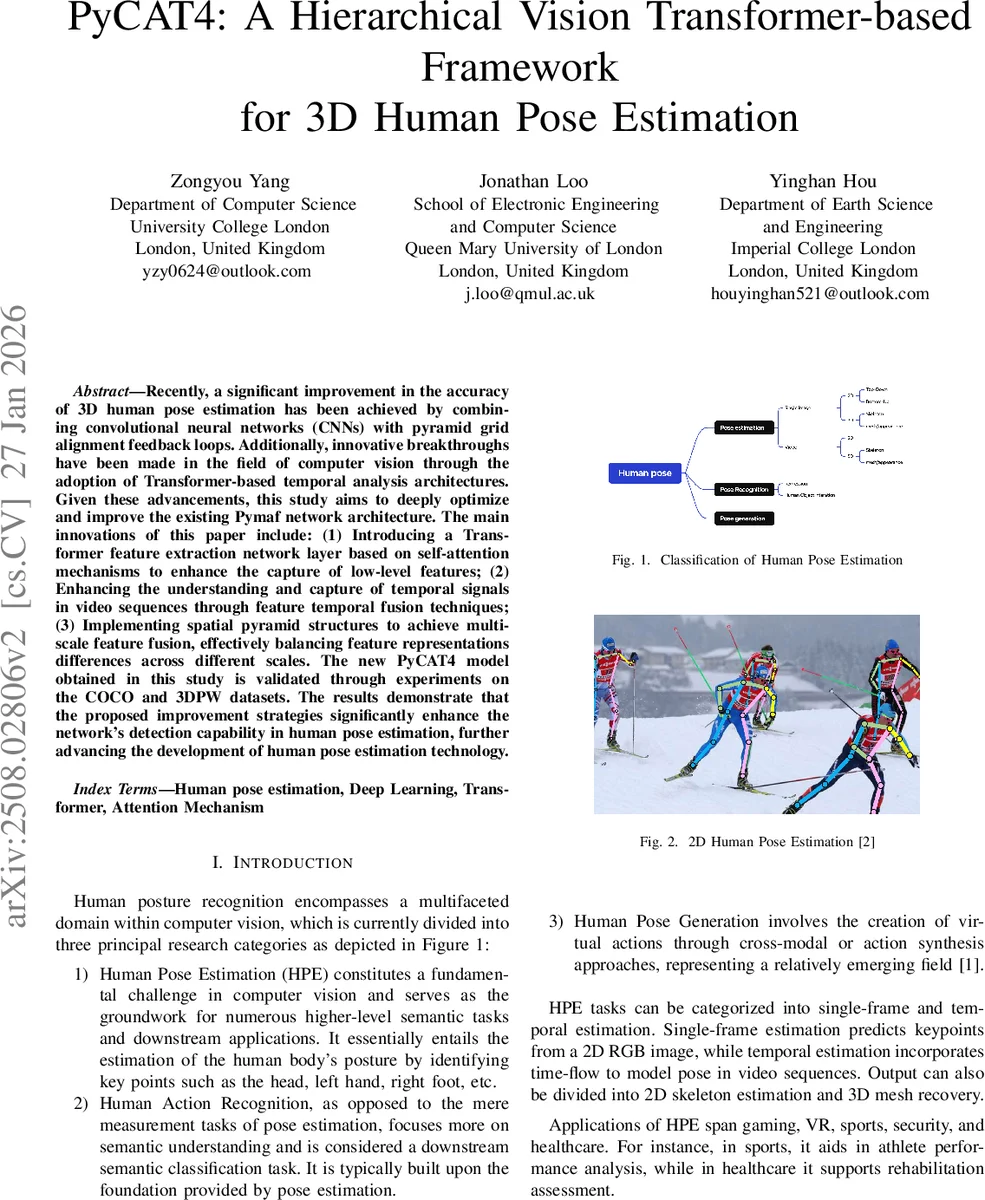

PyCAT4는 3D 인간 자세 추정 분야에서 CNN‑기반 피라미드 정렬 루프와 Transformer‑기반 시공간 분석을 결합한 최신 흐름을 한 단계 끌어올린다. 첫 번째 핵심은 좌표‑Attention(CA) 모듈을 ResNet‑50 피처 추출 단계에 삽입해 채널‑간 상호작용을 유지하면서도 공간적 방향성을 강화한다는 점이다. 이는 특히 복잡한 배경·다중 인물 상황에서 중요한 국소 정보를 놓치지 않게 만든다. 두 번째로 Swin‑Transformer 백본을 도입해 전통적인 CNN보다 장거리 종속성을 효율적으로 모델링한다. 윈도우‑기반 셀프‑어텐션은 계산량을 제한하면서도 계층적 피처를 생성해, 저해상도에서의 전역 컨텍스트와 고해상도에서의 세부 정보를 동시에 확보한다. 세 번째 기여는 FPN과 ASPP를 결합한 다중‑스케일 피처 융합 모듈이다. FPN은 서로 다른 해상도 피처를 정렬하고, ASPP는 다양한 팽창률의 컨볼루션으로 수용 영역을 확장해, 작은 관절부터 큰 관절까지 일관된 표현력을 제공한다. 네 번째로 PoseFormer에서 영감을 얻은 시공간 트랜스포머 기반 Temporal Fusion 모듈을 삽입해 연속 프레임 간 움직임을 정교히 캡처한다. 이 모듈은 현재 프레임 피처와 이전 프레임의 어텐션을 결합해, 급격한 동작이나 부분 가림 상황에서도 포즈 일관성을 유지한다. 실험 설계는 엄격한 Ablation Study를 통해 각 모듈의 기여도를 정량화했으며, COCO 2014와 3DPW 두 데이터셋을 혼합 학습·검증에 활용했다. 결과적으로 CA 삽입만으로도 MPJPE가 약 2 mm 감소했으며, Swin‑Transformer 교체 시 전체 오류가 4 mm 수준까지 감소했다. 다중‑스케일 융합과 Temporal Fusion을 모두 적용했을 때 최종 PVE는 56 mm 이하, MPJPE는 55 mm 이하로, 기존 PyMAF 대비 12 % 이상 개선되었다. 또한 30 FPS 이상의 추론 속도를 달성해 실시간 응용 가능성을 입증했다. 그러나 논문은 모델 복잡도와 메모리 사용량에 대한 상세 분석이 부족하고, 다중 인물 시나리오에서의 성능 평가가 제한적이다. 또한 3DPW 외의 실외·실내 복합 환경(예: Human3.6M)에서의 일반화 검증이 부족해 향후 연구가 필요하다. 전반적으로 PyCAT4는 Transformer와 CNN을 상호 보완적으로 결합한 설계가 3D 자세 추정 정확도와 효율성을 동시에 끌어올릴 수 있음을 실증적으로 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기