다변량 시계열 예측을 위한 채널 전략 종합 조사

초록

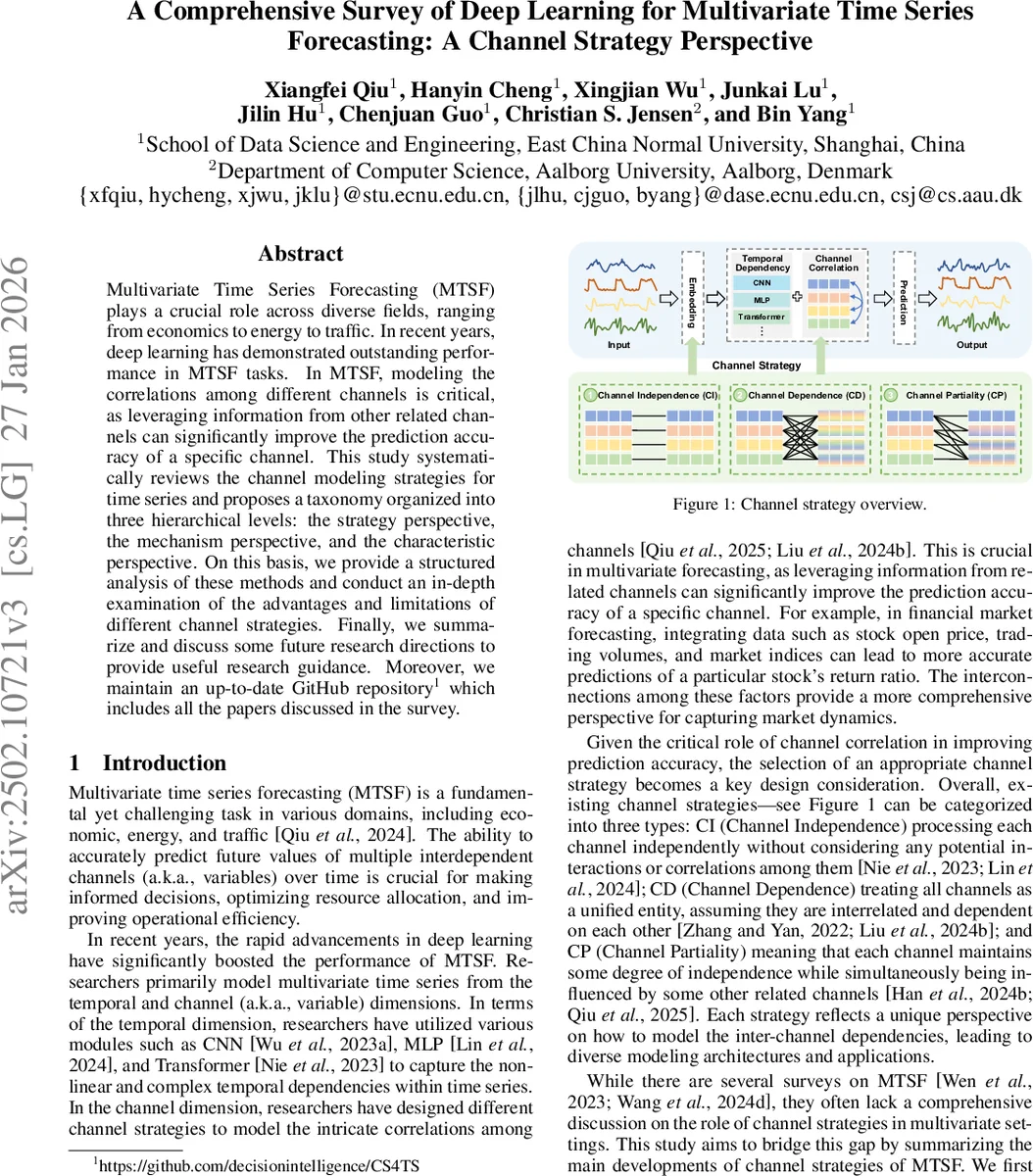

본 논문은 다변량 시계열 예측(MTSF)에서 채널 간 상관관계를 모델링하는 다양한 딥러닝 전략을 체계적으로 정리한다. 채널 독립(CI), 채널 의존(CD), 채널 부분성(CP)이라는 세 가지 전략을 제시하고, 각 전략의 구현 메커니즘(Transformer, CNN, MLP, GNN 등)과 특성(비대칭, 지연, 극성, 그룹화, 동적성, 다중 스케일)을 상세히 분류한다. 또한 대표 모델들을 표로 정리하고, 장·단점을 비교·분석하여 향후 연구 방향을 제시한다.

상세 분석

이 논문은 다변량 시계열 예측에서 “채널”이라는 차원을 어떻게 다루느냐에 따라 모델 성능과 복잡도가 크게 달라진다는 점을 명확히 강조한다. 저자들은 채널 전략을 ‘전략 관점(Strategy)’, ‘메커니즘 관점(Mechanism)’, ‘특성 관점(Characteristic)’이라는 3단계 계층 구조로 분류함으로써 기존 연구들의 공통점과 차이점을 한눈에 파악할 수 있게 했다. 전략 관점에서는 채널 독립(CI), 채널 의존(CD), 채널 부분성(CP)이라는 세 가지 기본 패러다임을 정의하고, 각각을 대표하는 최신 모델들을 구체적으로 제시한다. CI 전략은 각 채널을 별도로 처리해 모델 복잡도를 낮추고, 새로운 채널 추가 시 구조적 변경이 필요 없다는 장점이 있지만, 채널 간 유용한 상관 정보를 놓칠 위험이 있다. CD 전략은 모든 채널을 하나의 통합된 엔티티로 보고, 임베딩 단계에서의 융합(예: 1D/2D Conv)이나 명시적 상관 모듈(예: iTransformer, TSMixer) 등을 통해 전역적인 상관관계를 포착한다. 그러나 채널 수가 많아질 경우 연산 비용이 급증하고, 잡음 채널에 의해 오버피팅될 가능성이 있다. CP 전략은 CI와 CD의 중간 지점으로, 고정 혹은 동적 부분 채널을 설정해 선택적 상관관계를 모델링한다. 고정 부분 채널 방식은 MTGNN처럼 K-정규 그래프를 이용해 일부 채널만 연결하고 나머지는 독립적으로 처리한다. 동적 부분 채널 방식은 DUET, CCM 등에서 채널 유사도를 실시간으로 학습해 마스크 행렬을 생성하거나 클러스터링을 수행함으로써 상황에 맞는 연결 구조를 동적으로 재구성한다. 메커니즘 관점에서는 Transformer 기반의 Naive Attention, Router Attention, Frequency Attention, Mask Attention 등 네 가지 세부 메커니즘을 제시한다. 특히 Router Attention은 대규모 채널 환경에서 O(N²) 복잡도를 O(N) 수준으로 낮추는 실용적인 설계이며, Frequency Attention은 주파수 도메인에서 상관관계를 포착함으로써 시간 도메인보다 더 강건한 특징을 추출한다. MLP 기반 모델은 다층 퍼셉트론을 활용해 채널 간 전역 상관을 효율적으로 학습하고, GNN 기반 모델은 그래프 구조를 명시적으로 도입해 지역적 및 전역적 관계를 동시에 모델링한다. 특성 관점에서는 비대칭성, 지연성, 극성, 그룹화, 동적성, 다중 스케일 등 여섯 가지 속성을 도입해 각 모델이 어떤 추가적인 정보를 활용하는지 체계적으로 정리한다. 예를 들어, 비대칭성은 채널 간 영향력이 비대칭적일 때 이를 반영하는 메커니즘을 의미하고, 다중 스케일은 서로 다른 시간 해상도의 패턴을 동시에 학습하는 능력을 말한다. 이러한 다차원 분류 체계는 연구자가 특정 도메인에 맞는 채널 전략을 선택하거나 새로운 전략을 설계할 때 명확한 가이드라인을 제공한다. 마지막으로 논문은 현재 한계점(예: 채널 수 급증 시 효율성, 잡음 채널 처리, 실시간 적응성 부족)과 함께 메타러닝, 자기지도 학습, 하이브리드 모델 등 미래 연구 방향을 제시한다. 전체적으로 이 연구는 다변량 시계열 분야에서 채널 전략을 중심으로 한 체계적 메타분석을 제공함으로써, 향후 모델 설계와 응용에 중요한 이정표가 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기