멀티모달 대형언어모델을 위한 감성지능 벤치마크 EmoBench‑M

초록

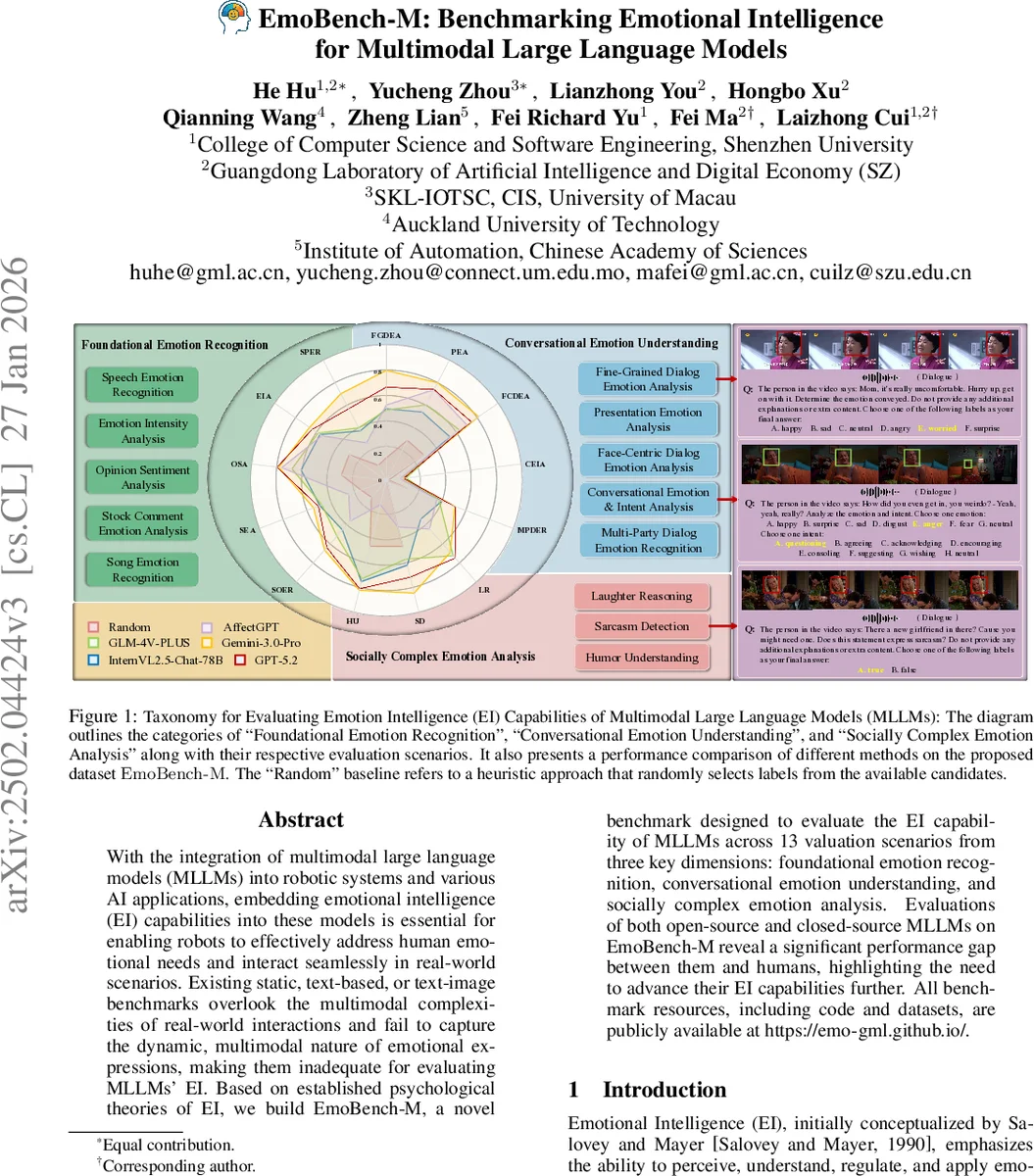

EmoBench‑M은 심리학 기반 EI 이론을 토대로 13개의 멀티모달 시나리오(영상·음성·텍스트)를 설계해, 기본 감정 인식, 대화 감정 이해, 사회적 복합 감정 분석이라는 3단계 차원에서 멀티모달 LLM의 감성지능을 평가한다. 공개된 실험 결과, 최신 오픈·클로즈드 소스 모델들은 인간 수준에 크게 미치지 못함을 보여, 향후 감성지능 강화 연구의 필요성을 강조한다.

상세 분석

EmoBench‑M은 기존 텍스트‑이미지 기반 감성 벤치마크가 갖는 한계를 명확히 지적한다. 실제 로봇·AI 시스템은 영상·음성·텍스트가 동시에 존재하는 동적 환경에서 인간의 감정을 파악해야 하므로, 정적인 정답 라벨만으로는 충분히 평가할 수 없다. 논문은 Salovey‑Mayer EI 모델과 Ekman의 기본 감정 이론을 근간으로, ‘기초 감정 인식’, ‘대화 감정 이해’, ‘사회적 복합 감정 분석’이라는 3계층 구조를 제안한다. 각 계층은 13개의 구체적 태스크로 세분화되며, 예를 들어 Song Emotion Recognition, Speech Emotion Recognition, Opinion Sentiment Analysis 등은 영상·음성 신호에서 기본 감정을 추출하도록 설계되었다. 대화 차원에서는 Fine‑Grained Dialog Emotion Analysis, Face‑Centric Dialog Emotion Analysis, Multi‑Party Dialog Emotion Recognition 등 다중 화자·다중 모달 정보를 통합해 감정 변화를 추적한다. 마지막 사회적 복합 차원은 Humor Understanding, Sarcasm Detection, Laughter Reasoning 등 문화·맥락 의존적 감정을 요구한다.

데이터 전처리에서는 다중 리뷰어 합의를 통한 라벨 검증과 클래스 불균형 완화를 위해 최대 500개 샘플을 유지하도록 다운샘플링한다. 이는 라벨 신뢰성을 높이고, 모델이 소수 감정 클래스에 과소 학습되는 것을 방지한다. 평가 메트릭은 대부분 정확도(ACC)이며, LLM 기반 생성 태스크는 Qwen2.5‑72B‑Instruct를 평가자 모델로 활용한다.

실험에서는 오픈소스 Qwen2‑Audio, MiniCPM‑V, InternVL2.5, Video‑LLaMA2 등과 클로즈드 소스 GLM‑4V, Gemini 등을 0‑shot 설정으로 테스트했다. 결과는 모든 모델이 인간 평균(≈90% 이상)보다 현저히 낮은 점수를 기록했으며, 특히 사회적 복합 감정 영역에서 30% 이하의 정확도를 보였다. 모델 규모와 파라미터 수가 증가해도 성능 향상이 제한적이며, 멀티모달 정합성 및 고차원 감정 추론 능력이 여전히 부족함을 시사한다.

이 논문은 멀티모달 LLM의 감성지능을 체계적으로 측정할 수 있는 최초의 벤치마크를 제공함으로써, 향후 감정 인식·이해·생성 모델 개발에 명확한 목표와 평가 기준을 제시한다. 또한, 인간‑로봇 상호작용, 감정 기반 서비스, 정서 치료 등 실용 분야에서 감성지능이 핵심 요소가 될 것을 전망한다.

댓글 및 학술 토론

Loading comments...

의견 남기기