에지용 고속 비주얼 대형 언어 모델 AuroraEdge V2B

초록

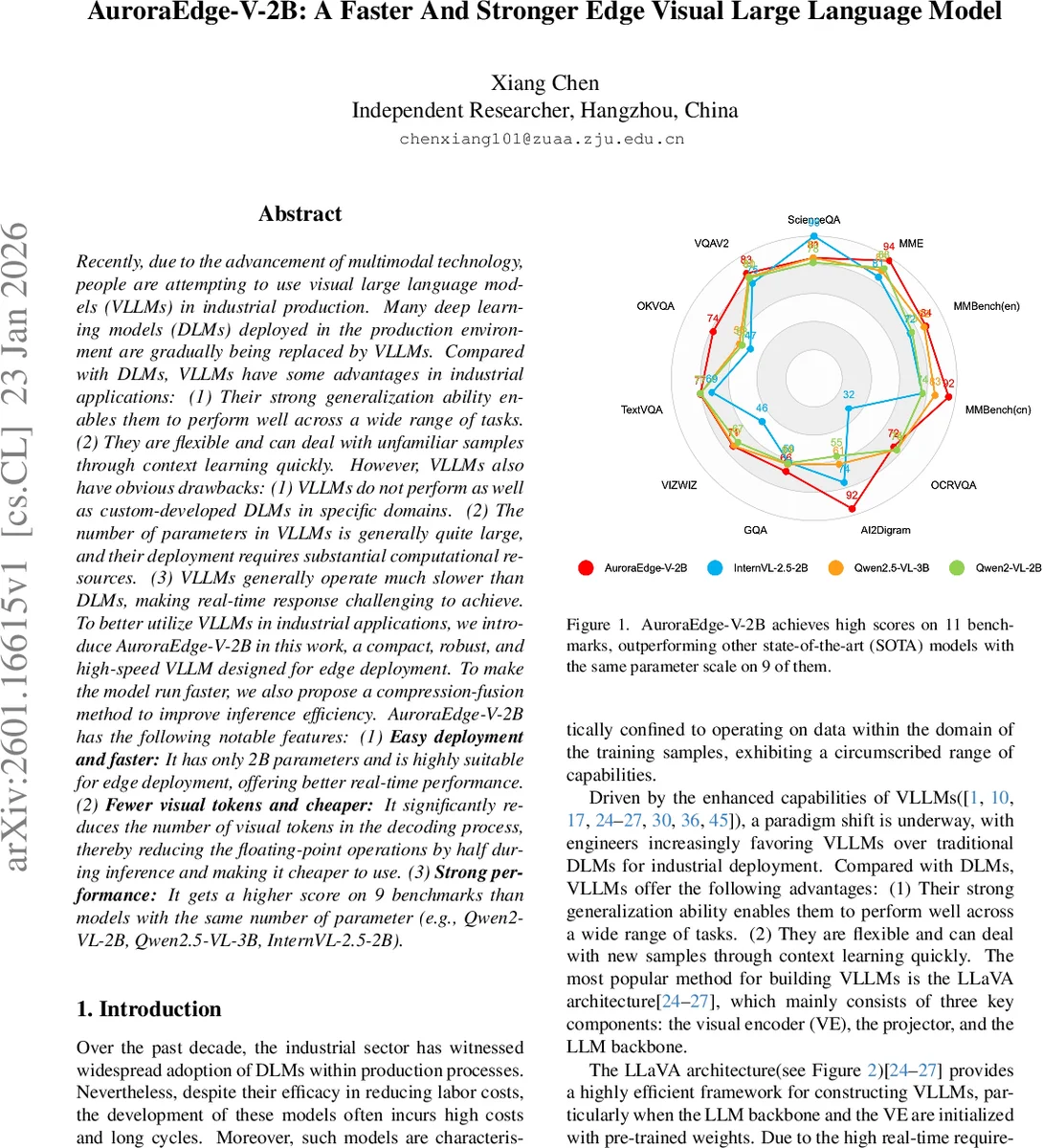

AuroraEdge‑V‑2B는 2 억 파라미터 규모의 경량 비주얼 대형 언어 모델(VLLM)로, 토큰 압축‑퓨전 기법을 통해 시각 토큰 수를 ¼ 수준으로 줄이고, 시각‑텍스트 융합 모듈로 손실을 보완한다. 이를 통해 기존 동등 파라미터 모델보다 3배 빠른 추론 속도와 9개 벤치마크에서 우수한 정확도를 달성한다.

상세 분석

본 논문은 산업 현장에서 실시간 요구를 만족시키기 위해 VLLM을 경량화하고 고속화하는 두 가지 핵심 아이디어를 제시한다. 첫 번째는 “Token Compressor”이다. 기존 LLaVA‑1.5와 같은 모델은 CLIP‑ViT‑L/336px를 사용해 이미지당 576개의 시각 토큰을 생성한다. AuroraEdge‑V‑2B는 SigLIP‑2‑so400m‑patch16‑naflex를 기반으로 최대 256개의 토큰을 추출하고, 이를 MLP 기반 압축기로 64개로 축소한다. 압축 과정에서 Conv2d와 MaxPool2d도 실험했지만, MLP가 가장 빠른 수렴 속도와 최고 성능을 보였다. 두 번째는 “Fusion Module”이다. 압축으로 인한 시각 정보 손실을 보완하기 위해 텍스트 토큰에 시각 정보를 주입한다. 세 가지 융합 방식을 비교했을 때, Cross‑Attention과 단일 레이어 디코더를 결합한 “Combined” 방식이 가장 높은 정확도를 기록했다. 이 구조는 시각 토큰을 직접 디코더에 입력하는 대신, 텍스트 토큰에 시각적 컨텍스트를 더해 LLM이 동일한 토큰 수로 복합 정보를 처리하도록 만든다.

모델 아키텍처는 LLaVA 프레임워크를 그대로 유지하면서, 동적 해상도 프로세서를 제거하고 위 두 모듈을 삽입했다. 백본으로는 Qwen2.5‑1.5B를 사용해 파라미터를 2 억 수준으로 제한했으며, 시각 인코더와 프로젝트터는 사전 학습된 가중치를 그대로 활용한다. 학습은 세 단계로 진행된다. ① Vision‑Only 단계에서는 이미지‑캡션 데이터를 이용해 프로젝트터·압축기·퓨전 모듈만 미세조정하고, VE와 LLM은 고정한다. ② LLM‑Fine‑Tuning 단계에서는 VQA 데이터를 사용해 LLM과 연결부를 전체 업데이트한다(단, VE 고정). ③ Vision‑Text Joint 단계에서는 모든 파라미터를 풀‑파인튜닝한다. 이러한 단계적 학습은 시각‑텍스트 정렬을 빠르게 달성하고, 최종 모델이 다양한 멀티모달 태스크에서 강인함을 보이게 한다.

성능 평가에서는 9개의 대표 벤치마크(예: VQAv2, COCO‑Caption, OCR‑VQA 등)에서 Qwen2‑VL‑2B, Qwen2.5‑VL‑3B, InternVL‑2.5‑2B와 비교했을 때 평균 2~3%p 상승한 점수를 기록했다. 특히 FLOPs 측면에서 시각 토큰 수를 절반으로 감소시켜 추론당 부동소수점 연산량을 50% 절감했으며, 실제 측정된 추론 지연 시간은 동등 파라미터 모델 대비 약 3배 가량 빠르다. 이는 에지 디바이스(예: ARM‑based SoC, 모바일 GPU)에서 실시간 응답성을 확보하는 데 큰 의미가 있다.

한계점으로는 압축 비율을 더 높이면 시각 정보 손실이 급격히 증가해 성능이 급락한다는 점, 그리고 현재 실험은 주로 이미지‑텍스트 쌍과 VQA에 국한돼 있어 복합 멀티모달(비디오, 3D 포인트클라우드 등) 확장성은 검증되지 않았다는 점을 들 수 있다. 향후 연구에서는 압축‑퓨전 파이프라인을 다중 단계로 계층화하거나, 지식 증류와 양자화 기법을 결합해 더욱 경량화된 모델을 탐색할 여지가 있다.

요약하면, AuroraEdge‑V‑2B는 토큰 압축과 시각‑텍스트 융합이라는 두 축을 통해 파라미터는 최소화하면서도 고속 추론과 경쟁력 있는 정확도를 동시에 달성한 최초의 에지‑친화형 VLLM이다.

댓글 및 학술 토론

Loading comments...

의견 남기기