지식 충돌 상황에서 대형 언어 모델의 다단계 추론 한계 탐색

초록

**

본 논문은 최신 LLM에 최신 사실을 인‑컨텍스트 혹은 파라미터 편집으로 주입했을 때, 모델 내부에 존재하는 오래된 지식과 충돌하는 경우가 발생한다는 점에 주목한다. 이러한 충돌이 다단계 추론 과정에서 어떻게 전파되는지를 평가하기 위해, 위키·코드·수학 세 분야에 걸친 현실적인 다중 충돌 데이터를 포함한 새로운 벤치마크 TRACK을 제안한다. 실험 결과, 업데이트된 사실을 제공해도 성능이 오히려 감소하고, 제공된 사실이 많을수록 악화되는 현상이 관찰된다. 원인은 새로운 지식의 통합 실패와, 통합이 이루어졌더라도 추론 과정 자체가 불완전하기 때문이다.

**

상세 분석

**

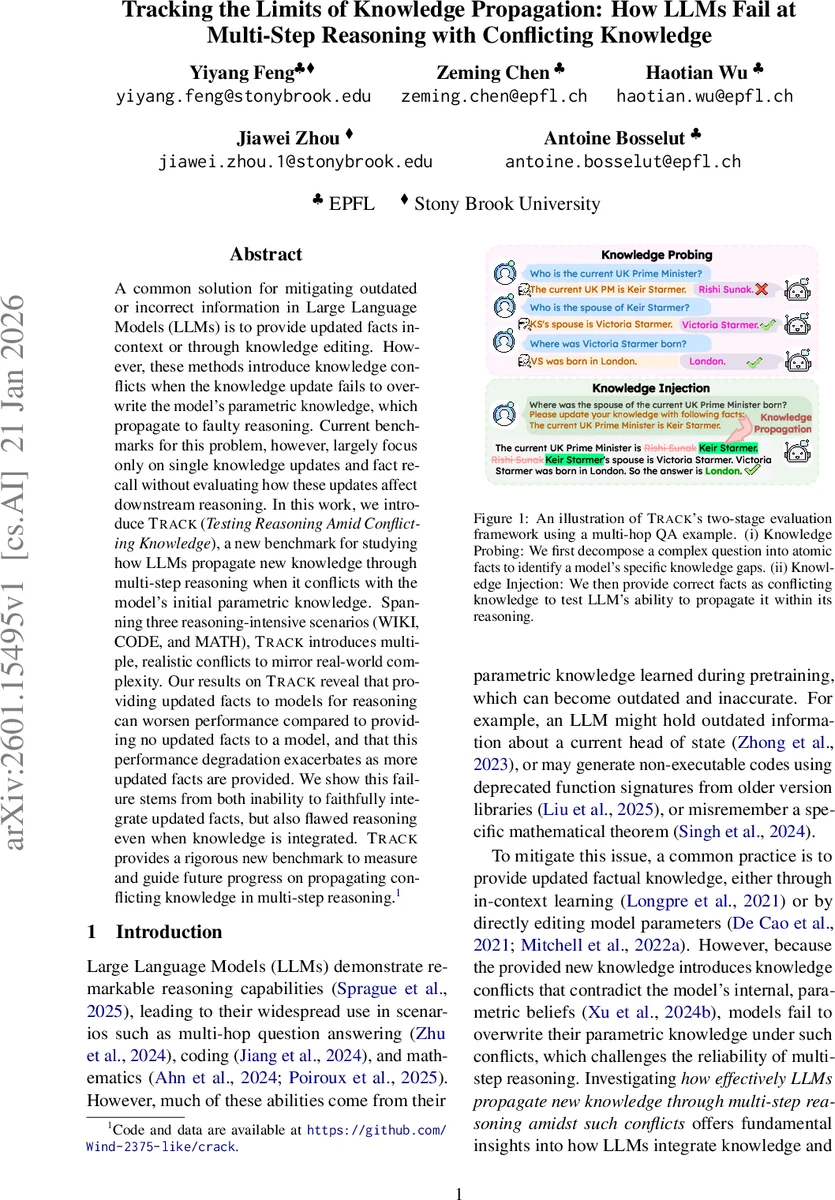

TRACK은 “지식 탐색 → 지식 주입 → 다단계 추론”이라는 두 단계 평가 프레임워크를 채택한다. 첫 단계인 Knowledge Probing에서는 복합 질문을 원자적 사실 집합 K₍q₎ 으로 분해하고, 각 사실에 대해 모델이 올바르게 답변하는지를 검사한다. 여기서 모델이 틀리거나 모호하게 답한 사실을 Knowledge Gap K_g 로 정의한다. 두 번째 단계인 Knowledge Injection에서는 K_g 에 해당하는 최신 사실을 컨텍스트에 삽입해(open‑book) 모델이 최종 답변과 추론 과정을 생성하도록 한다. 동일 질문에 대해 내부 지식만 사용하는(closed‑book) 설정과 비교함으로써, 새로운 사실이 실제로 추론에 활용되는지를 정량화한다.

핵심 메트릭은 세 가지이다. Answer Pass(AP)는 최종 답이 정답인지 여부를 측정하고, Full Knowledge Entailment(FKE)는 모델의 추론 단계가 K_q 에 포함된 모든 원자적 사실을 정확히 언급했는지를 평가한다. 마지막으로 Holistic Pass(HP)는 AP와 FKE를 동시에 만족하는지를 확인하는 가장 엄격한 기준이다. 이러한 메트릭은 단순 사실 회수와는 달리, 새로운 지식이 중간 단계에서 올바르게 사용되는지를 직접 검증한다는 점에서 기존 벤치마크와 차별된다.

세 가지 도메인별 데이터는 다음과 같다. WIKI는 최신 위키피디아 문서를 기반으로, 최근에 변동된 인물·기관·통계 정보를 포함한다. CODE는 외부 API 호출이나 라이브러리 함수 시그니처가 업데이트된 상황을 재현해, 코드 생성 시 최신 사양을 반영해야 하는 과제를 제공한다. MATH는 최신 수학 정리·공식이 개정된 사례를 이용해, 다단계 수식 변형 및 증명 과정을 요구한다. 각 도메인 모두 다중 충돌을 포함하도록 설계돼, 하나의 질문에 여러 최신 사실이 동시에 필요하도록 구성했다.

실험에서는 GPT‑4, Claude, Llama‑2, Mistral 등 다양한 규모와 공개·폐쇄형 모델을 평가했다. 결과는 일관되게 나타났는데, (1) open‑book 설정이 closed‑book 대비 평균 AP 상승폭이 미미하거나 오히려 감소했고, (2) 제공된 최신 사실 수가 늘어날수록 FKE와 HP 점수가 급격히 하락했다. 오류 분석을 통해 두 가지 주요 원인을 도출했다. 첫째, 모델이 최신 사실을 “덮어쓰기(overwrite)”하지 못하고 기존 파라미터 지식과 병합하면서 모순된 추론을 만든다. 둘째, 최신 사실이 올바르게 통합되었더라도, 이후 단계에서 논리적 연결 고리를 형성하지 못하거나, 코드·수학 영역에서는 최신 API 사용법을 정확히 적용하지 못하는 등 추론 자체가 결함을 보인다.

또한, Knowledge Aggregation Scope(KAS) 파라미터를 변형해 여러 질문에 걸친 최신 사실을 동시에 제공했을 때, 모델이 정보 선택 및 필터링에 실패해 전반적인 성능이 더욱 저하되는 현상을 확인했다. 이는 실제 서비스 환경에서 다수의 업데이트가 동시에 발생할 경우, LLM이 효율적으로 최신 정보를 활용하기 어려움을 시사한다.

결론적으로, 현재 LLM은 단순 사실 삽입보다는 지식 충돌 상황에서의 추론 연쇄 전체를 재구성하는 능력이 부족하다. TRACK은 이러한 한계를 정량화하고, 향후 연구가 “지식 통합 + 논리적 추론”을 동시에 다루는 방법론을 개발하도록 유도한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기