로보브레인 2.5: 깊이와 시간으로 강화된 물리적 지능

초록

**

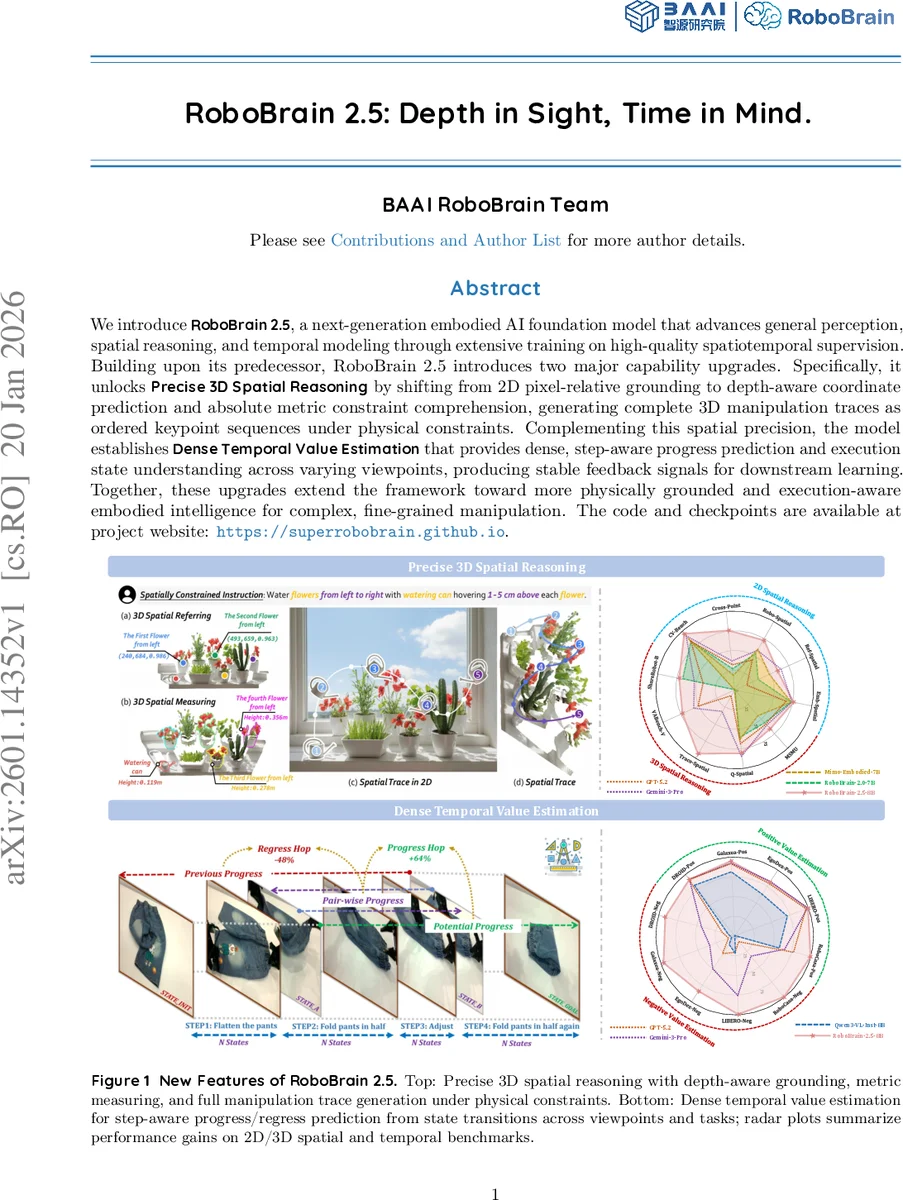

로보브레인 2.5는 2D 픽셀 기반 추론을 넘어 깊이 인식 좌표 예측과 절대 거리 제약을 이해하는 정밀 3D 공간 추론을 도입하고, 다중 시점에서 단계별 진행 상황을 밀도 있게 추정하는 Dense Temporal Value Estimation을 추가한다. 이를 통해 물리적 제약을 만족하는 3D 조작 궤적 생성과 실시간 진행 피드백을 제공, 복잡한 장기 조작 작업에서 제로샷 로봇 제어와 강화학습에 필요한 고품질 신호를 공급한다.

**

상세 분석

**

본 논문은 기존 로보브레인 2.0이 보여준 언어·시각·행동 통합 능력을 기반으로 두 가지 핵심 업그레이드를 제시한다. 첫 번째는 “Precise 3D Spatial Reasoning”으로, 2D 픽셀 좌표에 머물던 grounding을 (u, v, d) 형태의 깊이‑인식 좌표로 전환한다. 카메라 내재 파라미터를 이용해 이미지 평면 좌표와 절대 깊이를 직접 예측함으로써, 모델은 물리적 거리·간극을 밀리미터 수준으로 측정하고, 충돌을 방지하는 3D 키포인트 시퀀스를 생성한다. 이 과정은 3가지 하위 기술—3D 객체 지시(Referring), 절대 거리·높이 측정(Measuring), 그리고 연속적인 궤적(trace) 생성—으로 구성되며, 각각은 독립적인 데이터셋(2D 레퍼런스, 깊이 지도, 키포인트 트레이스)으로부터 교차 학습된다. 특히 (u, v, d) 표현을 채택함으로써 기존 3D 좌표(x, y, z) 학습에서 발생하던 카메라 기하학 학습 부담을 크게 경감하고, 2D 데이터와의 호환성을 유지해 데이터 효율성을 높였다.

두 번째 업그레이드는 “Dense Temporal Value Estimation”이다. 기존의 오픈‑루프 행동 생성은 성공/실패 라벨만을 사용해 중간 진행 상황을 전혀 관찰하지 못했으나, 본 연구는 hop‑wise 진행 라벨링을 도입해 각 프레임 사이의 상대 진행도를 정규화한다. 진행값 H(sₚ, s_q)는 현재 상태와 목표 상태 사이의 남은 거리(전진) 혹은 이미 진행된 거리(퇴보)를 기준으로 ‑11 구간에 매핑되며, 이를 통해 누적 오차가 01 범위를 벗어나지 않도록 보장한다. 또한, 세 가지 시점—전방, 후방, 증분—에서 예측을 수행해 다중 시점 융합을 적용, 시야 가림이나 조명 변화에 강인한 진행 추정이 가능하도록 설계되었다. 이러한 밀도 높은 가치 추정은 강화학습에서 고충실도 보상 신호로 활용될 수 있어, 장기 조작 과제에서 실시간 오류 복구와 정책 미세조정이 가능해진다.

훈련 파이프라인은 두 단계로 나뉜다. Stage 1에서는 대규모 멀티모달 MLLM 데이터와 고품질 3D/시간 라벨을 동시에 학습해 기본적인 시공간 이해를 형성하고, Stage 2에서는 위에서 정의한 3D 추론과 Temporal Value 모듈을 특화된 데이터(예: 로봇 팔 시뮬레이션, 실제 로봇 캡처)로 미세조정한다. 인프라 측면에서는 하이브리드 파라렐리즘, 동적 메모리 할당, 그리고 GPU·TPU·FPGA 등 이종 가속기 간 협업을 통해 8 B 파라미터 모델을 효율적으로 학습·추론한다.

평가에서는 2D/3D 공간 추론 벤치마크와 새로운 Temporal Value 테스트셋에서 기존 RoboBrain 2.0 및 경쟁 모델(GPT‑5.2, Gemini‑3 등)을 크게 앞섰다. 특히 3D 조작 트레이스 생성에서 평균 위치 오차가 2 mm 이하로 감소했으며, 단계별 진행 예측 정확도는 92 % 이상을 기록했다. 실세계 로봇 실험에서도 복잡한 물체 배치와 시점 변동이 있는 환경에서 제로샷 성공률이 85 %에 달해, 시뮬레이션‑투‑실제 전이 문제를 크게 완화했다.

전반적으로 로보브레인 2.5는 “Depth in Sight, Time in Mind”이라는 두 축을 통해 물리적 제약 인식과 실행 피드백을 동시에 제공함으로써, 일반화 가능한 로봇 지능의 새로운 패러다임을 제시한다. 향후 연구에서는 멀티‑모달 대화형 인터페이스와 장기 기억 메커니즘을 결합해, 복합 작업 시나리오에서의 계획·재계획·자기수정 능력을 확장할 계획이다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기