파라미터 효율 미세조정이 환각 탐지를 크게 향상시킨다

초록

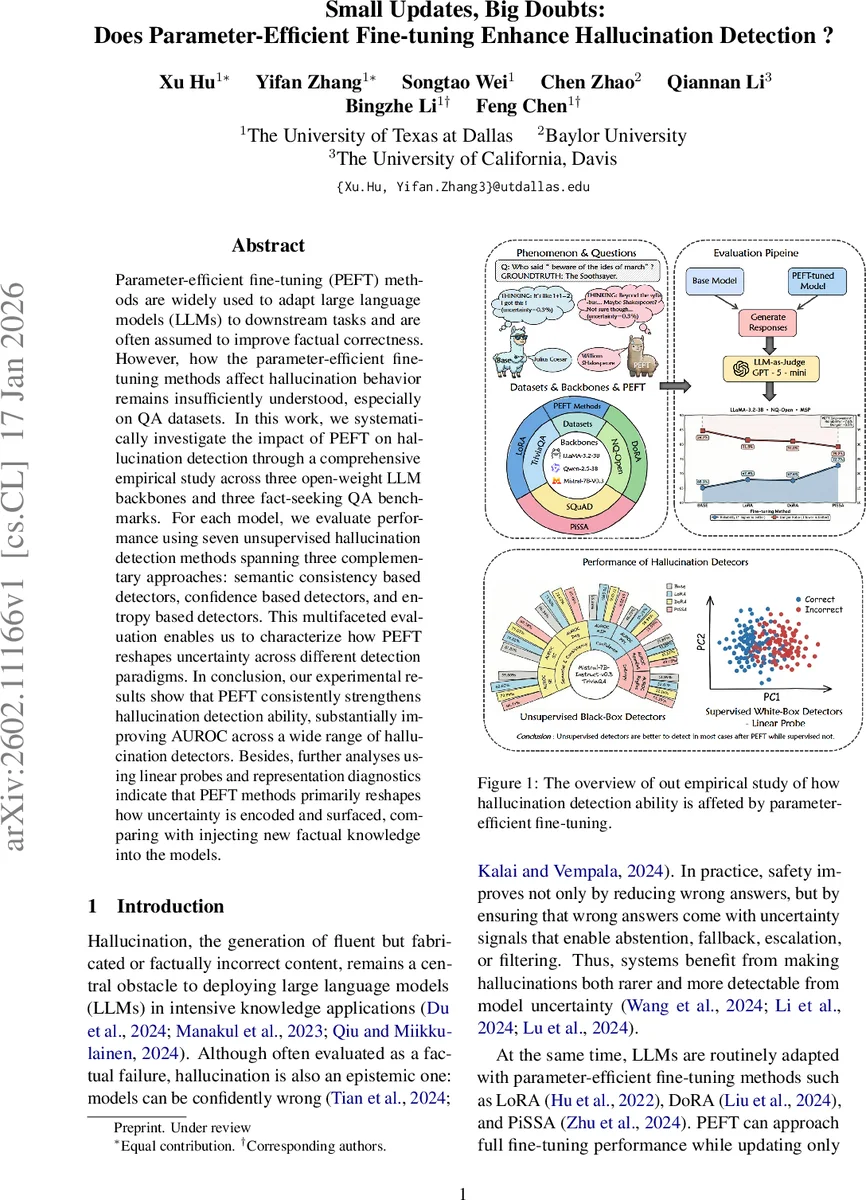

본 연구는 LoRA, DoRA, PiSSA와 같은 파라미터 효율 미세조정(PEFT) 기법이 LLaMA, Mistral, Qwen 등 세 가지 오픈‑소스 대형 언어 모델에 적용될 때, 사실‑추구 QA 벤치마크에서의 정확도는 크게 변하지 않지만, 다양한 비지도 환각 탐지기들의 AUROC를 현저히 개선한다는 점을 실증한다. 특히 의미 일관성 기반 및 신뢰도 기반 탐지기가 크게 향상되는 반면, 엔트로피 기반 탐지는 일관된 개선을 보이지 않는다. 내부 표현 분석에서는 PEFT가 불확실성 신호를 재구성하지만, 선형 탐지기의 선형 분리성을 일관되게 높이지는 못함을 확인한다.

상세 분석

본 논문은 파라미터 효율 미세조정(PEFT)이 대형 언어 모델(LLM)의 환각 탐지 능력에 미치는 영향을 체계적으로 평가한다. 실험은 세 가지 오픈‑weight 백본(LLaMA‑3.2‑3B‑Instruct, Mistral‑7B‑Instruct‑v0.3, Qwen2.5‑3B‑Instruct)과 세 개의 사실‑추구 QA 데이터셋(NQ‑Open, TriviaQA, SQuAD) 조합을 기반으로 한다. 각 백본에 대해 LoRA, DoRA, PiSSA 세 가지 PEFT 방식을 적용하고, 동일한 학습 설정(랭크 32, α 64, 학습률 2e‑5 등)으로 1 epoch fine‑tuning을 수행한다.

평가 지표는 두 축으로 나뉜다. 첫 번째는 전통적인 QA 정확도이며, 두 번째는 비지도 환각 탐지기의 AUROC(및 SQuAD에 한해 AUPR)이다. 탐지기는 의미 일관성 기반(Semantic Entropy, SelfCheckGPT, Degree of Uncertainty), 신뢰도 기반(Maximum Sequence Probability, Perplexity) 및 엔트로피 기반(Predictive Entropy, Mean Token Entropy) 총 7가지로 구성한다. 또한, 숨겨진 표현을 이용한 선형 탐지기(white‑box probe)를 별도 학습해 내부 불확실성 변화를 정량화한다.

주요 결과는 다음과 같다. ① 정확도 향상은 미미하다. PEFT 적용 시 전체 평균 0.1%~3% 수준의 정확도 상승에 그쳤으며, 이는 환각 자체를 크게 감소시키지는 못한다는 것을 의미한다. ② AUROC는 일관되게 상승한다. 특히 의미 일관성 기반 탐지기와 신뢰도 기반 탐지기의 평균 AUROC 상승폭은 4%~8%에 달했으며, 일부 조합에서는 12% 이상 개선되었다. 이는 PEFT가 모델의 과신(confidence) 영역을 완화하고, 정답에 대한 불확실성 신호를 더 명확히 만든다는 가설을 뒷받침한다. ③ 엔트로피 기반 탐지기는 개선 폭이 작거나 경우에 따라 감소한다. 토큰‑레벨 엔트로피는 어휘 선택·문장 구조와 같은 요인에 민감해, 사실 정확도와 직접적인 상관관계가 낮다. ④ 선형 탐지기의 성능은 일관되지 않다. PEFT가 숨겨진 표현을 재구성해 불확실성 패턴을 바꾸지만, 이를 선형 분리 가능한 형태로 만들지는 못한다. 일부 경우에서는 오히려 선형 탐지기의 AUROC가 감소한다. ⑤ 표현 분석(PCA, linear probe) 결과, PEFT는 주로 attention projection 계층(q_proj, k_proj, v_proj, o_proj)에 변화를 주어, 불확실성 신호가 더 구조화된 형태로 표출되도록 한다. 이는 “에피스테믹 레귤러라이저(epistemic regularizer)”라는 새로운 해석을 가능하게 한다.

이러한 결과는 PEFT가 단순히 지식 주입을 넘어, 모델이 자신이 모르는 경우를 더 명확히 인식하도록 만드는 역할을 함을 시사한다. 따라서 실제 서비스에서는 PEFT와 함께 의미 일관성·신뢰도 기반 탐지기를 활용하면, 모델의 오류를 사전에 차단하거나 인간 검증으로 전환하는 시스템 설계가 보다 효율적일 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기