다중 컨텍스트 대비 디코딩으로 지식‑증강 비주얼 QA 강화

초록

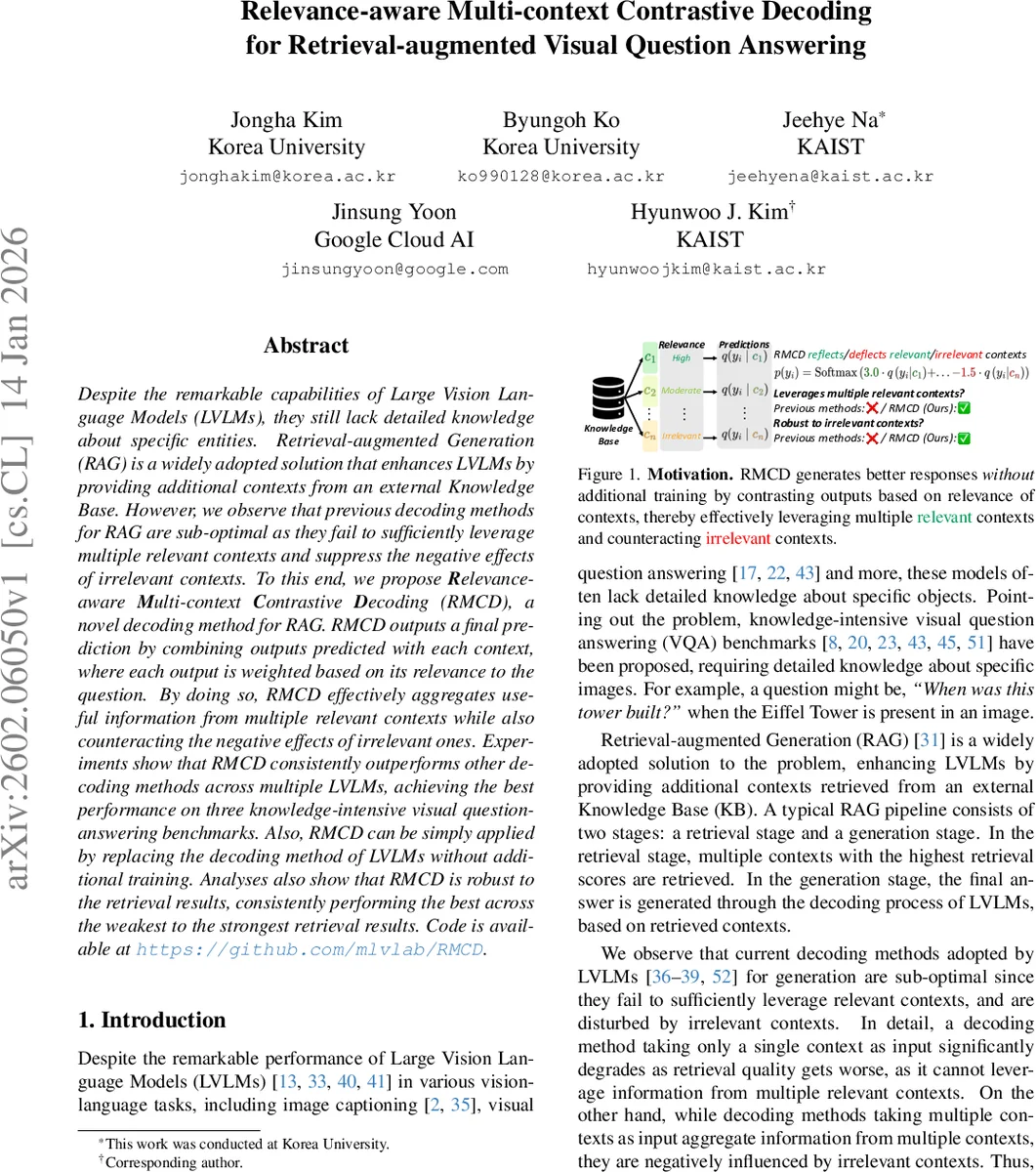

본 논문은 대형 비전‑언어 모델(LVLM)에 외부 지식베이스를 활용하는 Retrieval‑augmented Generation(RAG)에서, 여러 검색 컨텍스트의 관련성을 고려해 출력 토큰을 가중합하는 새로운 디코딩 기법인 Relevance‑aware Multi‑context Contrastive Decoding(RMCD)을 제안한다. RMCD는 각 컨텍스트의 검색 점수를 기반으로 가중치를 부여해 유관 컨텍스트는 강화하고, 무관 컨텍스트는 억제한다. 실험 결과 InfoSeek, Encyclopedic VQA, OK‑VQA 등 3개 지식‑집중 VQA 벤치마크와 7개 LVLM에 대해 기존 디코딩 방식보다 일관되게 높은 정확도를 달성했으며, 검색 품질 변화에도 강인함을 보였다.

상세 분석

RMCD는 기존 RAG 파이프라인을 크게 변형하지 않으며, “디코딩 단계”에만 적용되는 훈련‑프리 방법이다. 기본 아이디어는 각 검색된 텍스트 컨텍스트 cⱼ에 대해 LVLM이 생성한 로짓 q(yᵢ|cⱼ)를 별도로 얻고, 컨텍스트의 검색 점수 s_cⱼ를 소프트맥스 온도 τ₁으로 정규화해 상대 점수 w_cⱼ를 만든 뒤, 이를 또 다른 온도 τ₂를 적용한 스케일링 함수로 가중치 αⱼ로 변환한다. αⱼ는 양수일 수도, 음수일 수도 있어, 높은 점수의 컨텍스트는 “반사(reflection)” 효과로 로짓을 강화하고, 낮은 점수의 컨텍스트는 “편향(deflection)” 효과로 로짓을 감소시킨다. 최종 로짓은 모든 αⱼ·q(yᵢ|cⱼ)의 가중합이며, 마지막에 소프트맥스를 적용해 토큰 확률을 얻는다.

핵심 기술적 기여는 다음과 같다.

- 다중 컨텍스트 대비: 기존 단일‑컨텍스트 대비(SCD)와 달리, RMCD는 n개의 컨텍스트를 동시에 활용한다. 이는 검색 품질이 낮아도 일부 유관 컨텍스트가 남아 있으면 성능 저하를 방지한다.

- 검색 점수 기반 가중치: 검색 점수를 그대로 사용하지 않고 온도 파라미터 τ₁, τ₂를 도입해 가중치 스케일을 조정한다. 이는 점수 차이가 작을 때도 의미 있는 차별을 가능하게 하며, 음수 가중치를 허용해 무관 컨텍스트를 역으로 작용하게 만든다.

- 훈련‑프리 구현: LVLM 자체 파라미터를 변경하거나 추가 학습이 필요 없으며, 기존 디코더 호출을 여러 번 수행하고 가중합만 하면 된다. 따라서 적용 비용이 낮고, 다양한 모델(예: BLIP‑2, InstructBLIP, LLaVA 등)에 바로 적용 가능하다.

- 시간 복잡도 최적화: 컨텍스트 수 n이 동일할 때, RMCD는 가장 간단한 가중합 연산만 수행하므로, 기존 다중‑컨텍스트 어텐션 기반 방법보다 약 33 % 빠른 처리량을 보인다.

실험에서는 3개의 지식‑집중 VQA 데이터셋(InfoSeek, Encyclopedic VQA, OK‑VQA)과 7개의 최신 LVLM을 대상으로 비교했다. RMCD는 평균 1.8~3.2 % 포인트의 정확도 향상을 기록했으며, 특히 검색 점수가 낮은 상황(예: Top‑1 Recall < 30 %)에서도 다른 디코딩 방식보다 크게 앞섰다. 또한 “oracle” 컨텍스트(정답을 포함한 최적 컨텍스트)만을 제공했을 때도 RMCD는 가장 높은 성능을 유지해, 가중치 설계가 과도한 편향 없이 정보를 최대한 활용함을 입증한다.

한계점으로는 컨텍스트 수가 매우 많아질 경우(수십 개 이상) 각 컨텍스트에 대해 별도 로짓을 계산해야 하므로 GPU 메모리와 연산량이 급증한다는 점이다. 논문에서는 n = 5~10 정도가 실용적이라고 제시했으며, 향후 효율적인 샘플링 혹은 하위‑컨텍스트 압축 기법이 필요할 것으로 보인다.

댓글 및 학술 토론

Loading comments...

의견 남기기