STEM 분야 이중축 진단 프레임워크

초록

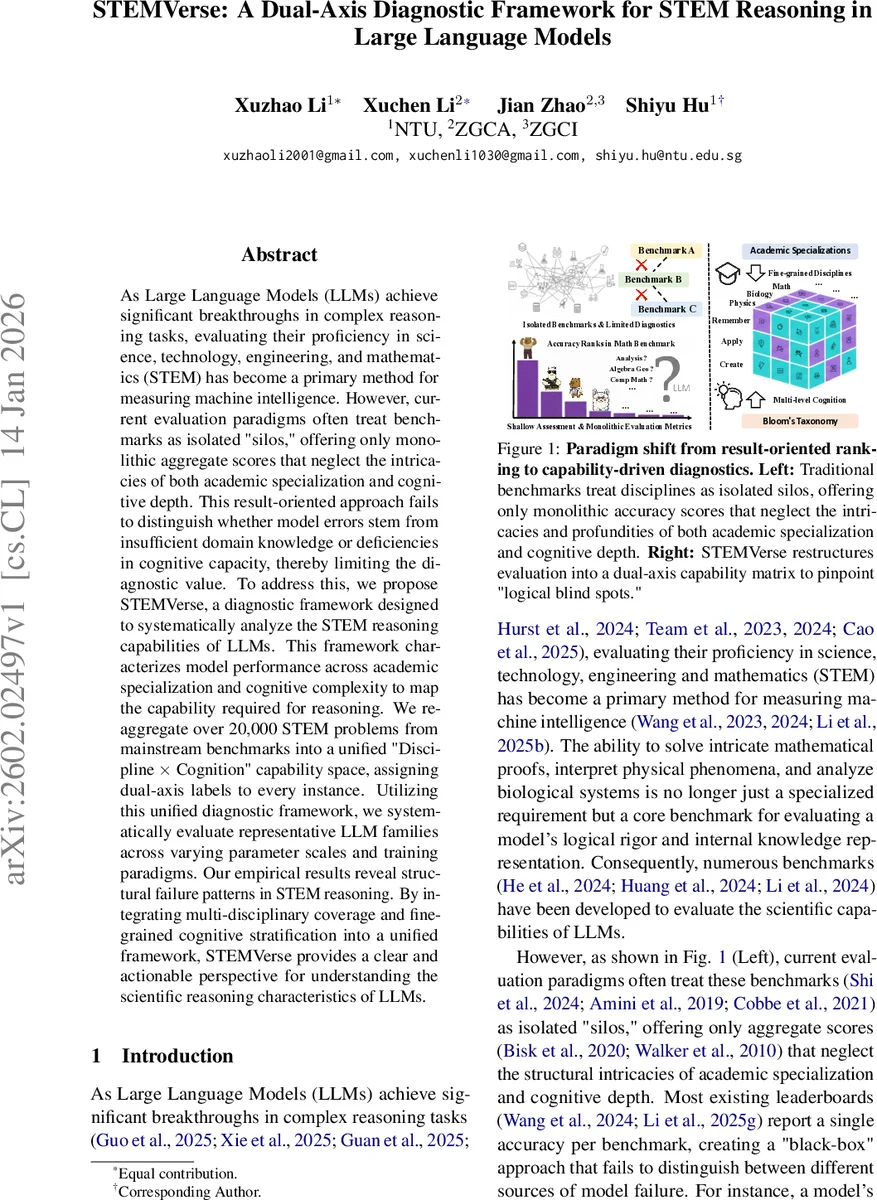

STEMVerse는 2만 개 이상의 STEM 문제를 학문 분야와 Bloom 인지 단계라는 두 축으로 재구성해 LLM의 과학·수학·공학·기술 추론 능력을 정밀하게 진단한다. 기존 벤치마크가 제공하던 단일 정확도 점수 대신, 학문별·인지복잡도별 성능 지도를 제시해 지식 결핍과 추론 한계의 원인을 구분한다. 실험 결과, 파라미터 규모가 커져도 고차원 인지 단계에서의 성능 정체와 상징·논리 처리의 급격한 붕괴가 나타나는 구조적 오류 패턴을 발견했다.

상세 분석

STEMVerse는 기존 STEM 벤치마크가 서로 독립된 “사일로”로 존재하고, 모델 성능을 하나의 집계 점수로만 보고한다는 한계를 극복하기 위해 설계되었다. 논문은 먼저 20,000여 개의 문제를 수학, 물리, 화학, 생물 네 개의 핵심 분야와 각각 27개의 세부 전공으로 세분화하였다. 이때 각 문제는 원래의 라벨을 제거하고, 학문 축(전공)과 인지 축(블룸의 6단계: 기억, 이해, 적용, 분석, 평가, 창조)이라는 두 차원에 매핑된다. 이렇게 구성된 “학문 × 인지” 격자는 각 셀에 해당하는 문제 수와 난이도를 균형 있게 배분함으로써, 특정 전공·고차 인지 조합에서 모델이 얼마나 잘 작동하는지를 시각화한다.

실험에서는 Qwen·Llama 계열의 오픈소스 모델들을 3B에서 14B 파라미터까지 다양한 규모와 사전학습·미세조정 전략으로 평가하였다. 결과는 다음과 같은 구조적 패턴을 드러냈다. 첫째, 파라미터가 증가함에 따라 저차 인지 단계(기억·이해)에서는 정확도가 꾸준히 상승하지만, 고차 단계(분석·평가·창조)에서는 비선형적인 정체 혹은 급격한 성능 저하가 관찰되었다. 이는 “논리‑기호 붕괴(logic‑symbolic collapse)” 현상으로, 모델이 공식이나 절차적 지식은 잘 적용하지만, 복합적인 추론이나 새로운 개념을 창조하는 과정에서 약점이 드러난다. 둘째, 전공별 성능 차이가 뚜렷했다. 예를 들어, 물리·양자역학·전산화학 등 고도로 수식화된 분야에서는 중간 규모 모델조차도 60% 이하의 정확도를 보였으며, 반면 생물학·생태학 등 서술형·개념 중심 분야에서는 상대적으로 높은 점수를 기록했다. 이는 현재 LLM이 “기호‑수치 처리”에 강점이 있지만, “다중 모달·도메인 통합 추론”에는 한계가 있음을 시사한다.

또한, 인지 축과 학문 축을 교차 분석한 결과, 특정 전공에서 고차 인지 단계로 넘어갈 때 성능 급락이 반복되는 “전공‑인지 병목”을 식별했다. 예를 들어, 미분방정식(수학)이나 열역학(물리) 문제에서 ‘분석’ 단계까지는 70% 이상이지만, ‘평가’ 단계에서는 30% 이하로 급감한다. 이러한 병목은 모델이 문제의 구조적 복잡성을 파악하지 못하고, 단순히 표면적인 패턴을 적용하는 데 머무르는 것으로 해석된다.

논문은 이러한 진단 결과를 바탕으로, 향후 모델 설계와 데이터 구축 시 “고차 인지 능력 강화”와 “전공별 심층 지식 통합”을 목표로 해야 한다고 주장한다. 특히, 체계적인 멀티스텝 체인‑오브‑생각(Chain‑of‑Thought) 프롬프트와 도메인‑특화 교정 데이터, 그리고 기호‑논리 연산자를 명시적으로 학습시키는 방법이 제안된다.

요약하면, STEMVerse는 학문·인지 이중축을 통해 LLM의 STEM 추론 능력을 정밀하게 분해·시각화함으로써, 기존 평가가 놓쳤던 지식·추론 구분, 전공별·인지 단계별 병목을 명확히 드러낸다. 이는 연구자와 개발자가 모델의 약점을 정확히 파악하고, 목표 지향적인 개선 전략을 수립하는 데 실질적인 도구가 될 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기