프라이버시 보호 이중탑 그래프 검색으로 LLM 기억 증강

초록

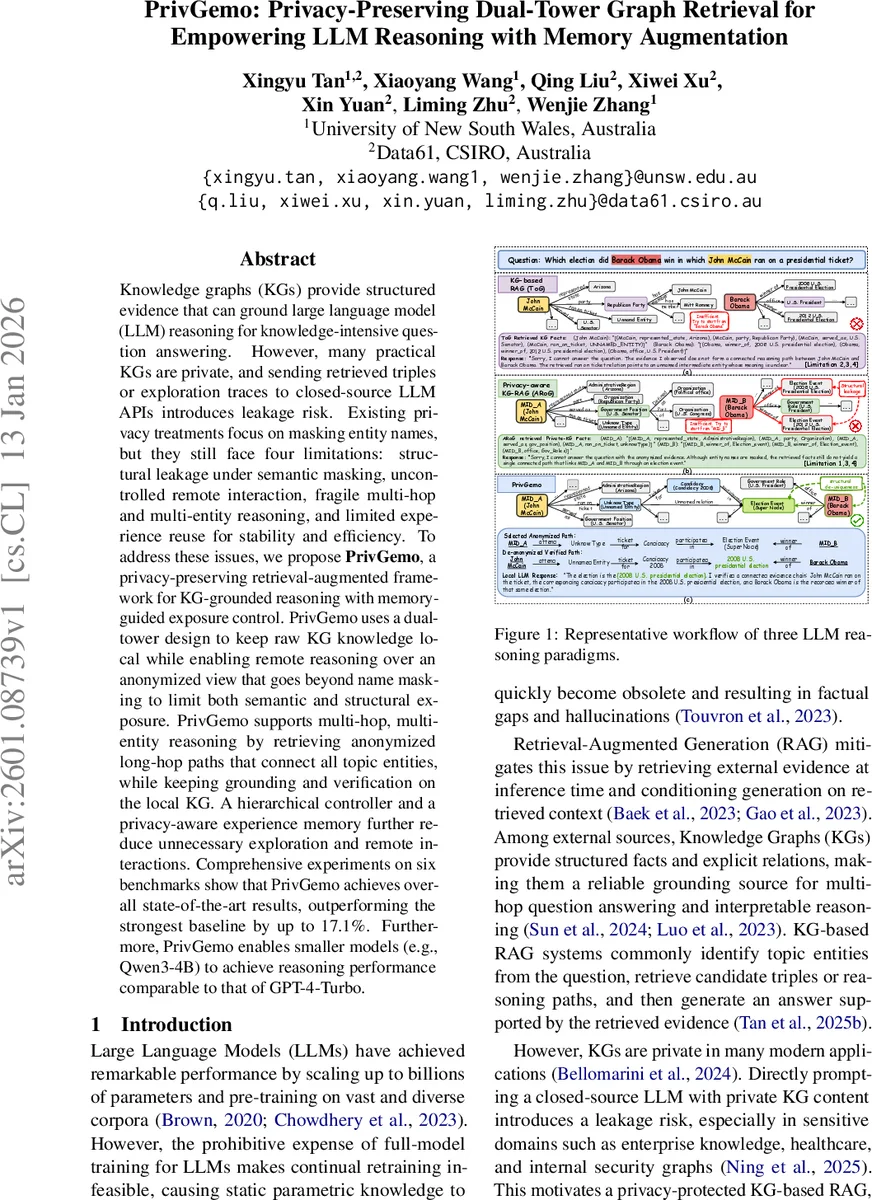

PrivGemo는 개인용 지식 그래프를 외부 LLM에 노출하지 않으면서도 다중 홉·다중 엔터티 추론을 가능하게 하는 이중탑 구조와 경험 기반 메모리를 결합한 프라이버시‑보호 RAG 프레임워크이다. 의미·구조 마스킹, 계층형 컨트롤러, 장기 경험 메모리를 통해 구조적 누수와 과도한 원격 호출을 억제하고, 작은 모델도 GPT‑4‑Turbo 수준의 성능을 달성한다.

상세 분석

PrivGemo는 기존 프라이버시‑보호 KG‑RAG가 직면한 네 가지 한계를 체계적으로 해결한다. 첫째, 의미 마스킹만으로는 고유한 연결 패턴이 남아 구조적 누수가 발생한다는 점을 인식하고, 세션별 HMAC 기반 식별자를 이용해 엔터티·관계 이름을 완전히 익명화한 뒤, 토큰 수준에서 스키마 타입을 부여해 최소한의 제약만 남긴다. 둘째, 원격 LLM과의 상호작용을 ‘Brain’과 ‘Hand’ 두 모델로 분리하고, 탐색·선택 단계는 전적으로 Brain이 수행하도록 함으로써 원격 호출 횟수를 엄격히 제어한다. 셋째, 다중 홉·다중 엔터티 추론을 위해 ‘인디케이터‑가이드 롱홉 경로 검색’ 메커니즘을 도입한다. 이는 질문에 등장하는 모든 토픽 엔터티를 동시에 포함하는 연결 경로를 사전에 탐색하도록 강제하여, 기존의 홉‑별 그리디 확장에서 발생하던 경로 단절 문제를 방지한다. 넷째, 경험 메모리를 프라이버시‑인식 형태로 구축한다. 각 세션에서 익명화된 질문·인디케이터 임베딩을 저장하고, 유사도 기반 검색을 통해 과거 성공 사례를 재활용함으로써 불필요한 탐색과 원격 호출을 크게 감소시킨다. 구조적 탈중복을 위해 ‘구조‑레벨 탈유일성’ 절차를 적용해, 동일한 서브그래프가 반복 노출되는 것을 방지한다. 실험에서는 6개 베엔치마크(KGQA, 멀티홉 QA 등)에서 전체 평균 17.1%p 상승을 기록했으며, 특히 Qwen‑3‑4B와 같은 소형 모델이 GPT‑4‑Turbo와 동등한 정확도를 보였다. 이는 프라이버시 보호와 성능 사이의 전통적인 트레이드오프를 깨뜨린 중요한 결과다. 또한, PrivGemo는 플러그‑앤‑플레이 설계로 다양한 LLM·KG에 손쉽게 적용 가능하고, 새로운 지식이 KG에 추가될 때마다 즉시 활용할 수 있어 파인튜닝 비용을 회피한다. 전체적으로 PrivGemo는 의미·구조 마스킹, 계층형 컨트롤, 경험 기반 메모리라는 세 축을 결합해 프라이버시‑보호 KG‑RAG의 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기