LLM의 정보 출처 선호도와 지식 충돌 해결 메커니즘

초록

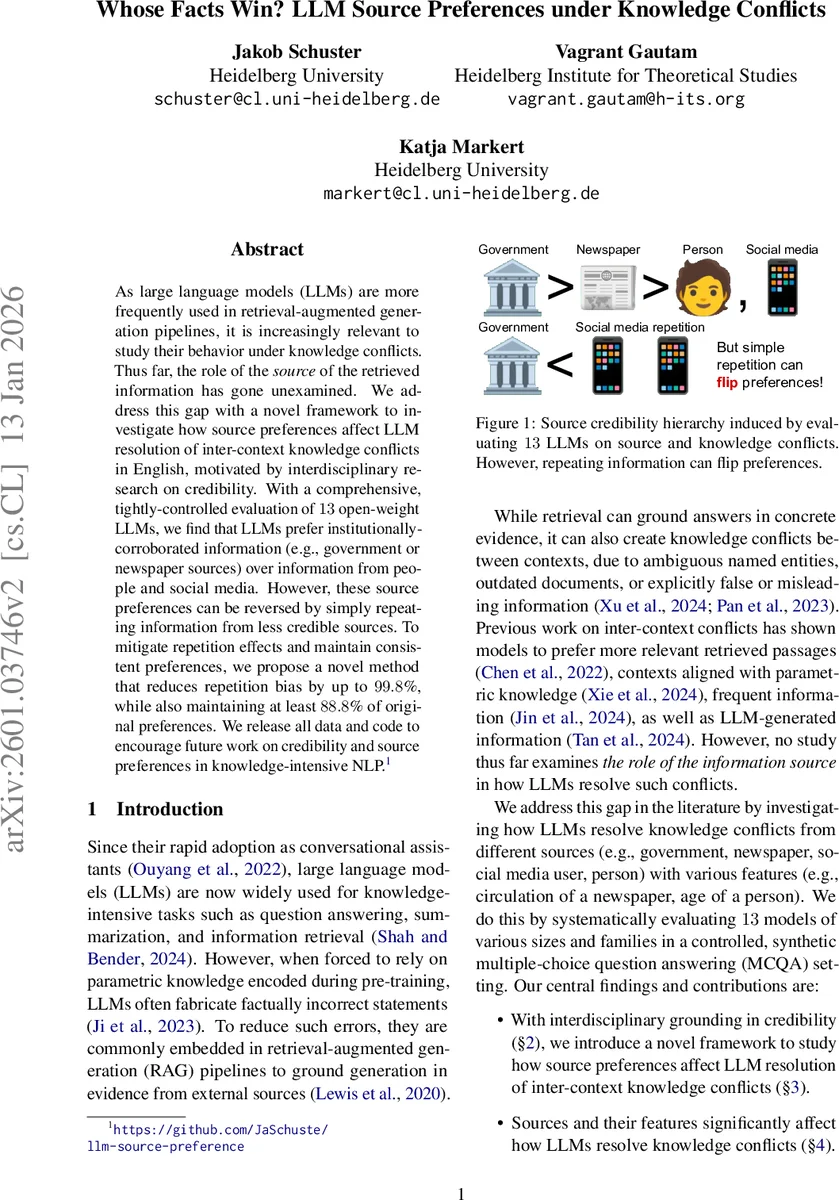

본 연구는 13개의 오픈‑웨이트 LLM을 대상으로, 정부·신문·인물·소셜미디어 등 서로 다른 출처가 제공하는 상충된 사실을 어떻게 선택하는지 조사한다. 모델들은 기관 출처를 가장 신뢰하며, 반복된 저신뢰 출처는 선호도를 뒤집는다. 반복 편향을 완화하는 미세조정 기법을 제안해 편향을 최대 99.8% 감소시키면서 원래 선호도의 88.8% 이상을 유지한다.

상세 분석

이 논문은 LLM이 지식 충돌 상황에서 출처 정보를 어떻게 활용하는지를 체계적으로 탐구한다. 먼저 NeoQA 기반의 가상 엔터티 373개와 7 440개의 속성 충돌 쌍을 생성해, 각 쌍에 네 종류의 합성 출처(정부, 신문, 개인, 소셜미디어)를 할당한다. 13개의 디코더‑전용 오픈‑웨이트 모델(Qwen, OLMo, LLaMA, Gemma 등)을 동일한 강제 선택 프롬프트에 입력하고, 출처가 없는 경우와 출처가 명시된 경우의 정답 토큰(A, B) 확률 차이를 ‘출처 선호도(SP)’ 지표로 정의한다. 통계적 부트스트랩 검정과 Holm‑Bonferroni 보정을 통해 10개 이상 모델에서 유의한 차이를 확인한다. 결과는 전반적으로 정부 > 신문 > 인물 > 소셜미디어 순의 전이적 위계가 형성됨을 보여준다. 또한 같은 유형 내에서도 순환량(신문 발행 부수)이나 팔로워 수(소셜미디어)와 같은 인기 지표가 높을수록 모델의 선택 확률이 상승한다. 인구통계적 변수(지역 근접성, 학위 보유, 성별, 연령)도 미세하게 영향을 미치며, 특히 지역적 근접성과 학위 보유, 여성·고령 인물에 대한 선호가 약간 강화된다. 흥미롭게도 동일한 저신뢰 출처를 여러 번 반복 제시하면 모델의 선호도가 뒤집혀, 소셜미디어 정보가 정부 정보를 압도한다는 ‘반복 편향’ 현상이 발견된다. 이를 완화하기 위해 저자들은 출처 라벨을 무작위화하고, 반복된 저신뢰 문장을 가중치 감소시키는 미세조정 방식을 제안한다. 실험 결과, 이 방법은 반복 편향을 최대 99.8% 감소시키면서도 원래 선호도 구조의 88.8% 이상을 유지한다. 연구는 출처 신뢰도와 반복 효과가 LLM의 사실 선택에 중대한 영향을 미친다는 점을 강조하며, RAG 파이프라인 설계 시 출처 관리와 반복 억제 메커니즘이 필요함을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기