다중 에이전트 토론의 비밀: 신뢰와 다양성의 힘

초록

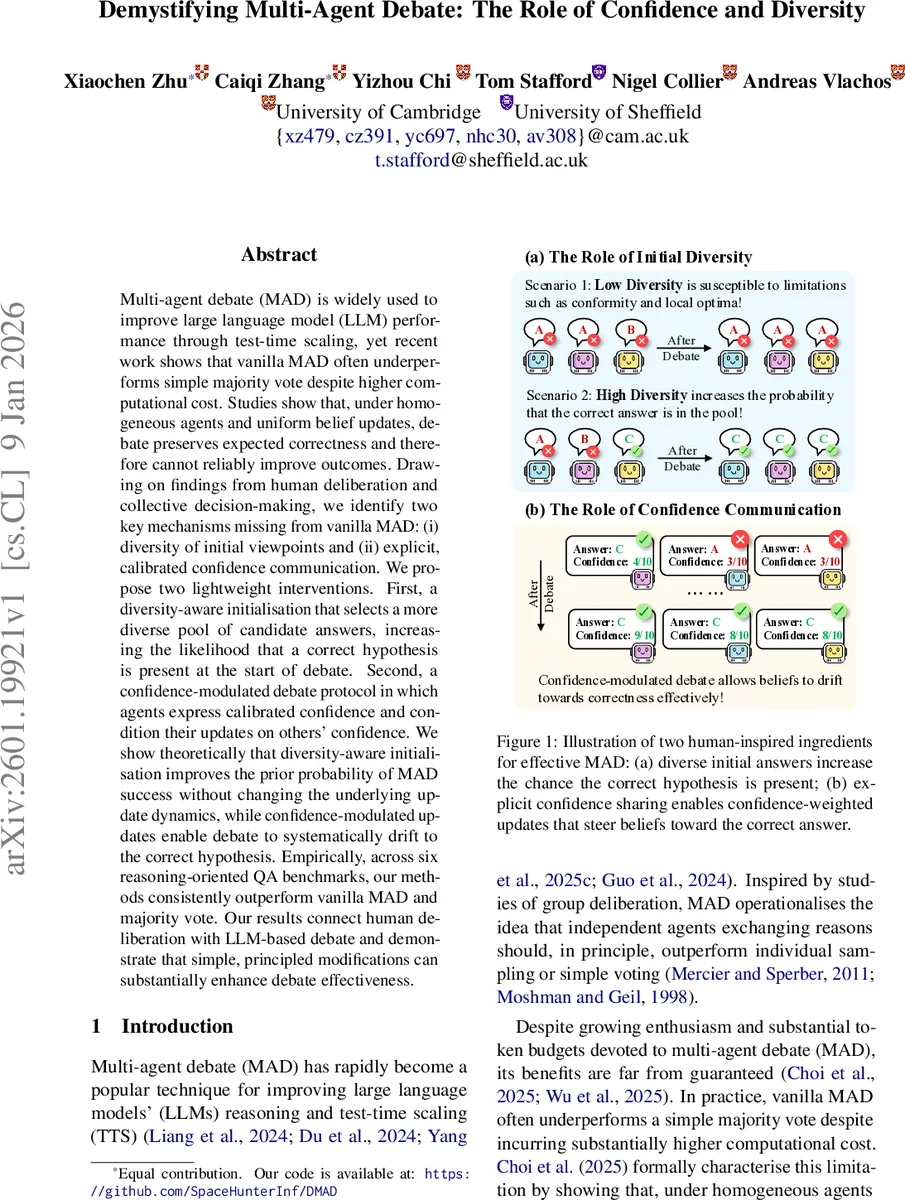

본 논문은 기존 다중 에이전트 토론(MAD)이 동질적인 에이전트와 무가중치 업데이트 때문에 기대 정확도가 향상되지 않는 한계를 지적한다. 인간 집단 토론에서 중요한 두 요소인 초기 답변 다양성과 신뢰(Confidence) 공유를 도입한 두 가지 경량화 기법—다양성 인식 초기화와 신뢰 조절 토론 프로토콜—을 제안한다. 이론적으로 다양성 인식 초기화는 올바른 가설이 초기 풀에 포함될 확률을 높이고, 신뢰 조절 업데이트는 마팅게일 제한을 깨뜨려 정확도로 수렴하도록 만든다. 실험 결과, 6개의 추론 중심 QA 벤치마크에서 제안 방법이 기존 MAD와 다수결을 모두 능가한다는 것을 확인하였다.

상세 분석

이 논문은 최근 LLM 기반 다중 에이전트 토론(MAD)이 높은 계산 비용에도 불구하고 종종 단순 다수결보다 성능이 낮다는 실증적 문제를 이론적으로 설명한다. Choi et al. (2025)의 결과를 인용해, 동질적인 에이전트와 균일한 믿음 업데이트가 적용될 경우 토론 과정은 기대 정확도가 변하지 않는 마팅게일(martingale) 특성을 보이며, 이는 토론이 정답으로 수렴할 확률을 사전에 정해진 수준으로 제한한다는 점을 강조한다. 이러한 한계를 극복하기 위해 인간 집단 토론 연구에서 도출된 두 핵심 메커니즘을 도입한다. 첫 번째는 초기 답변 풀의 다양성을 높이는 ‘다양성‑인식 초기화’이다. 이는 후보 답변을 N_cand > N 개 샘플링한 뒤, 서로 다른 답변 수를 최대화하는 탐욕적 선택을 통해 N개의 초기 에이전트를 구성한다. 이 과정은 추가 샘플링 비용이 들지만, 모델 학습이나 구조 변경 없이 정답이 초기 풀에 존재할 사전 확률을 상승시킨다. 두 번째는 ‘신뢰‑조절 토론’이다. 각 라운드에서 에이전트는 (답변, 신뢰점수) 쌍을 출력하고, 다른 에이전트의 신뢰 점수를 입력으로 받아 자신의 업데이트를 가중한다. 여기서 핵심은 신뢰 점수의 캘리브레이션이다. 저자들은 강화학습(RL) 기반의 보상 설계로, 정답일 경우 높은 점수, 오답일 경우 낮은 점수를 부여하도록 모델을 훈련시켜 과신(over‑confidence) 문제를 완화한다. 이론적으로는 신뢰 가중 업데이트가 마팅게일 성질을 깨뜨려, 믿음이 올바른 가설 쪽으로 편향되도록 증명한다. 실험에서는 GSM‑8K, MATH, ARC‑Easy 등 6개의 추론‑중심 QA 데이터셋을 사용해, ‘다양성‑인식 초기화 + 신뢰‑조절 토론’ 조합이 평균 2~4%p의 정확도 향상을 달성했으며, 특히 난이도가 높은 데이터에서 효과가 두드러졌다. 또한, 각 기법을 별도로 적용한 경우에도 기존 MAD보다 우수함을 보이며, 다수결 대비 일관된 이득을 확인한다. 논문은 인간 집단 토론 이론과 LLM 토론 메커니즘을 연결함으로써, 간단하지만 원칙에 기반한 수정이 실제 성능에 큰 영향을 미칠 수 있음을 입증한다. 다만, 신뢰 점수의 캘리브레이션 비용과 후보 풀을 크게 확장할 경우 테스트 시간 비용이 증가한다는 트레이드오프가 존재한다. 향후 연구에서는 비용 효율적인 다양성 추출 및 신뢰 추정 방법을 탐색하고, 비동질적인 에이전트 집합에서도 동일한 이론적 보장을 확장하는 것이 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기