MAGA 벤치 정렬 기반 기계 생성 텍스트 검증 데이터셋

초록

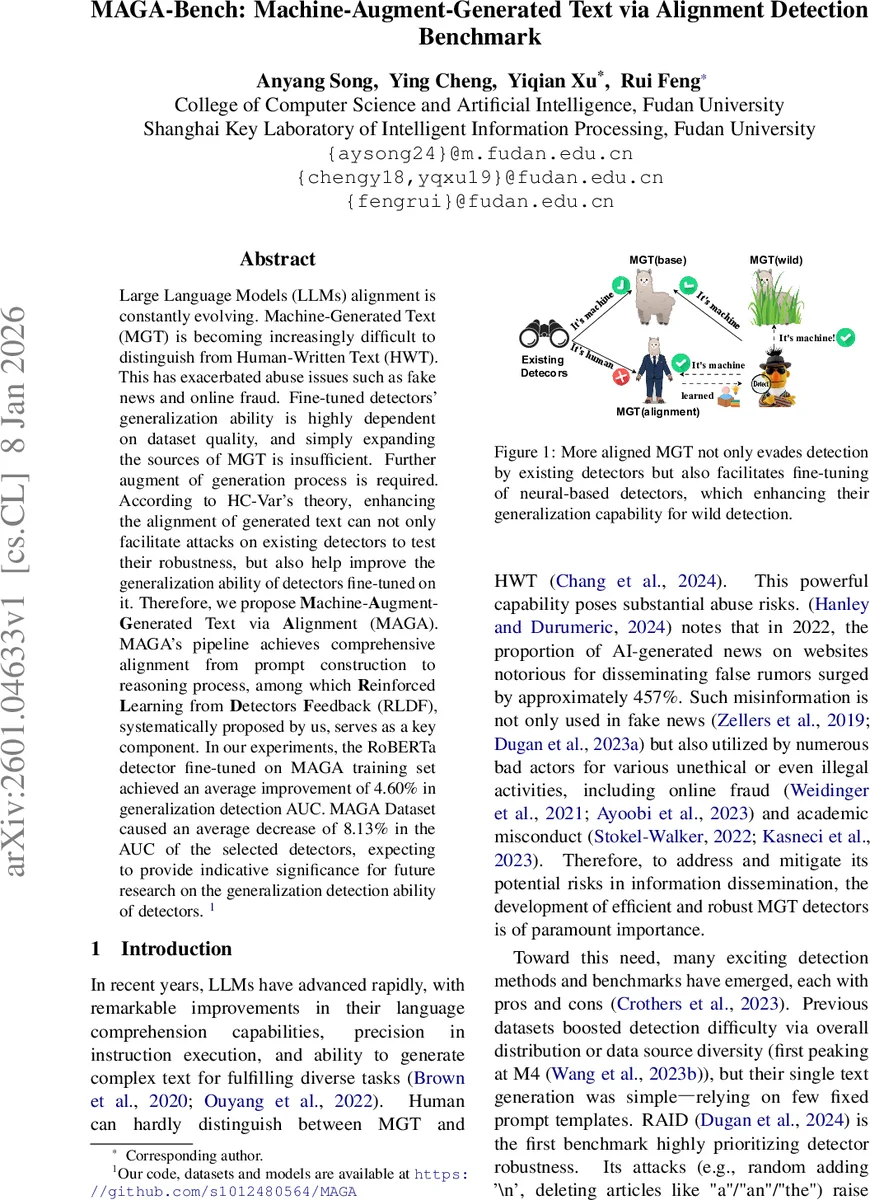

본 논문은 LLM이 생성한 텍스트의 인간‑기계 구분을 강화하기 위해 정렬(Alignment) 기법을 적용한 데이터셋 MAGA‑Bench를 제안한다. 역할극, BPO, Self‑Refine, 그리고 새롭게 설계한 RLDF(Detectors Feedback 강화 학습) 네 가지 정렬 방법을 파이프라인화하여 20개 도메인·12개 모델·다양한 디코딩 전략으로 936k 샘플을 구축하였다. 실험 결과, MAGA‑Bench로 미세조정한 RoBERTa 탐지기는 기존 데이터 대비 AUC가 평균 4.60% 상승했으며, 반대로 기존 탐지기들을 MAGA 데이터에 적용했을 때 평균 AUC가 8.13% 감소하는 등 공격·방어 양면에서 유의미한 효과를 보였다.

상세 분석

이 연구는 기계 생성 텍스트(MGT)와 인간 작성 텍스트(HWT)의 구분이 점점 어려워지는 현상에 대응하고자 ‘정렬(Alignment)’이라는 개념을 핵심으로 삼았다. 기존 탐지기들은 데이터 소스 다양성만 확대해도 성능 향상이 제한적이며, 단순히 더 많은 MGT를 수집하는 것만으로는 일반화 능력을 확보하기 어렵다. 저자들은 HC‑Var 이론을 인용해, MGT가 HWT와 더 유사한 특성을 가질수록 탐지기 학습에 유익한 ‘결정 경계’를 형성한다는 점을 강조한다.

MAGA‑Bench는 네 가지 정렬 기법을 계층적으로 결합한다. 첫 번째인 Role‑Playing은 시스템 역할을 명시적으로 지정해 프롬프트의 의도를 강화한다. 두 번째 BPO는 Prompt‑Optimization 모델을 활용해 원본 프롬프트에 정렬 정보를 추가한다. 세 번째 Self‑Refine는 LLM이 자체 피드백을 생성하고 이를 기반으로 출력을 재작성하도록 하여 내부 일관성을 높인다. 핵심인 RLDF는 기존 탐지기(주로 RoBERTa)를 보상 모델(Reward Model)로 사용해 강화학습(GRPO)으로 LLM을 미세조정한다. 여기서 RLDF‑CD와 RLDF‑CM은 각각 도메인 간, 모델 간 교차 보상을 도입해 과적합을 방지하고, 탐지기와 생성기 사이의 적대적 순환을 촉진한다.

데이터 구축 과정은 10개 주요 도메인(레딧, 위키피디아, 뉴스 등)에서 72k 인간 텍스트를 추출하고, 각 텍스트에 대해 12가지 LLM(예: GPT‑4o‑mini, Llama‑3.1, Gemini 등)으로 타이틀 기반 MGT를 생성한다. 기본 프롬프트(MGB)와 정렬 강화 프롬프트(MAGA)를 각각 936k 샘플 규모로 만든 뒤, 인간 텍스트와 1:1 매칭해 학습·검증 세트를 구성한다.

실험에서는 기존 탐지기 10종을 MAGA‑Bench와 기존 벤치마크(M4, RAID 등)에서 평가했다. 결과는 두드러졌다. 정렬된 MAGA 데이터로 미세조정한 RoBERTa는 평균 AUC가 4.60% 상승했으며, 특히 R‑B GPT2, R‑L GPT2, R‑B CGPT 등 주요 메트릭에서 큰 개선을 보였다. 반대로 동일 탐지기들을 MGB와 MAGA 데이터에 그대로 적용했을 때, 평균 AUC가 8.13% 감소했는데, 이는 MAGA가 기존 탐지기의 약점을 효과적으로 공격한다는 의미다. 또한, 다양한 디코딩 전략과 다국어(중국어) 지원을 포함해 실험 범위를 넓혔으며, 표 1·2·3을 통해 데이터 규모·도메인·모델 다양성에서 기존 벤치마크를 모두 능가함을 입증한다.

한계점으로는 RLDF 과정에서 탐지기 자체가 과적합될 위험이 존재한다는 점을 언급했으며, 이를 완화하기 위해 교차 보상(CD, CM)과 단일 라운드 피드백 방식을 채택했다. 또한, 인간 평가 없이 자동 메트릭에 의존한 부분이 있어 향후 인간 주관 평가와의 상관관계 검증이 필요하다.

전반적으로 이 논문은 ‘정렬’이라는 새로운 차원의 데이터 증강을 제시함으로써, MGT 탐지기의 일반화와 적대적 강인성을 동시에 향상시킬 수 있음을 실증하였다. 향후 연구는 RLDF의 다중 라운드 확장, 다양한 언어·문화적 특성 반영, 그리고 탐지기와 생성기의 공동 학습 프레임워크 구축으로 이어질 전망이다.

댓글 및 학술 토론

Loading comments...

의견 남기기