논문감사벤치 자동 피어리뷰를 위한 오류 탐지 벤치마크

초록

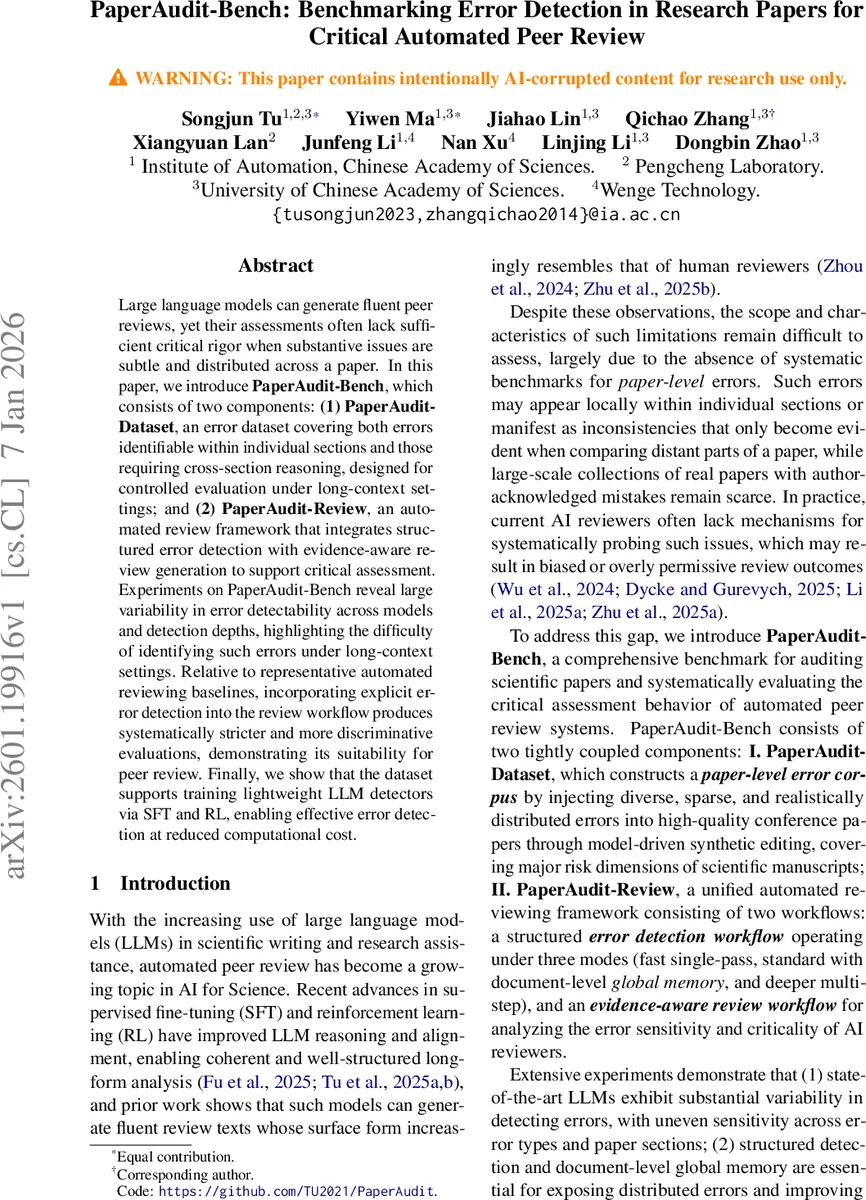

PaperAudit‑Bench는 논문 수준의 오류를 체계적으로 평가하기 위해 두 가지 핵심 요소를 제시한다. 첫째, 실제 학술 논문에 인위적으로 삽입한 10 ~ 20개의 희소하고 분산된 오류를 포함하는 PaperAudit‑Dataset을 구축해 장문 컨텍스트에서 오류 탐지 능력을 측정한다. 둘째, Fast·Standard·Deep 세 단계의 탐지 모드와 증거‑기반 리뷰 생성을 결합한 PaperAudit‑Review 프레임워크를 제안한다. 실험 결과 최신 LLM들의 오류 탐지 성능이 모델·섹션·오류 유형마다 크게 차이남을 확인했으며, 오류 탐지를 리뷰 파이프라인에 통합하면 보다 비판적이고 차별화된 평가를 얻을 수 있음을 보였다. 또한 경량 검출기를 SFT·RL로 학습시켜 비용 효율적인 오류 탐지도 가능함을 입증한다.

상세 분석

PaperAudit‑Bench는 자동화된 피어리뷰 시스템이 직면한 “미묘하고 분산된 논문 오류”라는 핵심 난제를 두 축으로 접근한다. 데이터 측면에서 저자들은 2025년 ICLR·ICML·NeurIPS 구두 논문 220편을 수집하고, 각 논문에 10 ~ 20개의 오류를 모델‑주도 방식으로 삽입한다. 오류는 (1) 실험 결과와 서술부 불일치, (2) 통계적 해석 오류, (3) 데이터·코드 재현성 결함, (4) 인용·관련 연구 누락, (5) 윤리·편향 문제, (6) 수식·표기 오류, (7) 논리적 비약, (8) 부정 행위(표절·데이터 위조) 등 여덟 가지 카테고리로 정의된다. 삽입 과정에서 LLM이 생성한 오류는 인간 검증을 거쳐 품질을 확보했으며, 오류 밀도는 10 K 토큰당 1 ~ 2개 수준으로 실제 리뷰 상황을 모사한다. 이처럼 장문(수만 토큰) 문서에 희소하게 배치된 오류는 전통적인 문단‑단위 평가 방식으로는 탐지하기 어렵다.

탐지·리뷰 프레임워크는 세 단계로 구성된다. Fast 모드는 전체 텍스트를 한 번에 스캔해 고수준의 명백한 오류를 빠르게 포착한다. 이때 섹션 구분이나 전역 메모리를 사용하지 않으므로 연산 비용이 최소화되지만, 교차‑섹션 일관성 오류는 놓치기 쉽다. Standard 모드는 논문을 섹션별로 분할하고, 각 섹션을 독립적으로 분석하되 전역 메모리(문서‑레벨 컨텍스트)를 공유한다. 이를 통해 섹션 내부의 세부 오류와 동시에 다른 섹션과의 연관성을 검증할 수 있다. Deep 모드는 계획‑기반 멀티‑에이전트 접근을 도입한다. 오류 유형별 전문 에이전트를 할당하고, 필요시 외부 증거(코드, 데이터셋)까지 검색해 검증한다. 이 모드는 인간 리뷰어의 “다단계 검증” 과정을 모방하지만, 계산 비용이 크게 증가한다.

실험에서는 GPT‑4, Claude‑2, LLaMA‑2‑70B 등 최신 LLM을 세 탐지 모드에 적용해 오류 탐지율(F1)과 검출 깊이(Precision@k)를 측정했다. 결과는 모델마다 큰 편차가 있음을 보여준다. 예를 들어, GPT‑4는 Fast 모드에서 전체 오류 45 %만 잡았지만, Deep 모드에서는 78 %까지 상승했다. 반면, Claude‑2는 전역 메모리 활용이 약해 Standard 모드에서만 60 % 수준에 머물렀다. 특히 교차‑섹션 오류(예: 초록과 실험 결과 불일치)는 Deep 모드에서만 의미 있게 탐지되었다. 이는 장문 컨텍스트와 계획‑기반 추론이 오류 탐지에 필수적임을 시사한다.

리뷰 통합 실험에서는 기존 자동 리뷰 베이스라인(Zhu et al., 2025b; DeepReview)과 비교했을 때, PaperAudit‑Review를 사용하면 리뷰 점수 평균이 0.6점 낮아졌으며, “비판성”과 “증거 기반” 항목에서 유의미한 개선을 보였다. 즉, 오류 탐지를 명시적으로 포함하면 모델이 과도하게 관대하게 평가하는 경향을 억제하고, 실제 논문 품질을 더 정확히 반영한다. 또한, 오류 탐지 모델을 경량화(3 B 파라미터)하고 SFT·RL로 미세조정하면, 원본 대형 모델 대비 4배 빠른 추론 속도와 5 % 이하의 성능 손실을 달성했다.

전체적으로 본 연구는 (1) 장문·희소 오류를 체계적으로 생성·평가하는 데이터베이스, (2) 탐지 깊이에 따라 비용·성능을 조절할 수 있는 다단계 프레임워크, (3) 오류 탐지를 리뷰 파이프라인에 통합함으로써 자동 피어리뷰의 비판적 수준을 실질적으로 끌어올릴 수 있음을 입증한다. 향후 연구는 실제 인간 리뷰어와의 협업, 오류 유형 확장, 그리고 멀티모달(표, 그래프, 코드) 증거 활용을 통해 더욱 정교한 자동 감사 시스템을 구축하는 방향으로 나아갈 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기