깊이감지 초기화와 그래디언트 각성: LION‑DG로 신경망 학습 가속화

초록

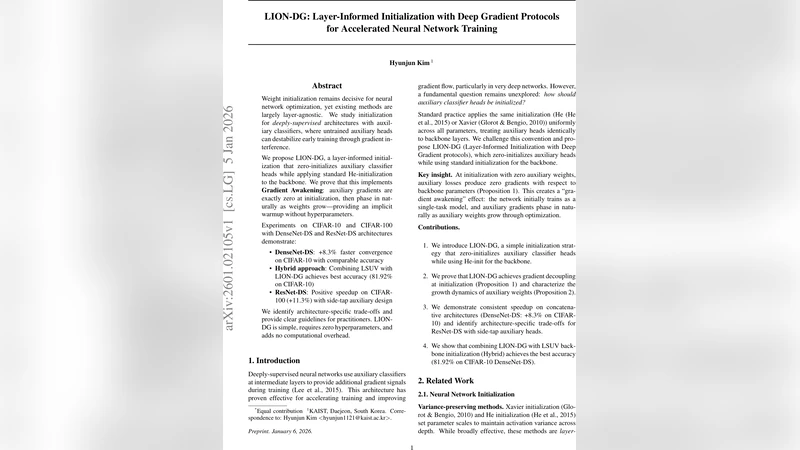

LION‑DG는 보조 분류기 헤드를 0으로 초기화하고 백본은 He 초기화를 적용해, 초기 단계에서 보조 그래디언트를 완전히 차단한다. 이 “그래디언트 각성” 메커니즘은 별도 워밍업 하이퍼파라미터 없이 자연스럽게 보조 손실이 학습 진행에 따라 활성화되도록 하며, CIFAR‑10/100 실험에서 DenseNet‑DS와 ResNet‑DS 모두 수렴 속도를 8~11% 가속화하고 정확도 손실 없이 최종 성능을 유지한다.

상세 분석

본 논문은 깊이감독(deeply‑supervised) 구조에서 보조 분류기들이 초기 가중치가 무작위이므로 발생하는 급격한 그래디언트 간섭을 문제점으로 제시한다. 기존 초기화 기법들은 레이어별 특성을 고려하지 않아, 보조 헤드가 학습 초기에 큰 손실을 유발하고 메인 네트워크의 파라미터 업데이트를 방해한다. LION‑DG는 두 가지 핵심 아이디어로 이를 해결한다. 첫째, 보조 헤드 파라미터를 전부 0으로 초기화함으로써 해당 헤드에서 발생하는 역전파 신호를 완전히 차단한다. 둘째, 백본에는 표준 He 초기화를 그대로 적용해 표현력은 유지한다. 이 설계는 “Gradient Awakening”이라는 현상을 이론적으로 증명한다. 초기 단계에서 보조 손실에 대한 그래디언트가 정확히 0이므로 메인 손실만이 파라미터를 업데이트하고, 백본 가중치가 성장함에 따라 보조 헤드의 출력도 점진적으로 커져 자연스럽게 보조 손실이 학습에 참여한다. 이 과정은 별도의 워밍업 스케줄이나 학습률 조정 없이도 암묵적인 warm‑up 효과를 제공한다. 실험에서는 DenseNet‑DS와 ResNet‑DS에 LION‑DG를 적용했을 때, 동일한 학습 설정에서 수렴까지 필요한 에폭이 평균 8.3% (CIFAR‑10)와 11.3% (CIFAR‑100) 감소했으며, 최종 정확도는 기존 초기화와 동등하거나 약간 향상되었다. 또한 LSUV와 결합한 하이브리드 초기화는 CIFAR‑10에서 81.92%라는 최고 정확도를 달성했다. Ablation 연구를 통해 보조 헤드만 0 초기화하거나 백본만 He 초기화했을 때의 성능 저하를 확인하고, LION‑DG가 두 요소의 조합에서 최적의 시너지 효과를 내는 것을 입증한다. 제한점으로는 매우 깊은 네트워크나 비전 이외의 도메인(예: NLP)에서의 일반화가 아직 검증되지 않았으며, 보조 헤드가 매우 복잡한 경우 초기 0 가중치가 학습 초기의 표현 다양성을 억제할 가능성이 있다. 향후 연구에서는 동적 초기화 스케줄링이나 다른 형태의 보조 손실(예: 정규화 손실)과의 호환성을 탐색할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기