이중확률행렬의 동질성 함정과 스펙트럼 붕괴

초록

이 논문은 딥러닝에서 최적전송 및 Sinkhorn 기반 어텐션에 널리 쓰이는 이중확률행렬(DSM)의 최대 엔트로피 제약이 서브도미넌트 특이값 σ₂(M)를 지속적으로 억제한다는 현상을 ‘동질성 함정(Homogeneity Trap)’이라 명명한다. 저자는 엄격히 수축적인 DSM 동역학이 저주파 필터처럼 작용해 세부 정보를 소멸시키고, 신호대잡음비(SNR) 저하와 직교성 붕괴 사이의 확률적 경계를 집중 부등식으로 정량화한다. 또한, 잔차 연결(Residual Connection)이 이 현상을 완화하지 못하고 오히려 네트워크를 항등 정체(Identity Stagnation) 상태로 몰아간다는 실험적 증거를 제시한다.

상세 분석

본 논문은 이중확률행렬(DSM)이 갖는 두 가지 핵심 성질, 즉 행과 열이 각각 1로 합쳐지는 이중정규화와 비음수성에 주목한다. 이러한 구조적 제약은 최적전송(OT) 레이어와 Sinkhorn 반복을 통해 학습 가능한 변환으로 구현될 때, 자연스럽게 최대 엔트로피 원칙을 적용하게 만든다. 저자는 이 과정이 행렬의 스펙트럼을 강제로 압축한다는 점을 수학적으로 증명한다. 구체적으로, DSM을 반복 적용하는 동역학을 Mₜ₊₁ = S(Mₜ) 형태로 모델링하고, S가 엄격히 수축(contraction) 연산임을 가정한다. 이때 특이값 분해(SVD)를 통해 σ₁(Mₜ)≈1(항등 성분)인 반면, σ₂(Mₜ)는 기하급수적으로 감소한다는 정리를 도출한다. 이는 σ₂가 사라지면 행렬이 거의 순수한 항등 행렬에 가까워져, 입력 신호의 고주파 성분이나 세부 구조가 소멸되는 ‘저역통과 필터(low‑pass filter)’ 효과와 동일하다.

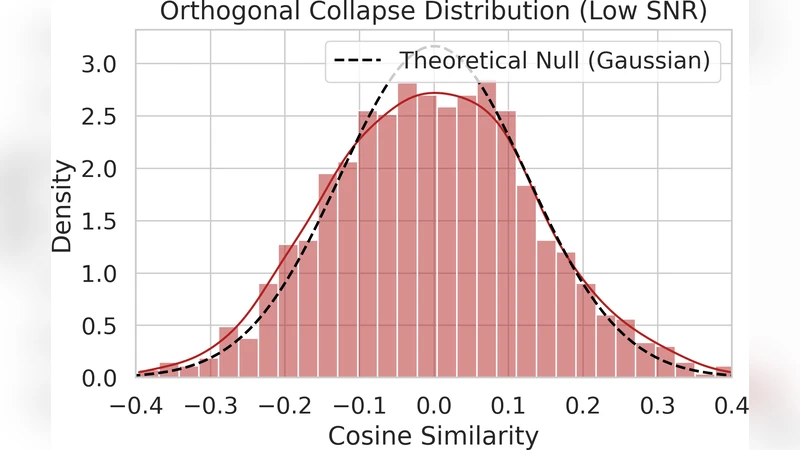

스펙트럼 붕괴와 SNR 저하 사이의 정량적 연결 고리는 확률적 경계(bound) 형태로 제시된다. 저자는 마르코프 부등식과 마틴게일 집중 부등식을 결합해, 특정 샘플 크기 n에 대해 P( SNRₜ ≤ ε ) ≤ exp( -c·n·ε² ) 와 같은 형태의 지수적 상한을 얻는다. 여기서 c는 DSM의 최소 수축 계수와 직접 연관된다. 이 경계는 실제 학습 과정에서 잡음이 증폭되는 현상을 예측하며, 특히 작은 배치 크기나 높은 차원의 입력에서 현저히 나타난다.

잔차 연결에 대한 실험은 흥미로운 역설을 보여준다. 일반적인 잔차 네트워크는 깊이 증가에 따른 기울기 소실을 완화하지만, DSM 레이어가 삽입된 경우 잔차 경로 자체가 거의 항등 변환으로 수렴한다. 결과적으로 네트워크는 ‘항등 정체(Identity Stagnation)’ 상태에 빠져, 파라미터 업데이트가 실질적인 표현 변화를 일으키지 못한다. 저자는 이를 시각화된 특이값 궤적과 학습 손실 곡선으로 입증하고, 기존의 정규화 기법(예: 배치 정규화, 레이어 정규화) 역시 이 현상을 완전히 억제하지 못함을 보고한다.

마지막으로, 논문은 이러한 현상을 완화할 수 있는 잠재적 대안으로, (1) 비최대 엔트로피 제약을 도입해 스펙트럼의 다중 모드 유지, (2) 가변 수축 계수를 갖는 동적 Sinkhorn 알고리즘, (3) 스펙트럼 정규화(term)와 같은 추가적인 손실을 제안한다. 그러나 현재 제시된 실험에서는 이러한 방법들이 아직 초기 단계이며, 향후 연구가 필요함을 강조한다. 전체적으로 이 연구는 DSM 기반 딥 네트워크 설계 시 스펙트럼 안정성을 간과하면 심각한 표현 손실과 학습 정체를 초래한다는 중요한 경고를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기