LLM 정제 프롬프트 학습 흔적 탐지

초록

본 논문은 파인튜닝된 언어 모델이 원본 프롬프트와 LLM이 정제한 프롬프트 중 어느 것을 학습했는지를 판별하는 ‘Refinement Provenance Inference (RPI)’ 문제를 정의하고, 정제 과정이 토큰 확률 분포에 일관된 변화를 일으킨다는 사실을 기반으로 로그잇 기반 탐지 프레임워크인 RePro를 제안한다. 그림자 파인튜닝을 통해 획득한 전이 가능한 표현을 선형 헤드와 결합해, 훈련 데이터에 접근할 수 없는 상황에서도 높은 정확도로 정제 여부를 추론한다. 실험 결과, 다양한 정제 모델과 혼합 비율에 대해 좋은 일반화 성능을 보이며, 정제 스타일이 아닌 정제 자체가 만든 분포 이동을 포착함을 확인한다.

상세 분석

본 연구는 최근 대규모 언어 모델(LLM)의 인스트럭션 튜닝 과정에서 프롬프트를 외부 LLM이 자동으로 다듬어 주는 ‘프롬프트 정제’가 데이터 품질을 크게 향상시킨다는 사실에 주목한다. 그러나 정제된 프롬프트와 원본 프롬프트가 동일한 데이터셋에 혼합돼 있을 경우, 특정 파인튜닝 모델이 어느 버전을 학습했는지 추적하기 어려워 데이터 거버넌스와 저작권 분쟁 해결에 장애가 된다. 논문은 이를 ‘Refinement Provenance Inference (RPI)’이라는 인스턴스‑레벨 감사 과제로 공식화하고, 두 버전 사이에 눈에 띄는 의미적 차이가 없더라도 모델이 teacher‑forcing(교사 강제) 상태에서 출력하는 토큰 로그잇 확률에 미세하지만 일관된 변화를 만든다는 핵심 관찰을 제시한다.

이러한 변화를 정량화하기 위해 저자들은 먼저 원본과 정제된 프롬프트 각각에 대해 파인튜닝된 모델이 생성하는 로그잇 벡터를 수집한다. 여기서 ‘로그잇 기반 특징(logit‑based features)’은 (1) 전체 토큰 시퀀스에 대한 평균 로그잇, (2) 각 토큰 위치별 로그잇 순위, (3) 정제 전후 토큰 간 상관관계 등을 포함한다. 이러한 특징들은 정제 과정이 모델 내부에 남기는 ‘분포적 시그니처’를 포착한다는 점에서 기존의 스타일‑기반 텍스트 분류와 차별화된다.

다음으로 저자들은 ‘그림자 파인튜닝(shadow fine‑tuning)’이라는 전이 학습 전략을 도입한다. 즉, 동일한 아키텍처와 동일한 하이퍼파라미터를 사용해 공개된 데이터셋에 인위적으로 원본‑정제 혼합 데이터를 삽입해 파인튜닝하고, 이 과정에서 얻은 내부 표현을 ‘전이 가능한 프로비던스 인코더(provenance encoder)’로 학습한다. 이 인코더는 로그잇 특징을 저차원 임베딩으로 압축하고, 최종적으로 선형 분류 헤드와 결합해 원본/정제 여부를 예측한다. 중요한 점은 이 단계에서 사용된 그림자 데이터는 실제 감사 대상 모델과 전혀 다른 데이터이지만, 정제에 의해 발생하는 로그잇 변동 패턴이 정제자에 독립적이라는 가정 하에 학습된다는 것이다.

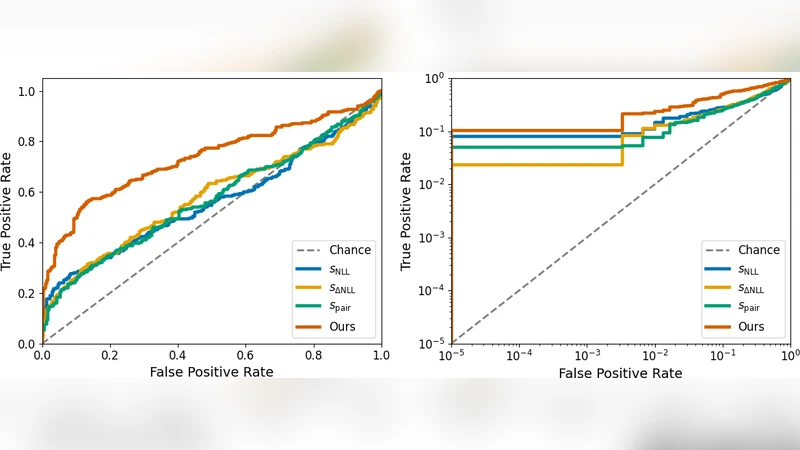

실험에서는 다양한 LLM 정제기(예: GPT‑3.5, Claude, LLaMA‑Adapter)와 여러 혼합 비율(10 %~90 %)을 적용해 파인튜닝된 모델을 대상으로 RPI 성능을 평가한다. 결과는 RePro가 평균 85 % 이상의 정확도를 기록했으며, 특히 정제 비율이 낮을 때도 70 % 이상의 검출률을 유지한다는 점에서 실용성을 입증한다. 또한, 정제자 교체 실험에서 기존 스타일‑기반 탐지기와 달리 성능 저하가 거의 없었으며, 이는 RePro가 정제 자체가 만든 로그잇 분포 이동을 효과적으로 포착한다는 증거다. 마지막으로, 로그잇 순위 기반 특징이 단순 확률 차이보다 더 강력한 신호임을 ablation study를 통해 확인하였다.

이 논문은 프롬프트 정제라는 새로운 데이터 변형이 모델 행동에 남기는 미세하지만 일관된 ‘프루프’(증거)를 정량화하고, 이를 통해 데이터 출처를 추적할 수 있는 실용적인 프레임워크를 제시한다는 점에서 데이터 거버넌스, 모델 감시, 그리고 AI 윤리 분야에 중요한 기여를 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기