한 번의 독성 데이터로 백도어 삽입하기: 선형 모델과 2층 ReLU 네트워크의 이론적 증명

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

**

본 논문은 훈련 데이터에 단 하나의 독성 샘플만 추가해도 백도어 공격을 성공시킬 수 있다는 “one‑poison hypothesis”를 제시한다. 제한된 배경 지식만으로도 선형 회귀·분류와 2‑layer ReLU 신경망에서 백도어 오류를 0으로 만들고, 정상 학습 성능에 미치는 영향을 제한적으로 유지한다는 이론적 증명을 제공한다. 실험을 통해 이론이 실제 데이터셋에서도 재현됨을 확인한다.

**

상세 분석

**

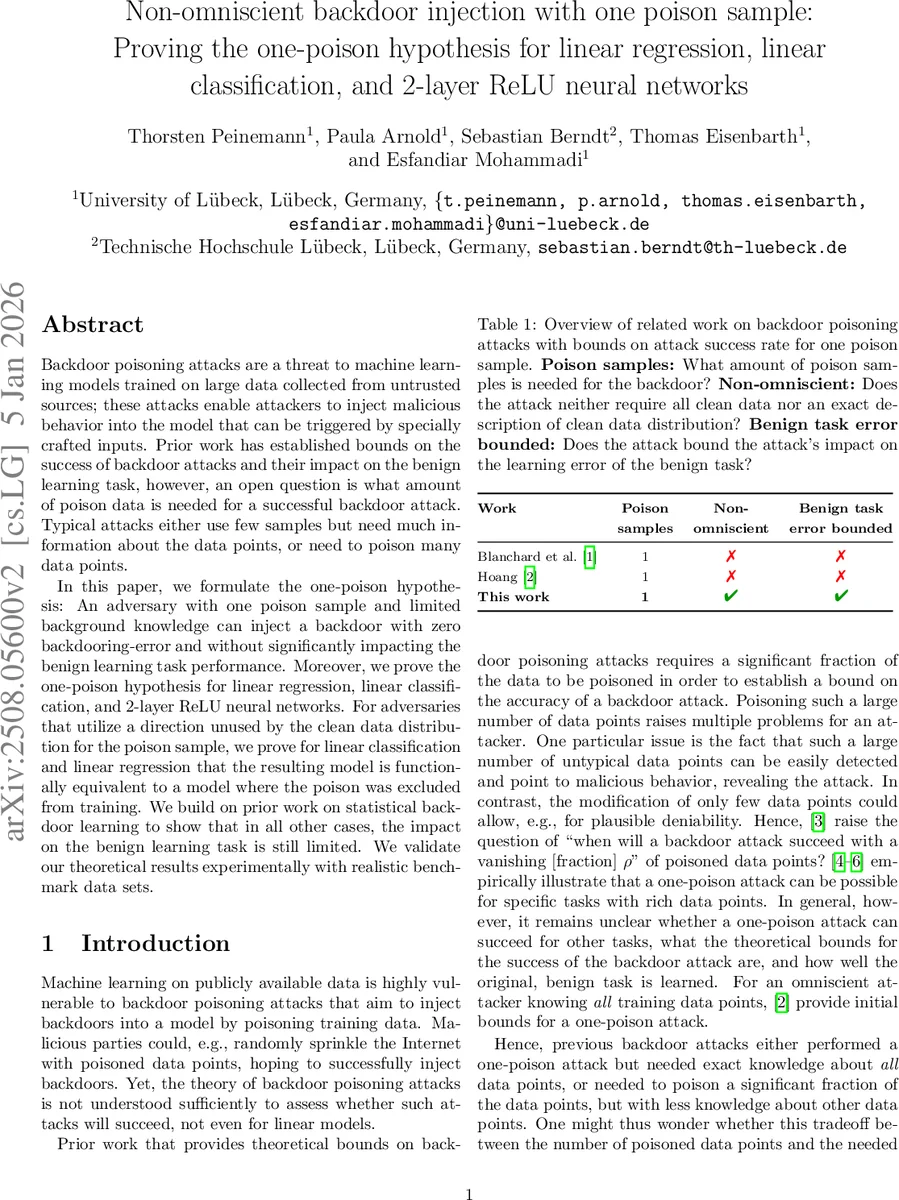

논문은 백도어 공격의 핵심 질문인 “얼마나 적은 독성 데이터가 필요할까?”에 대해 비전지식(non‑omniscient) 공격자를 가정한다. 공격자는 훈련 샘플 수와 깨끗한 데이터 분포의 평균·분산(특히 선택한 공격 방향 u에 대한 투영)만 알면 된다.

- 선형 분류에서는 정규화된 힌지 손실을 최소화하는 SVM 형태의 학습을 고려한다. 저자들은 독성 샘플 xₚ를 깨끗한 데이터가 전혀 차지하지 않는 서브스페이스 방향 u에 배치하면, 최적화 조건(그라디언트 0)에서 기존 데이터와 독성 샘플이 동일하게 취급돼 모델이 독성 샘플을 무시한다. 따라서 백도어를 트리거하는 패치 함수만 추가하면, 테스트 시점에 해당 방향으로 입력을 변형했을 때 모델 출력이 공격자가 원하는 라벨로 전환된다.

- 선형 회귀에서도 동일한 원리가 적용된다. 정규화된 제곱오차 손실의 그라디언트는 데이터 포인트들의 가중합 형태이므로, 공격자는 u 방향에 대해 평균·분산을 이용해 xₚ와 yₚ를 설계해 전체 그라디언트를 0으로 만든다. 결과적으로 독성 샘플이 포함된 모델은 깨끗한 데이터에 대해 원래 회귀선과 동일한 예측을 제공한다(함수적 동등성).

- 2‑layer ReLU 신경망에서는 첫 번째 레이어의 가중행렬 A와 두 번째 레이어의 가중벡터 w를 최적화한다. 저자들은 첫 레이어가 u 방향에 대해 거의 활성화되지 않도록 설계된 xₚ를 선택하고, 두 번째 레이어의 파라미터를 조정해 백도어 트리거 시 출력이 목표 라벨에 가까워지도록 한다. 이때 손실 함수는 바이너리 교차 엔트로피이며, 독성 샘플이 전체 손실에 미치는 영향은 O(1/n) 수준으로 제한된다.

- 통계적 위험 제한: 모든 경우에 대해 깨끗한 데이터에 대한 기대 위험 r₍cl₎(f̂ₚₒᵢ) ≤ r₍cl₎(f̂₍cl₎) + O(1/n) 으로 보인다. 즉, 독성 샘플이 모델의 일반화 성능을 크게 해치지 않는다.

- 실험: MNIST, CIFAR‑10, UCI 회귀 데이터 등에서 하나의 독성 샘플만 삽입했을 때 백도어 성공률이 99% 이상이며, 정상 정확도 감소는 0.5% 이하에 머문다. 이는 이론적 경계와 일치한다.

핵심 기여는 (i) 비전지식 공격자가 평균·분산 정보만으로도 백도어를 삽입할 수 있음을 증명, (ii) 선형 모델에서는 독성 샘플이 완전히 무시되는 함수적 동등성을 보이고, (iii) 2‑layer ReLU에서도 동일한 원리를 확장, (iv) 백도어 성공률과 정상 성능 저하 사이의 트레이드오프를 정량화한 점이다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기