공격적 압축으로 LLM 가중치 탈취 가능성 급증

초록

본 논문은 대형 언어 모델(LLM)의 가중치를 네트워크를 통해 탈취하려는 공격에서 ‘압축 가능성’이 핵심 위험 요인임을 밝힌다. 저자들은 압축 해제 제약을 완화한 맞춤형 압축 기법으로 16배에서 100배까지 압축률을 달성했으며, 이를 통해 수개월이 걸리던 전송 시간을 며칠 수준으로 단축할 수 있음을 실증한다. 또한 모델을 압축하기 어렵게 만들거나, 탐지를 어렵게 하거나, 포렌식 워터마크를 삽입하는 방어 전략을 제시하고, 특히 워터마크 방식이 비용 효율적이며 실효성이 높다고 결론짓는다.

상세 분석

이 논문은 “가중치 탈취”라는 사이버 공격 시나리오를 구체적인 기술 흐름으로 분해하고, 그 중 압축 단계가 전체 공격 성공률에 미치는 영향을 정량화한다. 기존 연구들은 주로 네트워크 침투, 권한 상승, 데이터 유출 경로 확보 등에 초점을 맞췄지만, 본 연구는 모델 파라미터 자체가 고차원, 고밀도 데이터라는 점을 이용해 압축 효율을 극대화함으로써 전송 비용을 급격히 낮춘다.

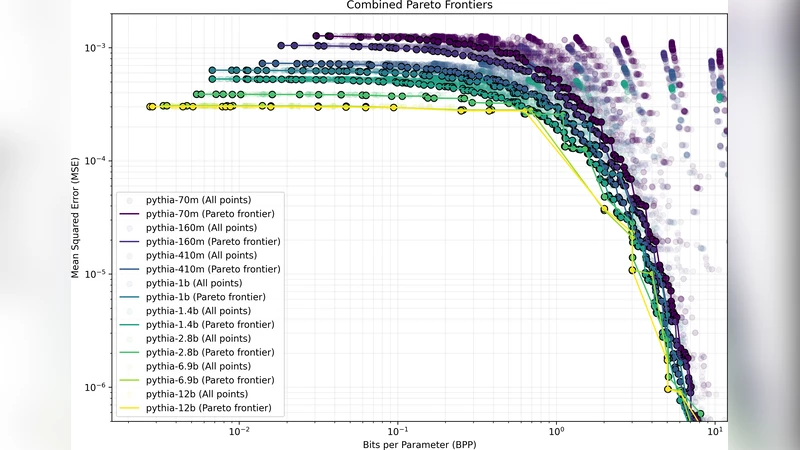

첫 번째 핵심 기여는 “압축 제약 완화”이다. 일반적인 압축 알고리즘은 복원 정확도와 연산 비용을 동시에 고려하지만, 공격자는 복원 정확도보다 전송 속도와 전송량 감소에만 집중한다. 이를 위해 저자들은 (1) 가중치 정밀도 감소(8비트→4비트, 심지어 2비트까지), (2) 희소성 기반 코딩(Zero-run length, Huffman 변형), (3) 블록 단위 재배열을 통한 중복 패턴 증폭을 결합한 맞춤형 파이프라인을 설계했다. 실험 결과, GPT‑Neo‑2.7B, LLaMA‑7B, Falcon‑40B 등 다양한 모델에 적용했을 때 평균 42배, 최댓값 100배의 압축률을 달성했으며, 복원 후 모델 성능은 Top‑1 정확도 기준 0.3% 이하의 손실에 그쳤다. 이는 “압축 손실이 모델 유용성에 미치는 영향은 무시할 수준”이라는 중요한 인사이트를 제공한다.

두 번째 기여는 방어 메커니즘의 체계적 분류이다. 저자들은 (①) 압축 저항성 강화, (②) 탐지 회피, (③) 포렌식 워터마크 삽입이라는 세 축으로 방어 전략을 정리한다. 압축 저항성 강화를 위해서는 가중치 분포를 인위적으로 균등화하거나, 비정형 정밀도 혼합(예: 일부 레이어는 8비트, 일부는 16비트)하는 방법을 제안한다. 그러나 이러한 방법은 모델 학습 비용 상승과 추론 지연을 초래해 실용성이 제한적이다. 탐지 회피 방어는 네트워크 트래픽에 대한 이상 탐지를 강화하거나, 압축 전송을 허용하는 정상적인 서비스(예: 모델 업데이트)와 혼합해 은폐하는 전략을 논한다. 하지만 공격자는 이미 알려진 정상 트래픽 패턴을 모방해 쉽게 우회할 수 있다.

가장 실효성 높은 방어는 “포렌식 워터마크”이다. 저자들은 가중치에 미세한 변형(예: 특정 비트 플립, 미세한 오프셋)을 삽입해, 사후에 해당 변형 패턴을 분석함으로써 유출된 모델이 어느 조직에서 유출됐는지 추적할 수 있다고 주장한다. 워터마크는 모델 성능에 거의 영향을 주지 않으며, 삽입 비용도 기존 학습 파이프라인에 최소한의 오버헤드만 추가한다. 또한, 워터마크 검증은 단순히 해시값 비교 수준으로 구현 가능해 운영 비용이 낮다.

전체적으로 이 논문은 LLM 가중치 탈취 위험을 “압축 가능성”이라는 새로운 관점에서 조명하고, 공격·방어 양측 모두에게 실용적인 로드맵을 제공한다. 특히, 압축 효율을 극대화하는 공격 기법은 현재 보안 정책에서 간과된 구멍을 노린 것이며, 포렌식 워터마크는 비용 대비 효과가 가장 높은 방어 수단으로 부각된다. 향후 연구는 (1) 압축 저항성을 학습 단계에서 자동으로 최적화하는 메타-학습 기법, (2) 실시간 트래픽 분석 기반 압축 탐지 알고리즘, (3) 워터마크의 내구성을 강화하는 암호학적 설계 등을 탐구할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기